MiniMax M2.5开源:低成本AI助手的颠覆性突破

MiniMax M2.5开源:低成本AI助手的颠覆性突破

在一项可能 democratize(普及)高级AI访问权限的举措中,MiniMax已将其M2.5模型作为开源软件发布在ModelScope上。这是其快速发布周期中的第三代产品(距上一版本仅108天),让个人开发者和小型企业也能获得专业级AI能力。

令人瞩目的性能表现

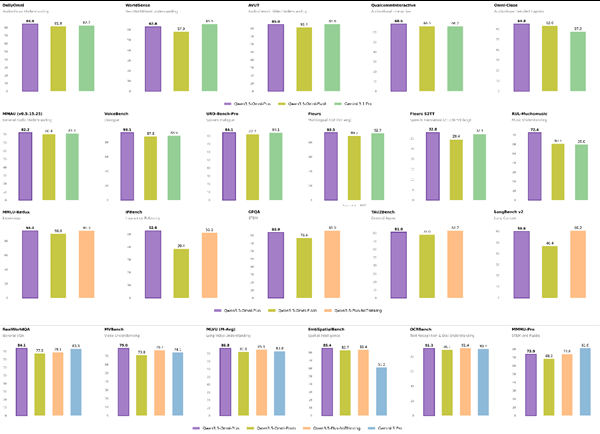

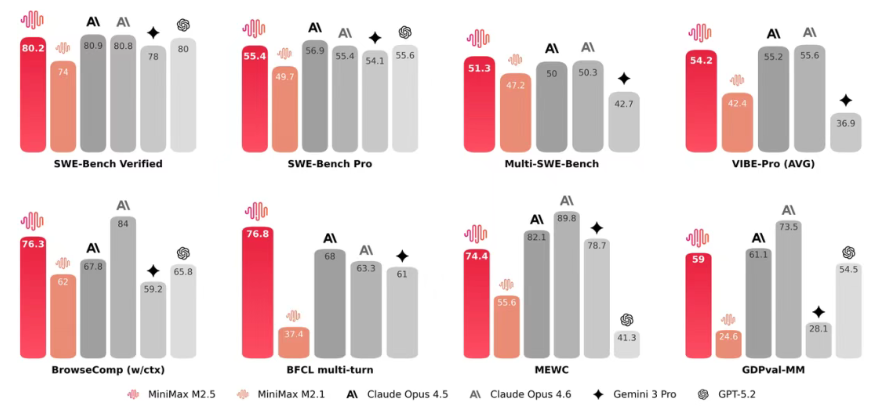

数据说明一切:M2.5在SWE-Bench Verified上取得了令人印象深刻的80.2%,略微超过GPT-5.2并紧追Claude Opus4.5。在多语言编程任务方面,它以51.3%的Multi-SWE-Bench得分目前无人能敌。

这在实际中意味着什么?开发者报告称该模型在架构规划方面展现出非同寻常的成熟度,从初始设计到跨多平台的最终实施,处理效果优于大多数替代方案。

"我们一直在测试各种模型以优化工作流程",DevFlow Solutions首席技术官Marco Lin分享道:"M2.5的框架泛化能力让我们惊讶——它比专用工具更快适应了我们的遗留系统"

速度与经济的完美结合

最令人惊喜的是什么?在匹配Claude Opus4.6响应时间的同时,MiniMax声称M2.5的运行成本仅为同类模型的十分之一。

三项技术突破实现了这一效率:

- Forge原生Agent RL框架带来40倍训练加速

- CISPO算法稳定大规模训练

- 创新的Reward设计平衡性能与速度

结果如何?在MiniMax内部运营中,M2.5现已处理30%的日常任务和80%的新代码提交。

丰富的部署选择

MiniMax深知没有放之四海皆准的方案:

- 无代码用户:可直接使用包含10,000多个预制"专家"的网页界面

- 开发者:可选择免费API调用或官方ModelScope集成

- 企业需求:本地部署支持SGLang(高并发)、vLLM(中端)、Transformers(快速测试)和MLX(Mac开发)

公司甚至提供经济实惠的API套餐——Lightning和Standard版本价格仅为竞争对手的1/10到1/20。

优化使用体验

该模型在正确配置时表现最佳:

- 默认设置效果良好(temperature=1.0, top_p=0.95)

- 原生支持并行工具调用节省宝贵开发时间

- 完整指南帮助将工具结果整合回工作流

当AI变得日益重要却实施昂贵时,MiniMax通过M2.5的开源策略可能标志着一个转折点——让复杂AI助手触手可及而无需复杂预算。

关键要点:

- ModelScope上的开源访问降低了入门门槛

- 编程和搜索任务中的基准测试领先性能

- 经济高效的运行成本仅为同类模型的10%

- 灵活部署方案从无代码网页应用到本地实现

- 快速迭代周期展现MiniMax对持续改进的承诺