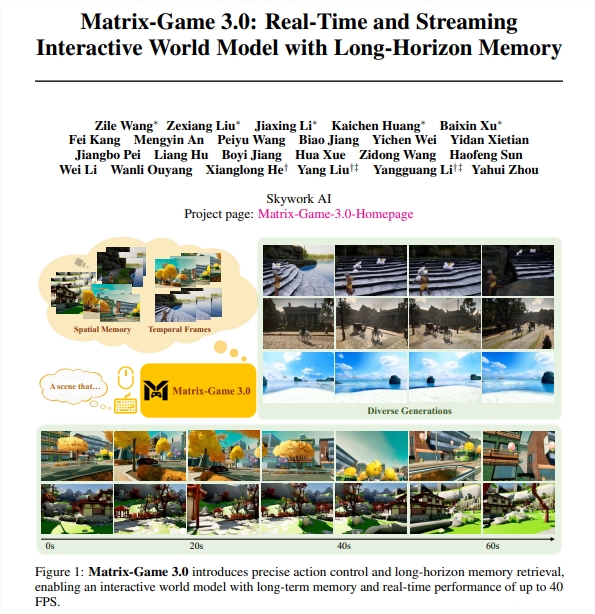

PixVerse R1通过实时1080P视频技术让虚拟世界栩栩如生

交互式虚拟世界的新纪元

想象一个能实时响应你每个想法和动作的数字世界,其画面清晰度足以与现实媲美。这正是爱世科技通过革命性的PixVerse R1模型所实现的成就,为交互式虚拟体验树立了新标准。

背后的技术魔法

PixVerse R1的核心在于融合了三项协同工作的突破性技术:

Omni作为模型的计算核心,将文本、图像、音频和视频无缝融合成统一的流媒体。可以把它想象成我们大脑同时处理多种感官的数字版——只不过这里是从零开始创造令人惊叹的1080P虚拟环境。

系统的自回归流式生成就像一个无限记忆库。这解决了数字内容创作中最令人头疼的问题之一——保持长序列的一致性。不再有突兀的场景转换或逻辑漏洞破坏你的沉浸体验。

最令人印象深刻的或许是即时响应引擎(IRE),开发者称之为"神经反射"。通过大幅减少处理步骤,这项技术实现了快如本能的反应速度——就像一个能预判你下一步行动的虚拟世界。

改变创作与娱乐方式

这项技术的意义远超技术参数本身。PixVerse R1本质上为每个人提供了通往自己虚拟宇宙的钥匙:

- 游戏玩家可以探索根据其行为有机演变的世界

- 电影制作人获得了让观众实时影响叙事的创作工具

- 主播能将被动观众转变为在内容展开过程中主动参与的塑造者

该模型"所思即所见"的方法标志着从预设脚本的数字体验到真正响应式环境的重大转变。目前可在realtime.pixverse.ai进行公开测试——不过要提醒的是,一旦开始体验可能会忘记时间流逝。

关键要点:

- 首个支持1080P视频质量的通用实时世界模型

- 结合三项创新技术实现无缝交互体验

- 支持跨游戏、电影和直播的用户共创

- 现已开放公众测试:realtime.pixverse.ai