阿里巴巴Qwen3.5-Omni以突破性多模态能力超越Gemini

阿里巴巴AI飞跃:Qwen3.5-Omni重新定义多模态交互

在中国AI领域的重大进展中,阿里巴巴推出的Qwen3.5-Omni不仅与Gemini等全球巨头竞争,更在多个关键方面实现了超越。这不仅仅是一次常规升级,而是代表了AI理解和交互世界方式的根本性变革。

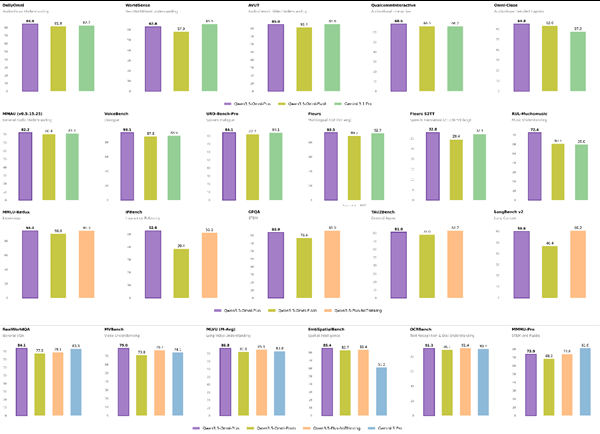

基准测试称霸

数据说明一切:Qwen3.5-Omni在惊人的215项评估任务中均取得顶级表现。在与谷歌Gemini-3.1Pro进行的DailyOmni和QualcommInteractive等视听交互测试中,这款中国模型明显领先。即使在嘈杂环境中,其语音识别仍保持显著准确性,让竞争对手望尘莫及。

超越文本:真正的多感官AI

该模型的独特之处在于其真正的多模态能力:

- 语言掌握覆盖113种语言和方言,包括毛利语和海南话等稀有语种

- 视觉编程允许用户边绘制界面边口头描述 - AI负责实际编码工作

- 深度媒体分析能解析视频叙事,追踪主体关系和情感脉络

对于处理长内容的专业人士,Qwen3.5-Omni带来了变革性的效率提升:

- 可处理长达10小时的连续音频,自动分段并标注内容

- 生成带时间戳章节的完整视频转录本

成本优势可能是最具颠覆性的特点 - 通过阿里云百炼的分级API服务,价格仅为Gemini的十分之一。

关键要点:

- 215项基准测试胜利确立Qwen3.5-Omni作为多模态AI新领导者地位

- 真正的跨模态处理无缝整合图像、视频、音频和文本

- 语言支持涵盖113种语言及稀有方言能力

- 视觉编程实现'语音转代码'界面创建

- 成本效益比竞品节省90%费用