寒武纪实现与DeepSeek-V4即时兼容,并公开共享代码

寒武纪为最新AI模型架设硬件桥梁

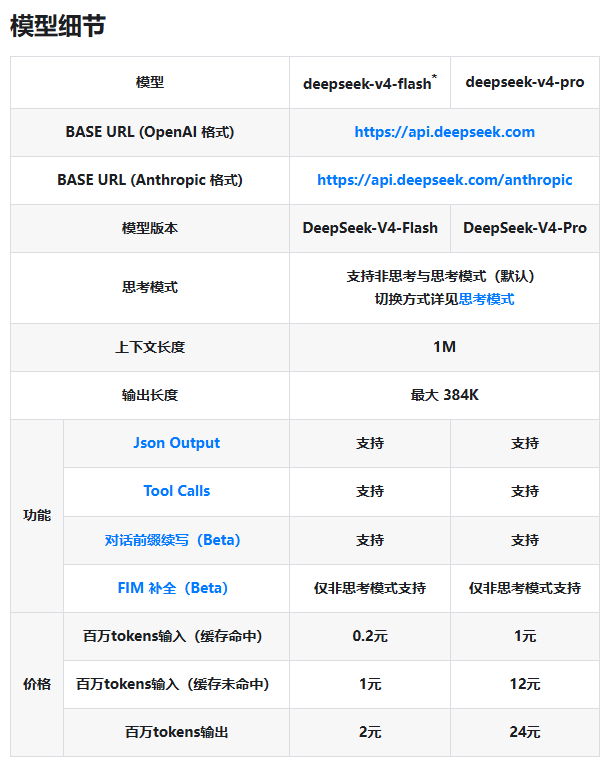

在AI基础设施领域的一项重大进展中,寒武纪成功实现了DeepSeek最新开源模型在其硬件平台上的即日流畅运行。这一成就涵盖DeepSeek-V4的两个版本——2850亿参数的Flash版和庞大的1.6万亿参数Pro版。

技术突破

适配过程并非一帆风顺。DeepSeek-V4独特的稀疏注意力和压缩结构需要特殊处理。寒武纪团队使用其Torch-MLU-Ops库和BangC编程语言开发了优化内核,重点针对稀疏注意力(Attention)和GroupGemm等关键运算进行优化。

"我们已全面支持五维混合并行策略,"一位寒武纪工程师解释道,"包括TP/PP/SP/DP/EP配置、低精度量化以及在vLLM框架内的PD分离部署。"这些优化显著提升了token吞吐量,同时满足严格的延迟要求。

硬件优势

寒武纪的MLU硬件具备以下突出优势:

- 增强的内存访问能力

- 先进的排序加速特性

- 高互联带宽

- 超低延迟通信

这些特性在处理DeepSeek-V4复杂的索引结构和百万字上下文窗口时尤为宝贵。该硬件在Prefill和Decode阶段都最小化了通信开销,将推理效率推向新高度。

行业影响

此次成功适配标志着中国AI生态系统日趋成熟。以往尖端模型在国内硬件上运行可能存在延迟,而寒武纪的零日兼容性证明本土解决方案现已能跟上全球技术进步的步伐。

DeepSeek-V4代表了当前最具挑战性的AI架构之一,拥有前所未有的上下文长度和顶级推理能力。寒武纪能够即时支持如此复杂的模型,表明中国AI基础设施正达到新的成熟度水平。

通过GitHub开源适配代码的决定,使这一技术成果可供全球开发者使用,有望加速DeepSeek模型和寒武纪硬件平台的普及。

关键要点:

- 实现与DeepSeek-V4模型(2850亿和1.6万亿参数)的即时兼容

- 优化代码已在GitHub上开放供社区使用

- 为稀疏注意力机制开发了专用加速方案

- 充分发挥硬件优势以实现最大推理效率

- 中国AI硬件能力的重要里程碑