DeepSeek-V4震撼登场:1元即可体验媲美顶级模型的开源AI

DeepSeek-V4:正在改变游戏规则的开源AI

在震撼AI界的重大举措中,DeepSeek于4月24日推出了V4模型,其能力已惊人地接近当今顶级闭源产品。这不仅仅是一次常规更新——它可能成为开发者和企业共同的游戏规则改变者。

突破上下文限制

最突出的特点?惊人的100万token上下文窗口。想象一下可以一次性分析整本书,或在数十页文本中保持连贯对话。这一能力为复杂的文档分析、大规模代码生成和精密的多步骤代理任务打开了大门,而这些在之前都是不切实际的。

两种版本满足不同需求

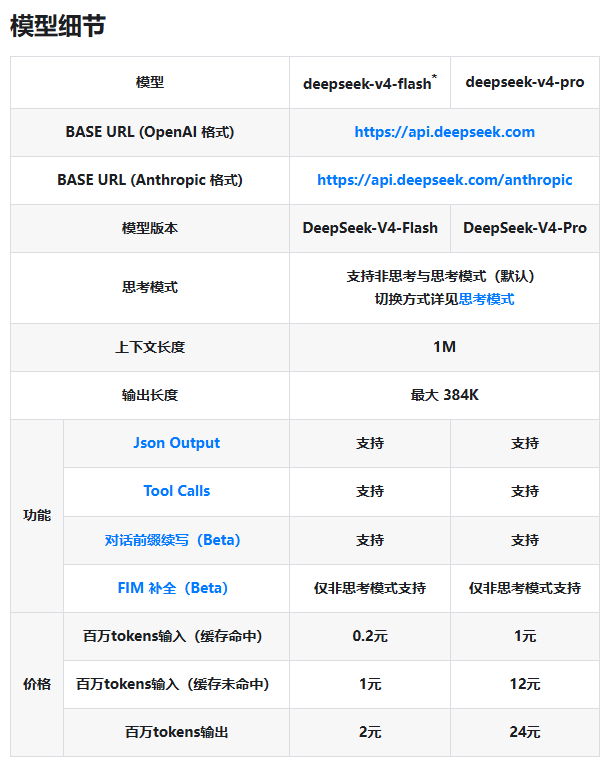

认识到"一刀切"不可行,DeepSeek提供了两个不同版本:

- V4-Flash:适用于日常任务,速度优先于蛮力

- V4-Pro:当您需要最大处理能力应对高要求应用时

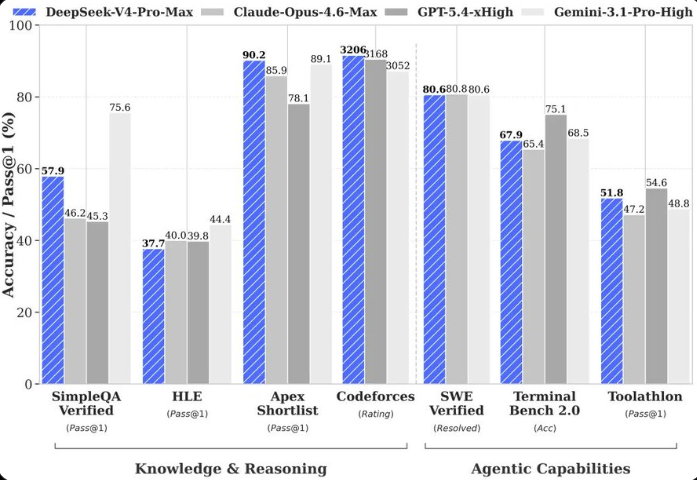

Pro版本尤其擅长数学、STEM领域和竞技编程等技术领域,表现超越当前所有其他开源模型。

更智能的代理,更广博的知识

新模型对其代理能力进行了重大升级——这些AI助手可以处理复杂的任务序列。在专业编码评估中,V4-Pro现在为开源模型树立了新标准。

其世界知识库也显著扩展。虽然仍略微落后于闭源的Gemini-Pro-3.1,但在理解的广度和深度上已远超其他开源替代品。

改变一切的定价策略

这才是真正有趣的部分。DeepSeek延续了其激进的定价传统:

- 输入处理:每百万token仅需¥1(Flash)或¥12(Pro)

- 输出生成:每百万token¥2(Flash)或¥24(Pro)

这种定价结构有效打破了此前将高级AI挡在个人开发者和小公司门外的成本壁垒。

对AI生态系统的影响

此次发布挑战了"只有资金雄厚的大公司才能使用顶级AI能力"的观念。通过以开源价格提供接近闭源的性能,DeepSeek正在迫使所有人重新思考民主化人工智能的可能性。

现在最大的问题是?这将如何促使市场上的其他参与者做出反应。

关键点:

- 性能:在许多基准测试中媲美领先的闭源模型

- 上下文:一次处理高达100万token——目前最长的上下文之一

- 版本:可在轻量级Flash和强大Pro选项之间选择

- 价格:每百万token仅¥1起——震撼行业的价值主张