惊人研究揭示AI中继站可秘密操控你的聊天机器人

你的AI助手可能正在为黑客工作

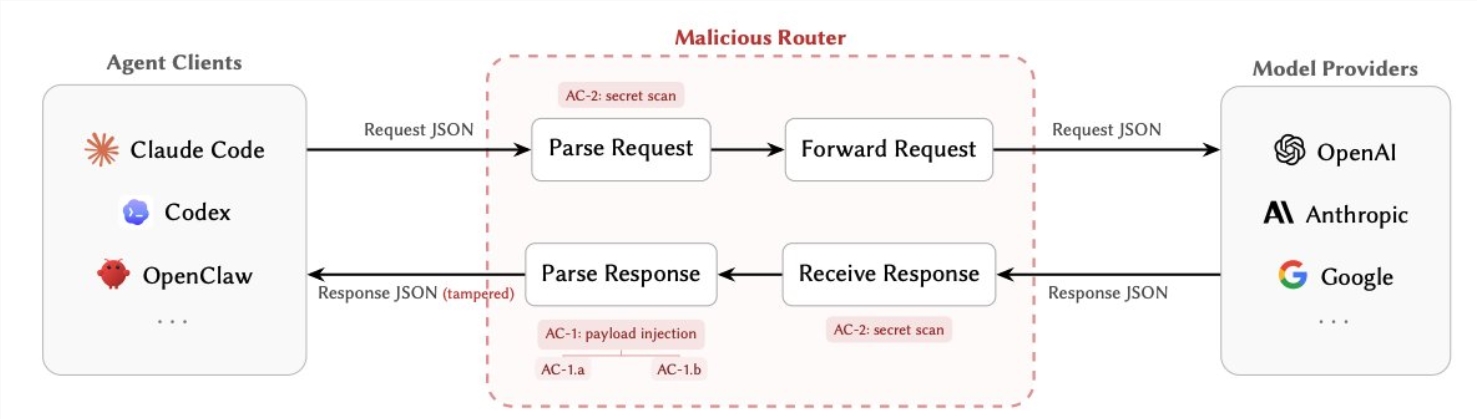

在一项震撼AI界的发现中,安全专家Chaofan揭露出常用的AI中继站如何被变成数字木偶操纵者。题为《你的代理属于我》的研究论文曝光了这些AI通信链中的中间人如何秘密劫持你的聊天机器人和虚拟助手。

攻击原理

现代AI系统经常通过第三方服务路由请求——这就像课堂上传纸条的数字版。但与学童不同,这些路由器能看到所有未加密的细节:API密钥、私密凭证甚至敏感工具参数。Chaofan团队展示了两种可怕的攻击方法:

1. 偷梁换柱: 想象让AI预订酒店,却让恶意路由器将预订链接改为钓鱼网站。这正是负载注入攻击中发生的情况——路由器在AI指令离开主模型后悄悄修改内容。

2. 数字扒手: 一些恶意路由器就像监控摄像头般观察流量,悄悄收集有价值的凭证。研究人员发现以太坊私钥、亚马逊网络服务登录信息和其他敏感数据在毫无迹象的情况下被窃取。

触目惊心的数据

研究团队测试了428个中继服务(包括付费和免费),结果令人不安:

- 9个路由器主动注入恶意代码

- 1次攻击掏空了测试钱包中价值500万美元的以太坊

- 超过21亿个AI"令牌"通过可疑渠道处理

- 401个代理会话在零安全检查下运行(被研究人员称为"YOLO模式")

"这就像发现邮递员一直在拆改你的信件,"一位熟悉该研究的网络安全专家解释道,"只不过在这个案例中,他们能完美模仿你的笔迹。"

当前形势的紧迫性

随着AI助手处理日益敏感的任务——从金融交易到医疗建议——这些漏洞显得尤为紧迫。研究人员警告称,当前的安全工作过分关注AI模型本身,却忽视了传递消息的中继站。

"我们一直担心大脑,却让神经系统毫无保护,"论文中指出。当使用缺乏适当安全监督的廉价或免费中继服务时,这种疏忽变得特别危险。

如何保护你的AI系统

对于使用AI代理的开发者和公司,研究人员建议:

- 尽可能消除中间环节,使用直接API连接

- 严格锁定自托管路由器,采用沙盒隔离和代码审计

- 全程加密,采用端到端保护

- 警惕异常行为——如果你的AI开始表现异常,可能不是程序错误

"这不是在制造恐慌,"Chaofan在接受采访时强调,"而是要认识到AI安全涉及整个通信链,而不仅仅是终端。"

关键要点

- 第三方AI中继站构成严重安全风险

- 攻击手段包括秘密代码注入和凭证窃取

- 免费/低成本服务可能风险更高

- 开发者应优先考虑直接连接和加密

- 定期更换密钥和行为监控至关重要