Meta增强AI聊天机器人家长控制功能

Meta推出增强版AI聊天机器人家长控制

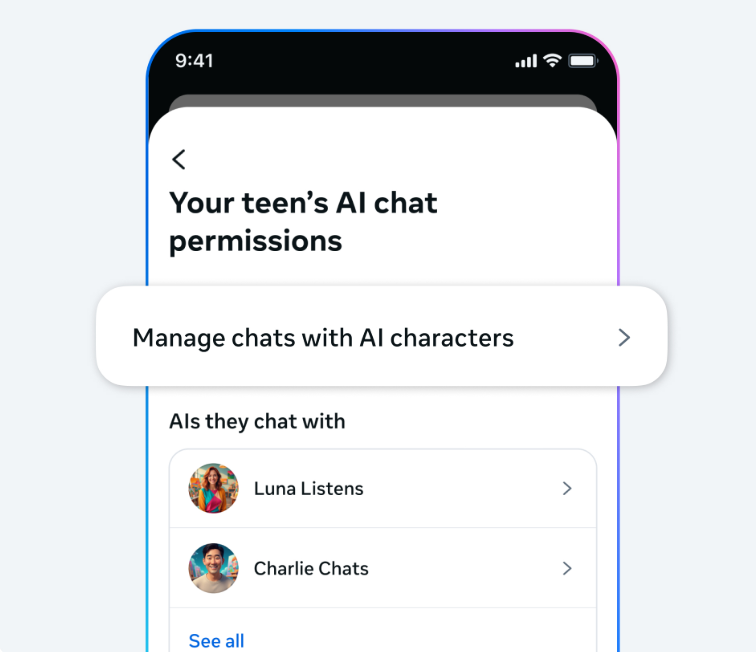

Meta公布了针对AI聊天机器人的重大家长控制升级措施,旨在提升未成年用户的安全性。新推出的"总开关"工具将允许家长限制孩子在Instagram和Facebook上访问特定AI聊天机器人角色。此举回应了社会对AI安全日益增长的担忧,致力于为未成年人创造更安全的数字环境。

家长监督新功能

除"总开关"外,Meta还推出了"洞察"功能。该工具让家长可以监控孩子与AI聊天机器人讨论的话题,提高对线上互动的认知度。公司还承诺禁止AI聊天机器人与青少年讨论敏感话题,如自残、饮食失调、人际关系和性相关内容。相反,聊天机器人将专注于适合年龄的主题,如学业和体育。

全球发布计划与背景

这些家长控制工具计划于2026年初发布,首批将在美国、英国、加拿大和澳大利亚上线。Meta的决定源于今年发生的多起AI聊天机器人与未成年人不当互动事件。例如有报道称像"约翰·塞纳"这样的虚构角色曾发表不当言论,引发公众抗议。

为进一步提升透明度和安全性,Meta更新了内容审核机制并引入了PG-13分级指导系统。这些措施是确保AI互动对年轻用户保持适宜性的广泛努力的一部分。

持续改进承诺

Meta强调致力于完善AI互动监督机制。公司希望通过提供更好的工具赋能家长管理孩子的数字体验。通过实施这些防护措施,Meta力求为未成年人营造更安全的网络空间。

关键要点:

- 📅 总开关工具: 家长可阻止未成年子女访问特定AI聊天机器人角色

- 👁️ 洞察功能: 使家长能够监控孩子与AI的对话主题

- 🔒 内容限制: 禁止讨论自残、饮食失调等有害话题