Claude代码泄露:一个简单错误如何揭露AI的肮脏秘密

当AI安全败给人为失误

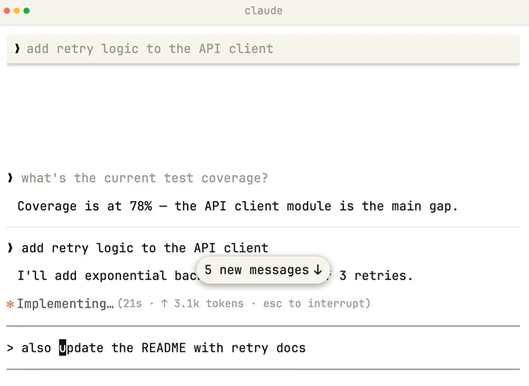

这个堪比科技行业讽刺剧的情节中,Anthropic的高级AI编程助手Claude Code的源代码通过软件开发中最古老的错误之一被曝光:有人忘记检查生产环境打包内容。

本不该发生的泄露事件

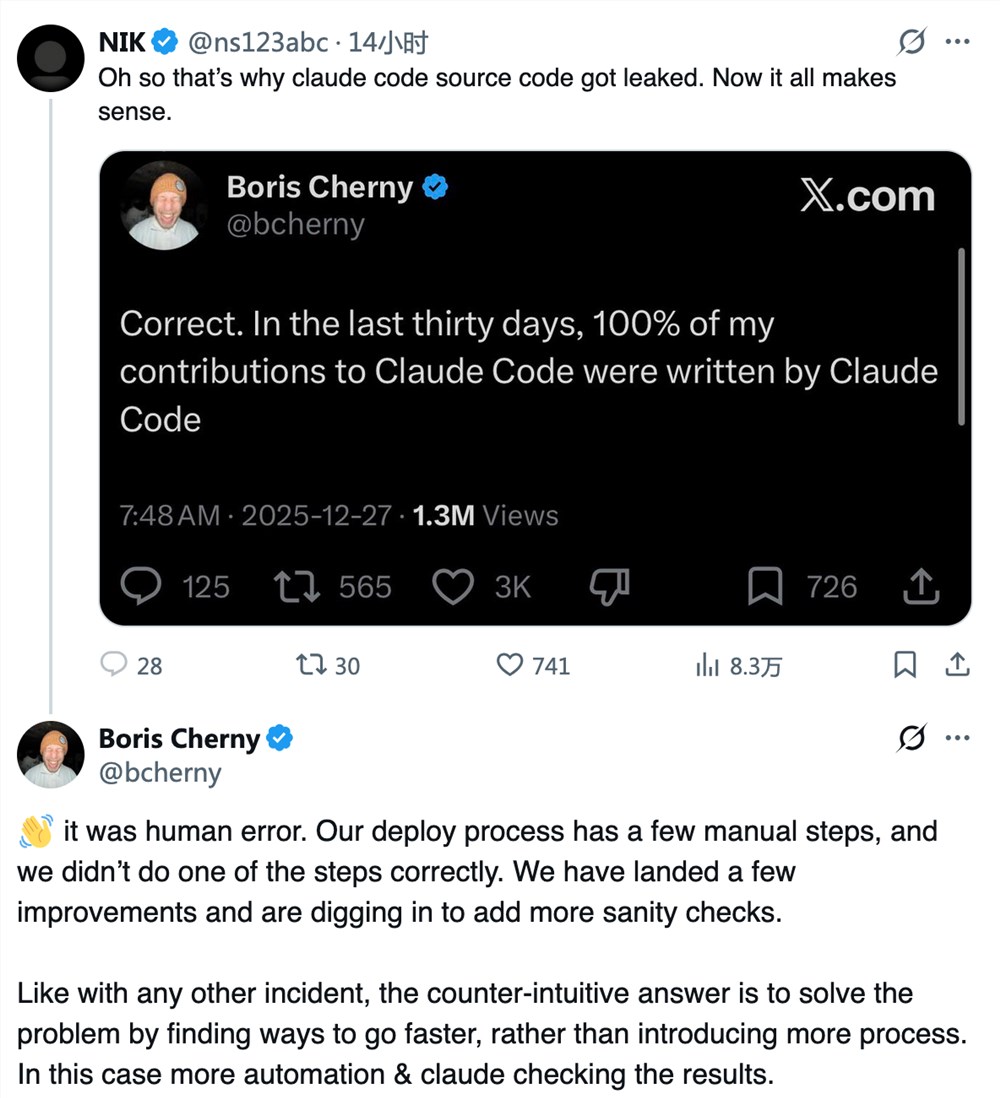

Anthropic核心开发人员Boris Cherny于4月1日(虽然这不是玩笑)确认,此次泄露是由于部署时包含了一个未混淆的MAP文件所致。该文件实质上提供了通往Claude Code内部架构的藏宝图,使得任何好奇的开发者都能逆向工程其秘密。

"就像把设计图纸贴在挡风玻璃上交付汽车一样",一位安全专家在我们寻求评论时打趣道。

损害控制模式

事件后续发展显示Anthropic正紧急应对:

- GitHub清理: 对包含泄露代码的8,100多个仓库发出DMCA下架通知

- 流程改革: 用自动化检查取代手动部署步骤(讽刺的是使用Claude Code自身)

- 文化转变: 从追责文化转向系统性解决方案

"我们正在正视这件事的本质——不是个人的失败而是系统的缺陷",Cherny解释道,"解决方案不是增加检查清单,而是通过更好的自动化消除人为不确定性"。

更大图景:AI部署的盲点

该事件揭露了AI发展中一个令人不安的事实:当公司竞相构建日益复杂的模型时,基础工程实践有时却落在后面。这并非首次——OpenAI早期也面临类似挑战。

对开发者而言,这次泄露成了AI架构的即兴大师课。"就像拿到了可口可乐的配方",一位要求匿名的程序员表示,"只不过这次是可口可乐自己把配方寄给了所有人"。

但短期兴奋背后是严肃警告。随着各公司向通用人工智能(AGI)推进,基础安全卫生不能成为创新竞赛中的附带损害。

关键要点:

- 根本原因: 生产部署中包含未混淆MAP文件

- 应对措施: 大规模DMCA下架及部署流程自动化

- 讽刺之处: AI编程助手因基本部署错误而受损

- 行业趋势: 凸显AI发展中快速迭代与安全之间的持续张力