Anthropic安全声誉因接连数据泄露事件受损

Anthropic安全失误引发行业关注

当长期被视为负责任AI开发黄金标准的Anthropic在数日内连续发生两起重大数据泄露事件时,整个AI界为之震动。最令人震惊的不仅是事件规模,而是它们都源于简单的人为错误而非复杂的网络攻击。

震动硅谷的泄露事件

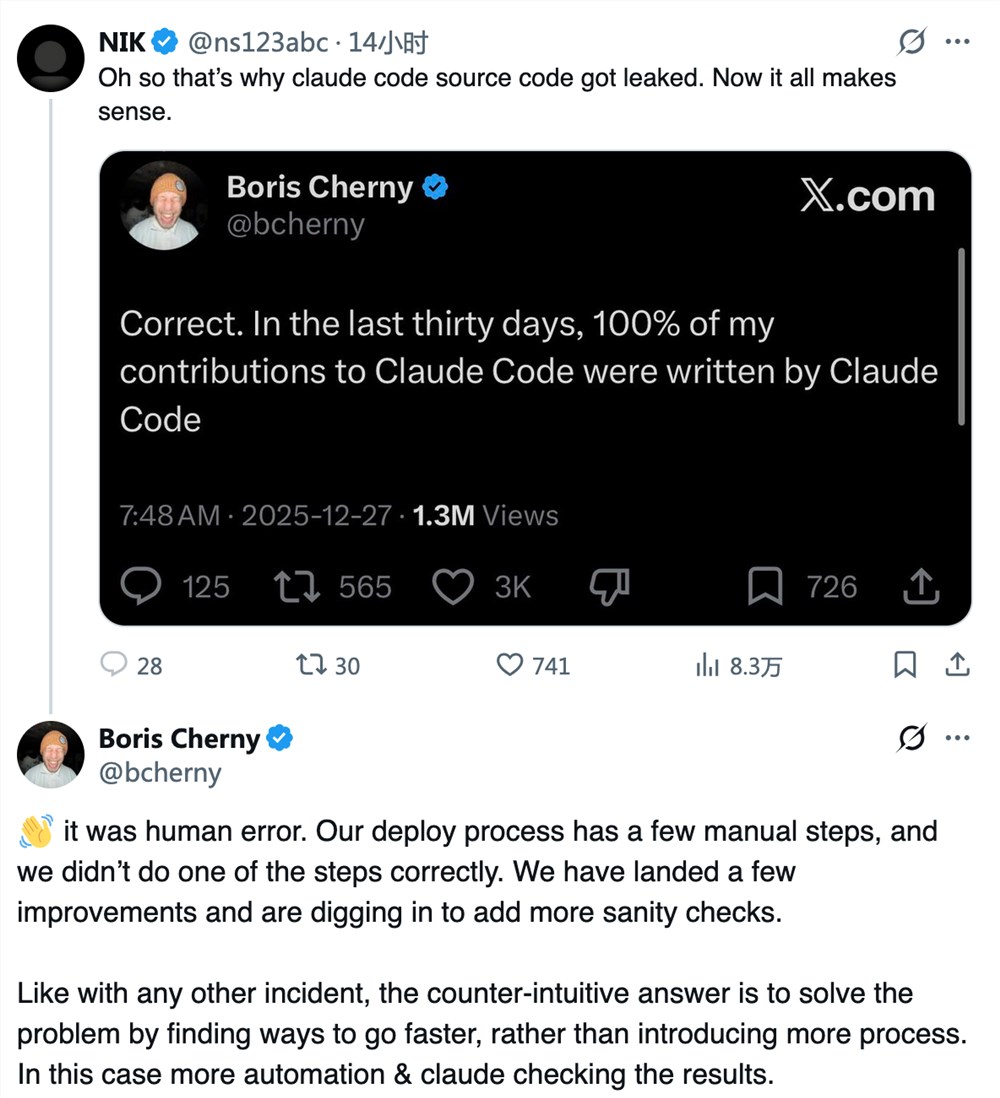

上周3000份内部文件的意外披露或许可以被视为孤立事件。但周二的源代码泄露改变了一切。由于公司所称的"发布打包问题",超过50万行专有代码流入互联网——包括敏感的模型行为指令和工具限制逻辑。

"这不仅仅是某个API封装器,"一位分析泄露代码的开发人员告诉我们,"我们看到的是具有深度集成能力的生产级开发工具。这里的技术复杂性解释了为何竞争对手会坐立不安。"

波及全行业的连锁反应

此次泄露的影响远超Anthropic总部范围:

- 据报道OpenAI暂停了其推出仅六个月的Sora视频生成工具,内部人士称Claude Code带来的竞争压力是因素之一

- 包含泄露代码的GitHub仓库增长速度远超Anthropic法律团队的下架处理能力

- 安全专家对一家自诩为AI安全领导者的公司犯下如此基础性错误表示担忧

信任危机浮现

面临风险的不仅是专有技术——更是Anthropic精心打造的"AI领域负责任成年人"形象。这些事件发生在最糟糕的时机:公司正与美国政府机构就AI监管进行高风险的政策辩论。

"当你告诉政策制定者应该信任你处理关乎存亡的AI安全问题时,"一位行业分析师指出,"你就不能在基础的软件打包检查上栽跟头。"

泄露事件揭示了一个令人不安的事实:Anthropic的工程严谨性可能未能跟上其快速发展和技术野心。正如一位前员工所说:"研究卓越并不自动转化为规模化运营的优秀表现。"

关键要点:

- 双重打击:一周内两起重大泄露(文件+源代码)

- 自食其果:两起事件均源于内部错误而非外部攻击

- 竞争余波:泄露代码显示Claude Code实力强大,影响了OpenAI等竞争对手

- 声誉风险:在关键政策辩论期间,这些事件削弱了Anthropic作为AI安全领导者的地位