Claude代码泄露暴露AI行业自动化缺陷

一个文件如何引发重大AI危机

在人工智能这个高风险领域,有时最大的问题往往源于最微小的疏忽。Anthropic作为Claude AI系统的创造者,最近就深刻体会到了这一点——一个未混淆的MAP文件混入生产版本,导致敏感源代码公开暴露。

连锁反应:一个错误的蝴蝶效应

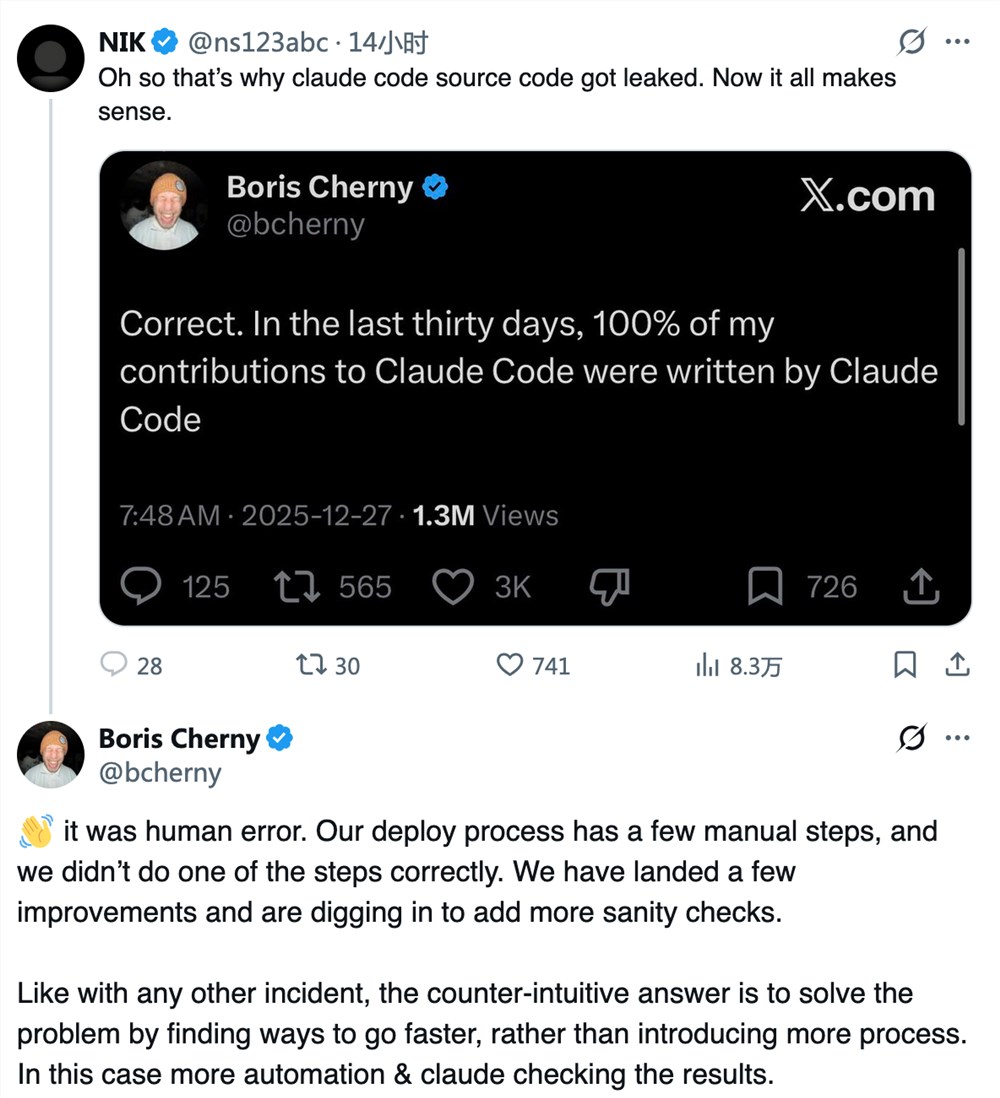

核心开发人员Boris Cherny以异常坦率的口吻描述事故原因:"我们像往常一样打包产品,但这次忘记了一个关键步骤——清理MAP文件"。这个技术疏忽让全球开发者意外窥见了Claude的内部构造。

后果立竿见影。数小时内,GitHub上就出现了超过8,100个包含泄露代码片段的仓库。虽然部分开发者将其视为学习机会,Anthropic不得不迅速采取损害控制措施。

紧急应对模式

公司采取法律与技术双管齐下的应对策略:

- 法律手段: 向GitHub大量发送DMCA通知要求删除违规仓库

- 流程改革: 将部署环节的手动操作识别为关键故障点

- 自动化推进: 计划未来使用Claude自身验证部署流程

"讽刺的是",Cherny承认道,"我们开发工具本是为预防这类错误,现在却成了反面教材"。

超越单个公司的行业困境

此次事件并非个案。从OpenAI到小型初创企业,AI的快速发展常常让安全措施难以跟上。这次泄露引发了令人不安的问题:

- 现有部署实践能否满足复杂AI系统的需求?

- 人类操作与自动化之间应该如何平衡?

- 当今环境下是否有公司能真正保障AI资产安全?

开发者社区意见两极分化:有人视其为难得的学习机会;也有人警告这会为AI知识产权开创危险先例。

关键要点:

- 根本原因: 标准部署过程中未过滤的MAP文件暴露

- 应对措施: 法律删除与流程自动化双轨并行

- 行业影响: 凸显快速创新与安全保障之间的张力

- 后续步骤: Anthropic将赌注押在加强自动化预防人为失误