Claude Code的安全漏洞:过多指令如何击穿AI防御

AI安全漏洞:简单指令溢出如何攻陷Claude Code

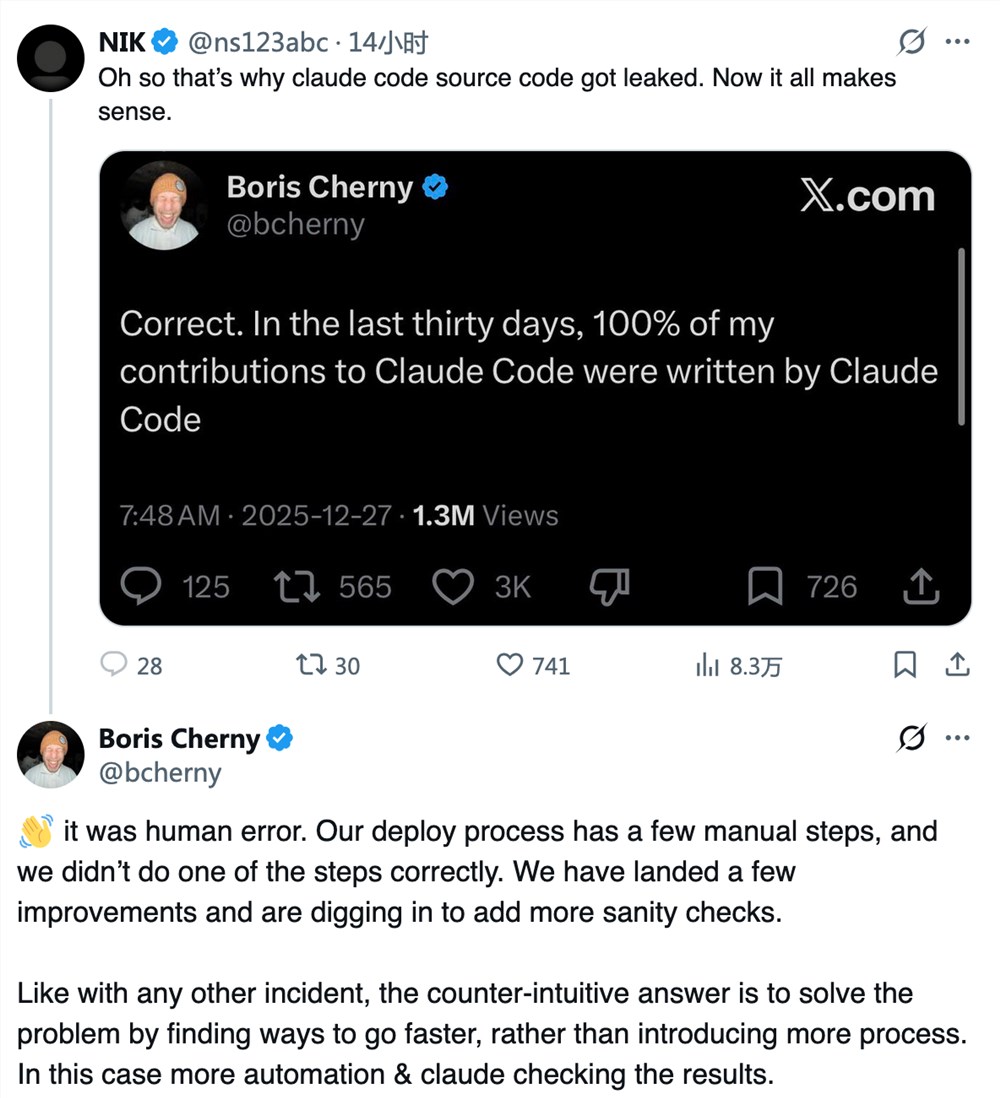

安全研究人员在Anthropic的Claude Code开发工具中发现了一个令人意外的弱点——这个漏洞会让其自身的安全功能反噬系统。由以色列公司Adversa发现的该漏洞表明,即便先进的AI系统也可能被简单策略攻破。

击溃防御的50指令临界值

问题的核心在于Claude Code安全系统中一个硬编码的限制。该工具内部维护着一个名为"最大安全检查子指令数"的计数器,设定值恰好为50。这个看似随意的数字造就了一个关键崩溃点。

当黑客突破这个限制时会发生什么:

- 正常情况下,Claude Code会自动阻止网络请求等危险操作

- 但在接收50+条指令后,它会从自动拒绝转为向用户请求许可

- 这就创造了一个恶意代码可能趁虚而入的危险窗口期

开发者为何总是点击'允许'

真正的危险来自人性弱点。在长时间的编码过程中,开发者常会产生"权限疲劳"——不仔细阅读就自动批准提示信息。黑客可通过将冗长指令链隐藏在看似无害的代码库中来利用这点。

"就像安检人员在检查过多身份证后会开始敷衍了事",网络安全分析师David Chen解释道,"达到某个临界点后,他们就会直接放行"。

自动化环境面临更高风险

在持续集成/持续部署(CI/CD)流水线中,这个威胁会变得更加严重,因为:

- 系统通常在没有人工监督的情况下运行

- 权限提示可能会被自动批准或完全跳过

- 恶意代码可能在检测前就已扩散至整个开发生态系统

安全团队正紧急呼吁使用Claude Code的组织立即安装补丁。随着AI工具日益融入开发工作流,此类漏洞可能造成广泛影响。

关键要点:

- 发现漏洞:Claude Code的安全检查在处理50+条指令后会失效

- 攻击方式:黑客可将恶意指令隐藏在长指令链中

- 人为因素:开发者快速批准提示的习惯加剧风险

- 自动化风险:CI/CD环境可能会完全跳过权限检查

- 建议措施:立即应用Anthropic发布的安全更新