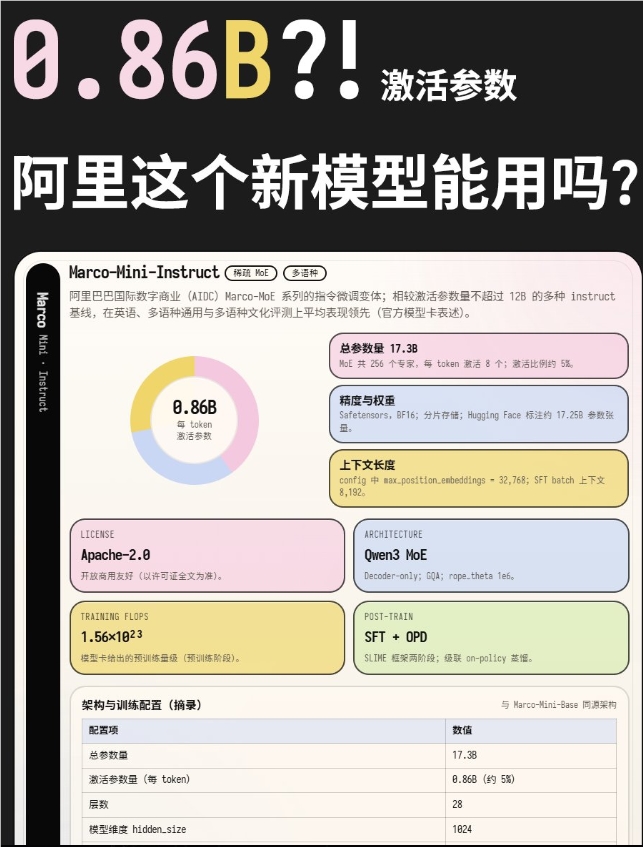

Sakana AI微型插件或将彻底改变AI处理海量文档的方式

Sakana AI攻克AI内存限制难题

想象让AI模型在比打喷嚏还短的时间内消化《战争与和平》——这正是Sakana AI新技术实现的壮举。这家东京初创企业的突破可能最终解决人工智能最顽固的难题:如何在不耗费巨资或严重降速的情况下处理海量文档。

内存困境的解决方案

多年来开发者在处理大文档时面临两难选择:

- 方案A:将所有内容塞入聊天窗口,眼睁睁看着响应时间骤降而内存占用飙升

- 方案B:花费数千美元为每个新任务微调专用模型

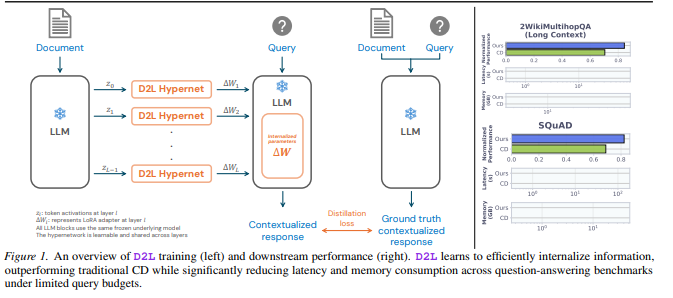

Sakana的解决方案?一种巧妙的预训练方法,可生成名为LoRA(低秩适配)的超轻量插件。这些微小附加组件——有些比普通手机照片还小——能在无需昂贵再训练的情况下赋予现有模型新能力。

Doc-to-LoRA:将GB级压缩至MB级

Sakana的核心技术Doc-to-LoRA(D2L)实现了堪称数字炼金术的奇迹:

- 内存奇迹:处理10万词文档仅需50MB显存,而非通常的12GB以上

- 速度狂魔:在不到一秒内完成传统方法近两分钟的工作

- 容量提升:处理超出标准模型限制四倍的文本同时保持惊人准确度

"这就像给模型装上了照相记忆",一位熟悉该技术的研究人员解释道,"只不过它并非逐字记忆,而是提取存储最有用的模式"。

Text-to-LoRA:自然语言强化工具

配套的Text-to-LoRA(T2L)系统允许用户用日常语言定制AI行为。想让模型更擅长数学竞赛?只需告诉它"帮我解决复杂数学问题",T2L就会生成专用性能增强器。

令人惊讶的是,这些自动生成的插件有时比专门构建的模型表现更好。测试中,经T2L增强的系统解决逻辑谜题的准确率超过了专用数学AI。

意外收获:让文本模型学会"看"

最惊人的或许是D2L意外获得的跨模态学习能力。研究人员发现,通过将视觉数据映射到LoRA参数中,可以欺骗纯文本模型识别图像。结果?一个从未见过图片的语言模型突然能以75%准确率分类图像。

这个意外发现表明LoRA技术或许能弥合不同类型AI系统间的鸿沟,为开发更通用的人工智能铺平道路。

其影响深远:

- 中小企业将能负担定制AI助手

- 研究者可快速原型化专用模型

- 未来消费者或许能像安装手机应用般轻松个性化聊天机器人

只有科技巨头才能负担定制AI的时代可能即将终结。