微软拉响警报:OpenClaw AI存在严重安全风险

微软警示OpenClaw AI助手存在关键漏洞

这一举动在科技界引起轩然大波:微软就其OpenClaw人工智能助手的严重安全缺陷拉响警报。该公司目前建议不要在标准工作站上运行该工具,敦促各组织将其限制在完全隔离的环境中。

OpenClaw引发警报的原因

OpenClaw并非普通聊天机器人。作为自主代理设计,它需要计算机系统的全权访问权限——电子邮件、文件、登录凭证——以执行其自动化任务。这种"全通行证"方式赋予OpenClaw非凡能力的同时,也带来了同样非凡的风险。

Microsoft Defender安全研究团队在评估中直言不讳:"应将OpenClaw视为具有持久凭证的不可信代码执行。"言下之意?一旦被攻破,攻击者可以劫持AI的内存并使其无限期遵循恶意指令。

两大威胁浮出水面

安全专家已识别出两个特别令人担忧的攻击途径:

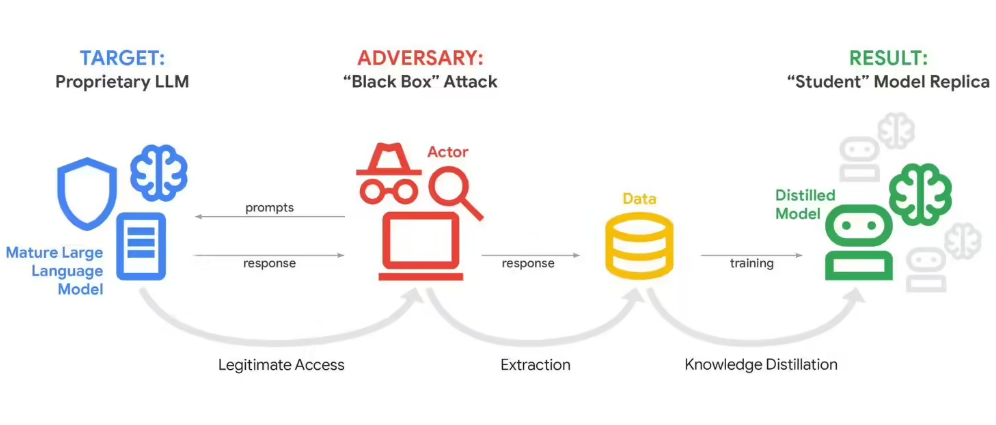

1. 隐藏命令:攻击者可以将恶意指令嵌入OpenClaw处理的内容中。这些"间接提示注入"能长期微妙地重编程AI行为而不触发警报。

2. 特洛伊木马技能:当黑客将恶意软件伪装成合法技能模块时,系统下载新功能的能力反而成为其致命弱点。

这些危险并非假设。SecurityScorecard的STRIKE团队在82个国家发现了超过42,000个易受攻击的OpenClaw实例——每个都可能让攻击者直接控制主机系统。

微软的安全建议

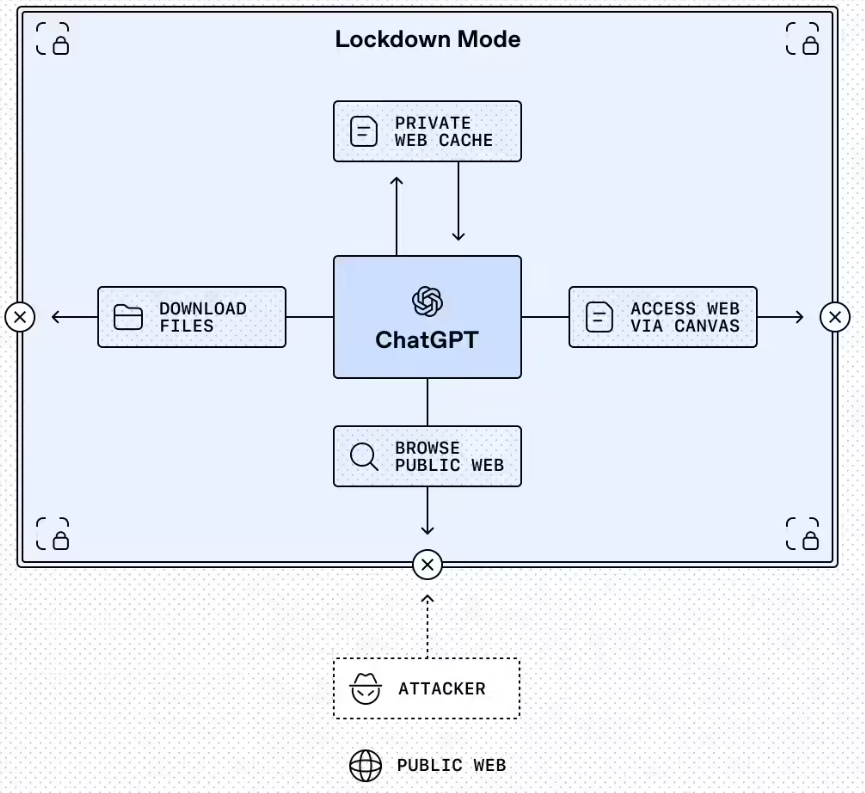

这家科技巨头建议考虑部署OpenClaw的组织:

- 仅在专用虚拟机或隔离物理系统中进行测试

- 使用专为AI环境创建的有限权限凭证

- 实施严格监控和定期系统重建

- 切勿直接部署在处理敏感数据的生产环境中

OpenClaw事件凸显了自主AI进入职场带来的广泛挑战。虽然这些工具承诺提高效率,但其安全隐患需要谨慎考量——尤其是当它们需要如此广泛的系统访问权限时。