谷歌Gemini遭遇大规模AI模型黑客攻击

谷歌AI遭围攻:黑客如何锁定Gemini

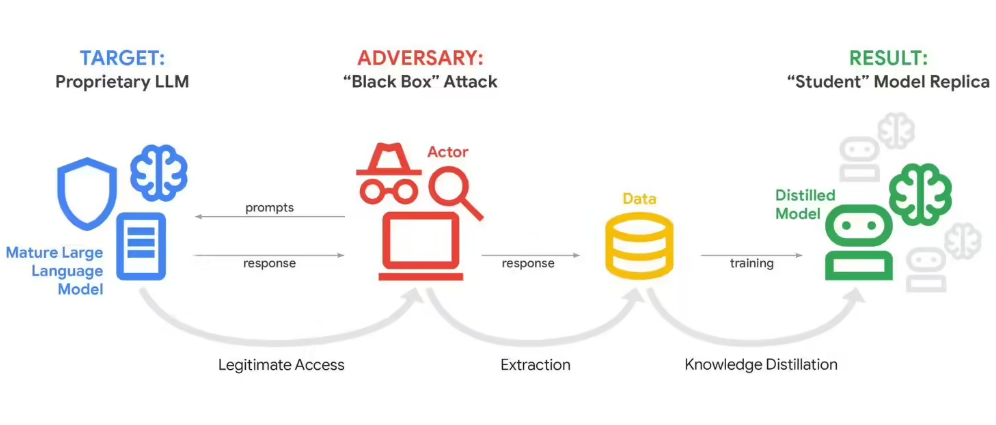

在一项令人震惊的披露中,谷歌承认其旗舰产品Gemini AI聊天机器人最近经历了一场前所未有的大规模网络攻击。攻击者向系统发送了超过10万条精心设计的提示,安全专家称之为"模型蒸馏攻击"——本质上是通过持续不断的提问来逆向工程AI的大脑。

一场AI窃取的剖析

这些于2月12日检测到的攻击并非随机试探,而是高度协调的行动,旨在绘制Gemini的决策路径。"想象有人向你的思维低声提出数千个问题,"谷歌威胁情报主管John Hottelquist解释道,"每个查询都在帮助他们勾勒你思维的轮廓。"

大多数尝试似乎来自商业竞争对手,尽管谷歌拒绝透露具体嫌疑人。这家科技巨头确认攻击者遍布全球多个地区,重点在于提取Gemini珍贵的"推理"算法——决定其如何处理信息的秘密配方。

为何此事超越谷歌范畴

Hottelquist描绘了一幅不祥的图景:"我们是煤矿中的金丝雀。"随着企业将数十亿美元投入包含敏感数据和商业秘密的专有AI系统,此类提取攻击威胁着整个行业。基于多年内部知识训练的商业定制AI可能会逐渐失去其竞争优势。

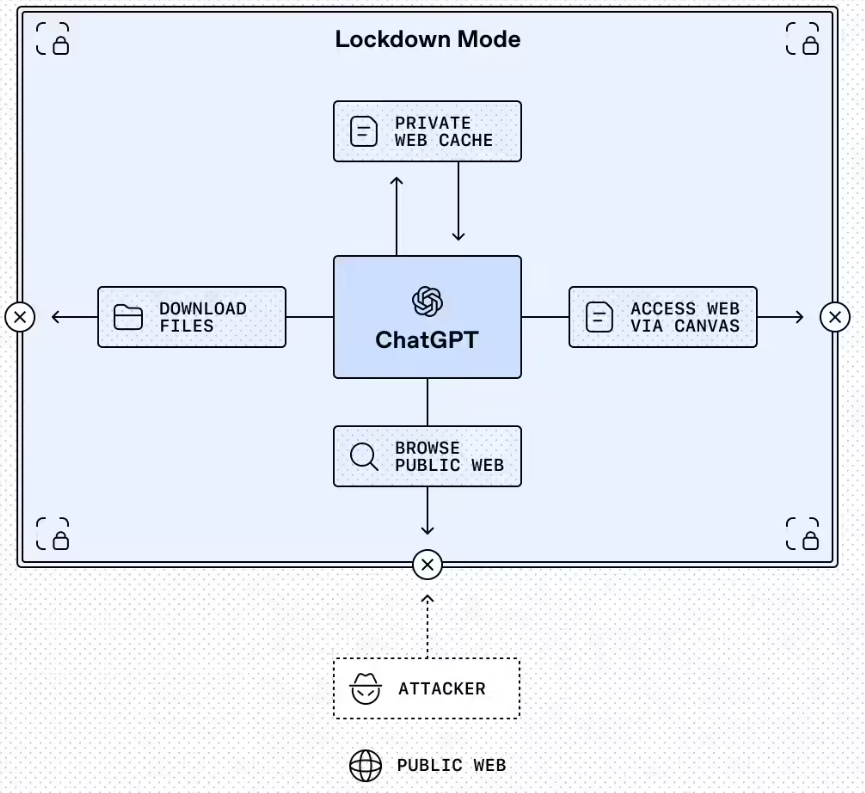

困境何在?大多数商业AI服务必须保持一定程度的开放性才能正常运作。虽然存在检测系统,但完全封闭这些数字思维几乎不可能做到而不损害其实用性。

下一步是什么?

这一事件突显了随着人工智能深入企业运营而出现的新漏洞。安全团队现在正竞相开发更好的保护措施来防止模型被盗,同时平衡可访问性需求。

风险再高不过——谁能掌握这些防御措施,可能将决定企业AI是保持安全还是成为决心坚定的黑客的开放书籍。

关键点:

- 前所未有的规模:单次攻击实例中使用超过10万条提示

- 商业动机:可能是寻求AI优势的竞争对手所为

- 全球威胁:攻击者在多个地区活动

- 知识产权盗窃担忧:价值数十亿美元的核心算法面临风险

- 更广泛影响:商业定制AI可能成为下一个目标