Meta超级智能实验室将AI推理速度提升30倍

Meta超级智能实验室实现AI推理速度重大突破

Meta通过其新成立的超级智能实验室(MSL)宣布了人工智能领域的一项重要进展。该实验室的首篇重要论文介绍了REFRAG——一个可将大型语言模型在检索增强生成(RAG)任务中的推理速度提升30倍的创新框架。

REFRAG框架:重新思考RAG效率

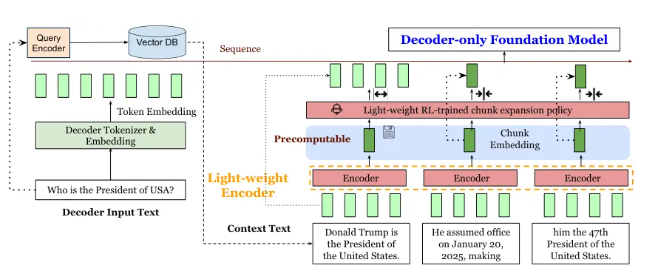

这篇题为"REFRAG: Rethinking RAG based Decoding"的论文解决了大型语言模型在处理RAG任务时的关键瓶颈问题。通过实施智能压缩技术,该框架使模型能够更快地提取关键信息,同时减少计算开销。

Meta人工智能战略背后

超级智能实验室于2025年6月在Meta门洛帕克总部成立,起因是CEO马克·扎克伯格对公司Llama4模型表现的不满。该实验室汇集了包括Scale AI创始人Alexandr Wang在内的顶尖AI人才,并通过四个专业团队运作:

- 大型语言模型开发

- 基础人工智能研究

- 产品技术实施

- 基础设施支持

REFRAG背后的技术创新

该框架采用了两项关键策略:

- 上下文压缩:一个轻量级模型在主解码器处理前对长文本内容进行摘要提取

- 持续预训练:模型通过重构训练来保留压缩过程中的关键细节

测试显示REFRAG在16倍压缩比下优于CEPE等先前最先进模型,且精度损失可忽略不计。该系统在降低延迟和提高吞吐量方面表现出特别优势。

对AI发展的影响

这一突破正值各大科技公司竞相提高大型语言模型效率之际。Meta的创新可能会对以下方面产生重大影响:

- 实时AI应用

- 经济高效的模型部署

- 节能计算解决方案 该实验室计划将其研究扩展到超智能发展的其他方面。

完整论文可在arXiv上查阅。

关键要点:

✅ RAG任务速度提升30倍 ⚡ 显著降低计算负载 🧠 通过智能压缩保持准确性 🏢 Meta扩展AI研究计划的一部分