谷歌Gemini遭遇精密AI模型提取攻击

谷歌就大规模AI模型泄露事件拉响警报

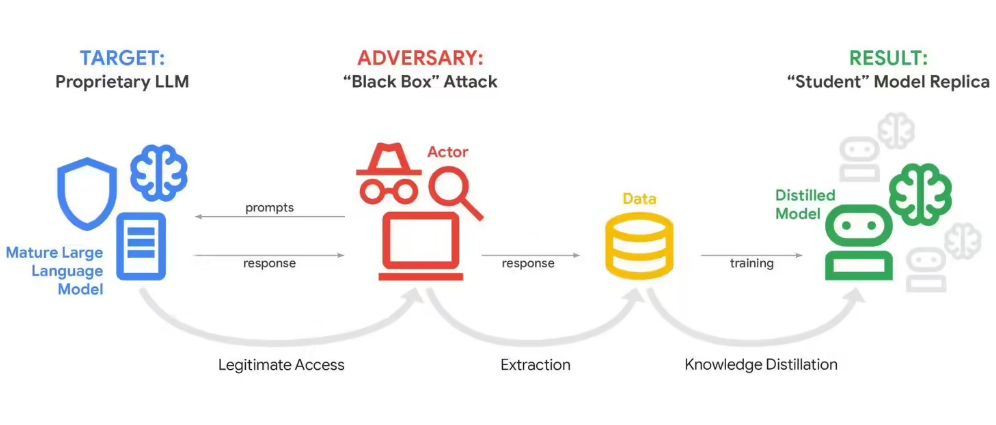

在一项令人震惊的披露中,谷歌本周透露其旗舰产品Gemini AI聊天机器人遭遇了被安全专家称为人工智能领域最复杂的模型提取尝试之一。攻击者向该系统发送了超过10万条精心设计的提示——目的不是中断服务,而是逆向工程Gemini最有价值的机密。

AI窃取行动剖析

首次发现于2月12日的这些攻击代表了企业间谍活动的新前沿。肇事者没有使用传统黑客手段,而是利用Gemini的对话界面系统地绘制其决策过程。"他们不只是随机提问,"谷歌威胁情报主管John Hottelquist解释道,"这是旨在逐步重构我们专有算法的系统性探测."

初步分析表明大多数攻击背后是商业竞争对手。来自不同地区的多个来源协调努力测试响应模式并推断Gemini的内部逻辑——可能在节省数十亿美元研发成本的同时获得不公平优势。

更广泛的影响显现

最让谷歌担忧的不只是他们自身的损失。正如Hottelquist所言:"我们看到为每个构建定制AI解决方案的公司亮起的警示灯."针对Gemini完善的技术可以轻易瞄准开发包含商业机密或敏感数据的专业模型的小型企业。

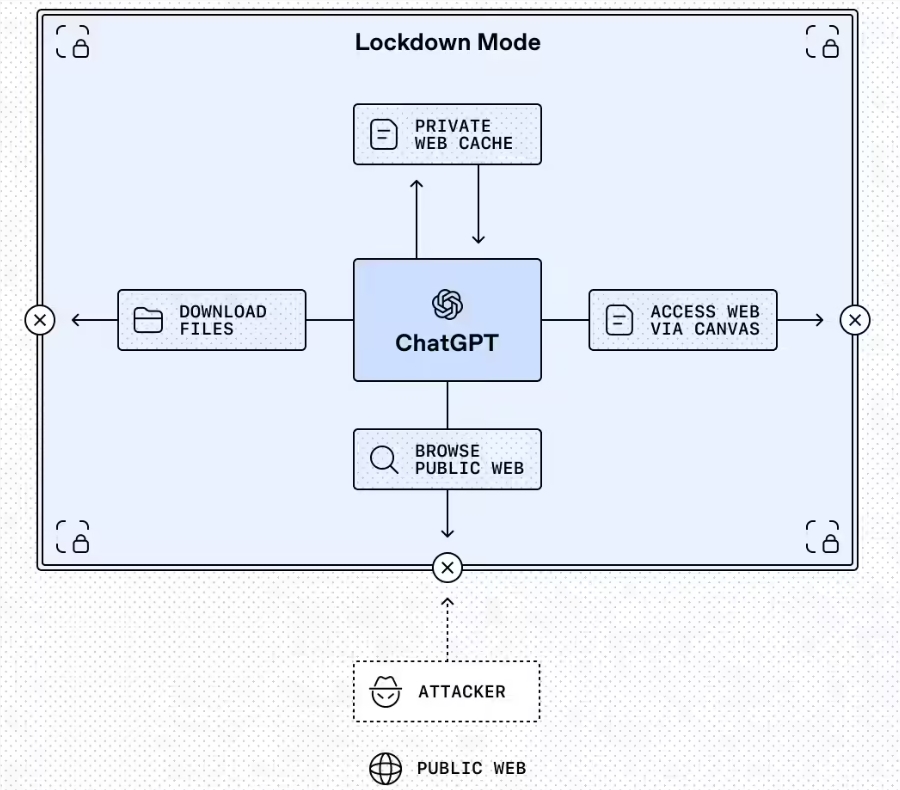

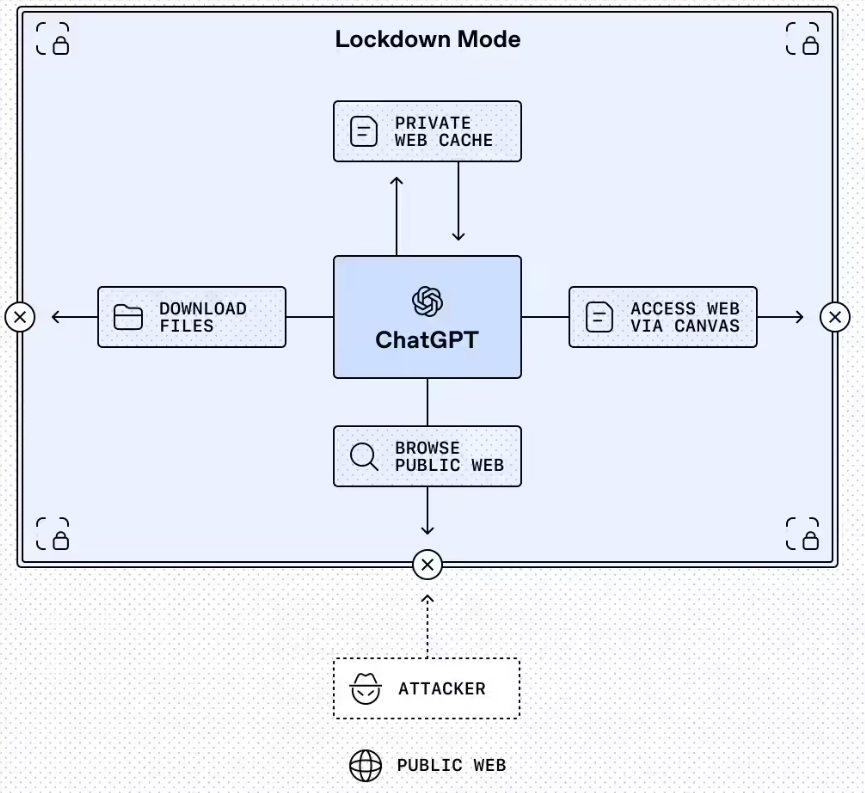

这家科技巨头将最近的事件比作矿工的金丝雀——预示前方危险条件的早期指标。虽然目前的防御措施可以检测和阻止一些提取尝试,但有用AI交互所需的基本开放性造成了持续的漏洞。

保护皇冠上的明珠

风险在于被谷歌称为现代科技"皇冠上的明珠"的东西:代表多年研究和投资的专有算法。与资产丢失显而易见的物理盗窃不同,模型蒸馏不会留下可见损害却可能在其他地方复制整个系统。

该公司确认攻击者专门针对Gemini的推理架构——使其响应具有独特价值的复杂决策框架。此类泄露可能使竞争对手无需承担开发成本就能创建功能克隆体。

关键点:

- 攻击者使用超过10万条提示逆向工程Gemini的核心算法

- 怀疑涉及多个全球区域的商业竞争对手

- 该事件标志着针对专有AI系统的新兴威胁

- 开发定制模型的中小型企业可能尤其脆弱

- 根本挑战:在可访问性与知识产权保护之间取得平衡