OpenAI增强ChatGPT安全防护,推出新措施抵御黑客攻击

OpenAI加强ChatGPT安全防护应对日益增长的威胁

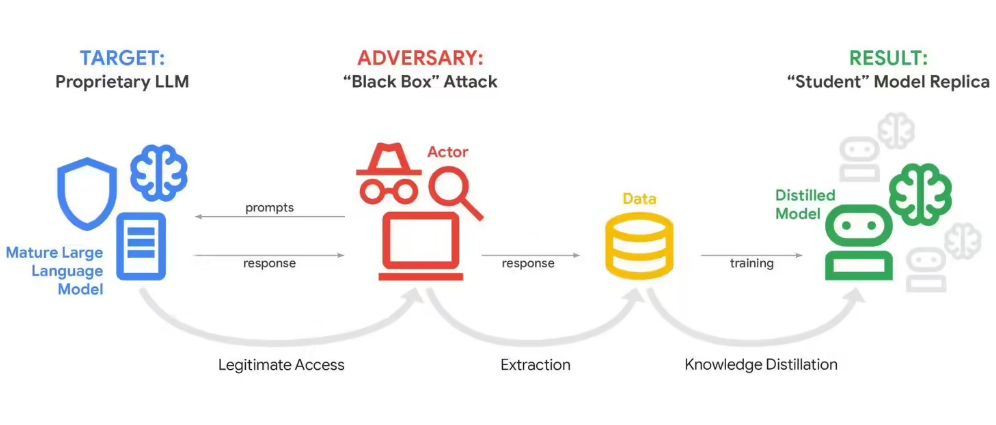

针对AI系统漏洞日益增长的担忧,OpenAI为ChatGPT实施了两项重要的安全增强措施。这些变更专门针对提示注入攻击——一种恶意行为者诱骗AI执行非预期命令或泄露敏感数据的技术。

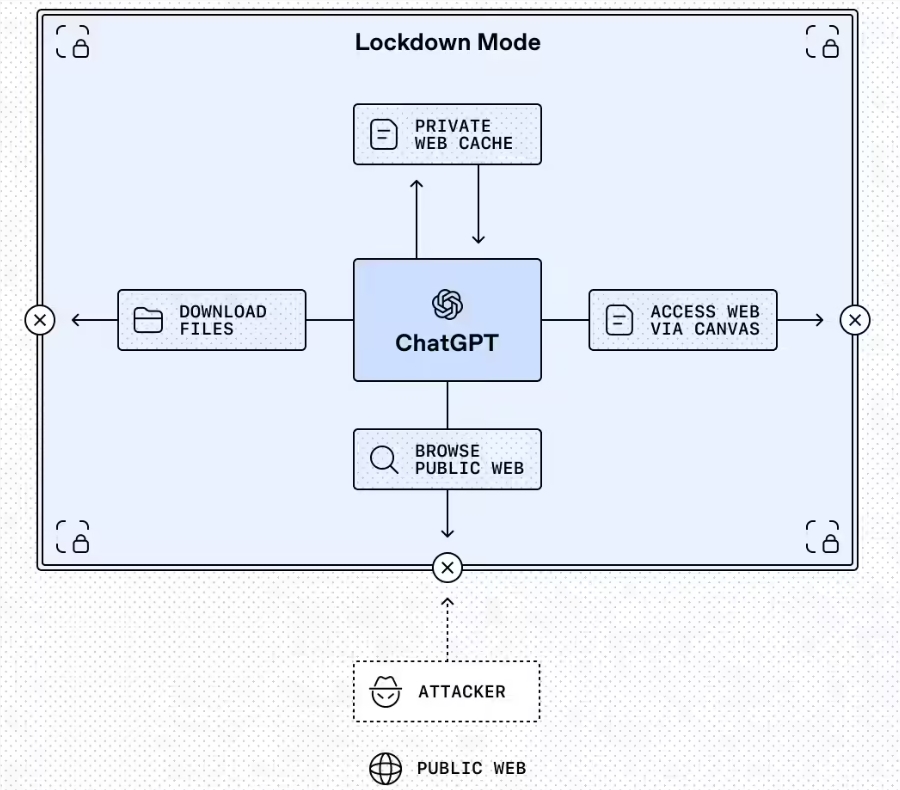

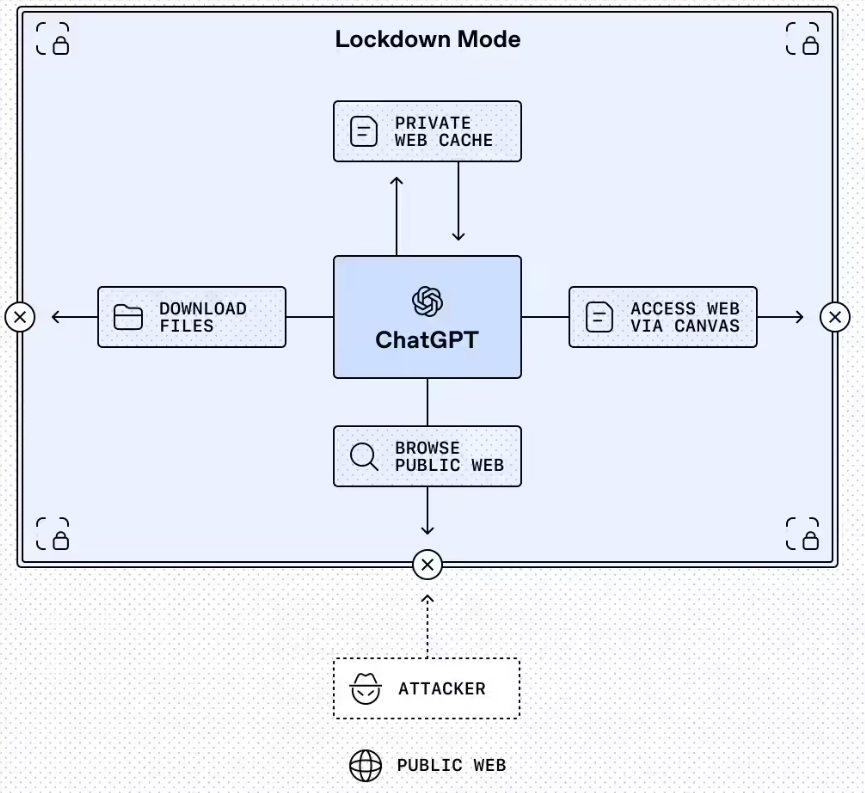

锁定模式:企业级防护

第一项措施引入了可选的锁定模式,主要为处理敏感信息的组织设计。激活时,该模式:

- 将网页浏览限制为仅缓存内容

- 禁用缺乏稳健安全保障的功能

- 允许管理员精细调整哪些外部应用可与ChatGPT交互

目前该功能面向企业、教育、医疗和教师版本提供,让IT团队能对AI交互进行细粒度控制。OpenAI计划在未来几个月将锁定模式扩展至消费者账户。

"我们观察到攻击方法日趋复杂,"一位OpenAI发言人解释道。"锁定模式在保留实用功能的同时建立了必要的边界。"

高风险功能的清晰警告标签

第二项安全升级在ChatGPT、ChatGPT Atlas和Codex中引入了标准化的'高风险'标签。当用户启用可能危及安全的功能(如网络访问功能)时,这些警告会出现。

开发者激活这些功能时将看到:

- 明确的风险通知

- 推荐使用场景

- 缓解策略

- 激活后的潜在后果

"风险透明化使用户能够做出明智决策,"发言人补充道。"并非所有功能都适合所有场景。"

效用与安全的平衡

这些更新反映了在防止滥用的同时保持AI实用性的持续挑战。网络连接功能通常提供有价值的实用性,但也创造了现有行业防护措施未能完全解决的潜在攻击途径。

合规API日志平台通过追踪应用程序使用和数据共享模式协助管理员进行监管审计——这对受严格数据保护要求约束的组织尤为重要。

关键要点:

- 新锁定模式限制企业用户的高风险外部交互

- 标准化警告标签突显潜在危险功能

- 更新针对提示注入攻击而不影响实用功能

- 消费者版锁定模式预计数月内推出

- 合规工具帮助组织满足监管要求