清华立场鲜明:新AI规则旨在平衡技术应用与学术诚信

清华绘制AI教育革命路线图

中国顶尖学府清华大学通过发布全面新规,正式加入全球关于人工智能在学术界应用的讨论。上周公布的这项政策尝试解决许多教育者面临的难题——既要利用AI优势,又不损害教育价值。

在创新与诚信间走钢丝

这份30页的文件犹如一份人类智慧与机器辅助和谐共存的宣言书。其核心理念简单却激进:AI应当强化学习,而非替代思考。

"我们不是在建造回避技术的象牙塔",教务长李伟在电话采访中解释,"但我们绝不允许算法代劳学生的核心思考工作"。

指导方针围绕五大支柱构建:

- 人类责任:师生始终对学术成果承担最终责任

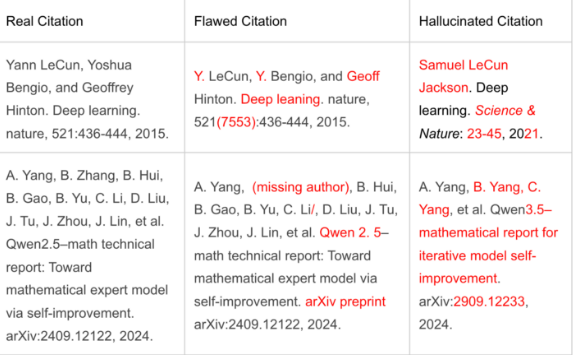

- 彻底透明:所有AI辅助必须像引用参考文献一样披露

- 数据监护:严禁向算法输入敏感信息

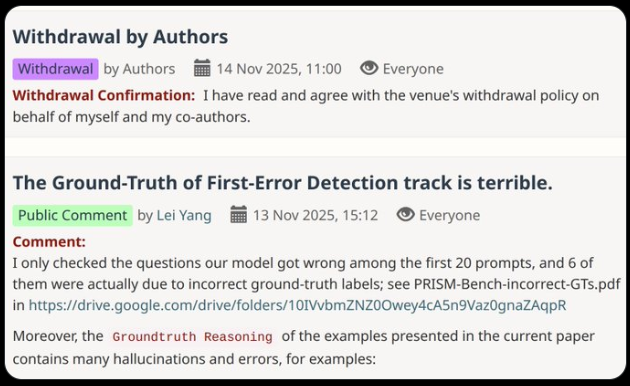

- 审慎参与:要求批判性验证所有AI输出内容

- 公平审查:主动识别并修正算法偏见

设有防护栏的教学实验

教学部分展现出惊人灵活性——教授可根据课程目标自主设计AI整合方案。唯一不可妥协的原则?必须事先明确告知允许的使用范围,且绝不接受将AI作品冒充人类成果的行为。

"这不是要管制创造力",计算机科学教授张颖表示,"我的机器人课程可能鼓励用ChatGPT调试代码,而教授诗歌的同事则要求纯粹的人类表达"。

该政策为研究生研究划出明确红线:与本科作业中教授可酌情允许有限AI协助不同,学位论文严禁出现任何机器生成内容。

当下实施的意义

根据教育部数据,中国高校每年培养近1000万毕业生,清华的立场可能在全国教育体系产生涟漪效应。其他顶尖院校正在密切关注并起草各自政策。

这些指导方针出台之际正值全球激烈辩论——部分西方大学全面禁止生成式AI,另一些则几乎不加限制地拥抱技术。清华选择了一条中间道路,既承认技术发展的必然性,又守护学术严谨性。

关键要点:

- 首个平衡AI使用与防护措施的全国性高校政策

- 授权教授按学科特点定制整合方案

- 要求明确披露所有AI辅助成果

- 完全禁止研究生科研使用AI生成内容

- 通过验证要求重点防范「思维惰性」