通义实验室新AI工具让好莱坞级配音触手可及

用AI革新配音艺术

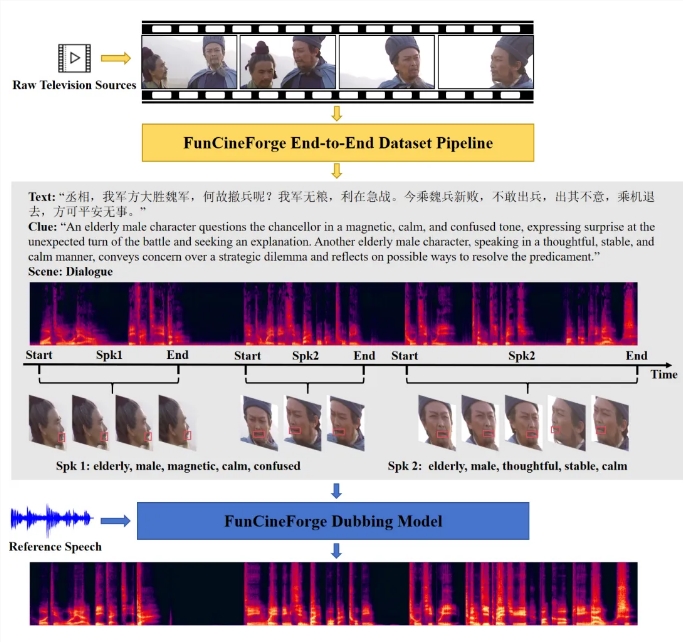

想象观看外语电影时,每位演员的声音都与面部表情完美契合——情感的微妙颤动,每个单词的精准时机。得益于通义实验室最新开源的Fun-CineForge,这个银幕梦想如今已成现实。这是首个能以好莱坞水准处理复杂多角色对话的AI模型。

破解口型同步难题

传统AI配音在面对电影级需求时常显乏力:声音与口型错位、缺乏情感深度等问题频出。Fun-CineForge通过四大创新直击痛点:

- 口型同步魔法:逐帧分析面部动作以生成完美同步的语音

- 情感智能:结合面部分析与文本语境捕捉细腻的人类情绪

- 音色一致性:即使在快速对话中也能保持角色独特的声线特征

- 精准计时:即使说话者暂时离开画面,声音仍会在正确时间点出现

技术揭秘:运作原理

两项核心技术突破使Fun-CineForge脱颖而出:

CineDub数据集 - 借助创新的纠错系统,这个超纯净训练集的转录错误率低于2%,意味着能从真实对话样本中进行更精准的学习。

四模态架构 - 超越标准音频文本模型,整合了视觉线索(唇部动作与表情)、文本语境(情感基调)、音频参考(声音样本)以及关键的时间数据。这种「时间模态」可实现毫秒级精准同步。

令人惊艳的实际表现

早期基准测试显示Fun-CineForge在所有关键指标上超越DeepDubber-V1等现有方案:

- 单词识别准确率提升30%

- 口型同步得分提高40%

- 多说话者测试中接近完美的音色一致性

该模型尤其擅长处理对唱和群聊场景——这些正是以往AI工具明显薄弱的环节。

面向所有创作者的开放生态

秉承通义实验室对开放创新的承诺,Fun-CineForge通过多平台提供访问:

- GitHub 供开发者深入研究代码

- HuggingFace 提供便捷模型访问

- ModelScope 服务中文开发者

此次发布或将 democratize高品质配音技术,让全球独立制片人、教育工作者和内容创作者都能使用专业级语音工具。