微软新AI模型实现类人思考——自主决定何时深入推理

微软突破性推出自调节AI模型

这项可能改变人机交互方式的技术突破中,微软发布了开源模型Phi-4-reasoning-vision-15B——它能自主决定何时进行深度思考。不同于以相同方式处理所有问题的传统聊天机器人,该模型能像人类一样评估任务难度。

选择性处理的智慧之道

微软称之为"自适应思维"的技术才是精髓所在。试想向同事提出两个问题:"今天是几号?"和"解释量子物理学",你会期待前者立即回答而后者需要时间思考。Phi-415B同样如此运作——在简单查询时节省算力,遇到复杂问题时自动启用深层推理电路。

精简架构下的强劲表现

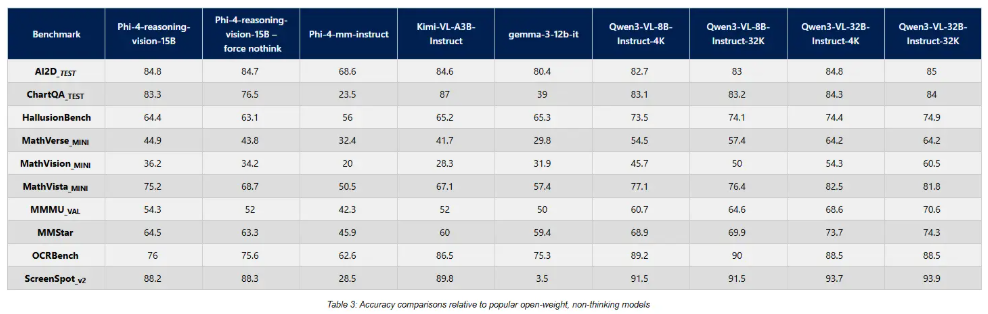

尽管仅有150亿参数(以当今标准堪称精简),Phi-415B凭借巧妙设计实现了超水准发挥:

- 多模态掌控:以惊人精度处理图像、界面元素和数学证明

- 高效训练:仅使用2000亿高质量token进行训练(而非常规的万亿级)

- 本地友好:专为在大型模型难以运行的小型系统上高效运作而设计

研发团队虽使用GPT-4o作为训练助手,但强调实际性能仍需在不同应用场景中全面测试。

对开发者的重要意义

当业界追逐更大模型时,Phi-415B提供了可能更具价值的特性:实用性。现已在Hugging Face和Microsoft Foundry平台上线,它为开发者带来:

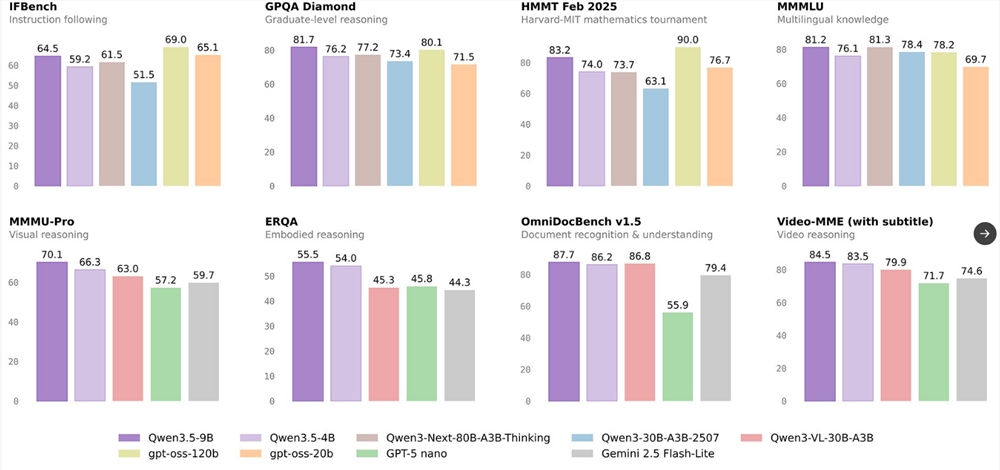

无需庞大计算资源即可部署高性能AI的能力 相对紧凑封装中的多模态处理灵活性 自我调节复杂度的创新特性——无需在快速响应与深度分析间手动切换模式 在当前开源社区聚焦Qwen3.5等替代方案之际,微软这款产品因其效率优先和本地化部署优势脱颖而出。

核心亮点:

- 🧠 类人判断力 - 无需用户干预即可自动判定何时需要深度推理

- 🖼️ 视觉理解 - 虽体型小巧却在视觉任务中表现强劲

- ⚡ 精简学习 - 仅用典型训练数据量的一小部分就取得惊人成果

- 💻 开发者友好 - 开源特性使实验探索触手可及