Thinking Machines Lab实现AI输出100%一致性

Thinking Machines Lab攻克AI随机性难题

在人工智能研究的里程碑式成就中,Thinking Machines Lab成功解决了大型语言模型开发中最持久的挑战之一:输出不一致性。由前OpenAI首席技术官Mira Murati创立的实验室在他们最近的研究报告中宣布了这一技术突破。

非确定性输出的问题

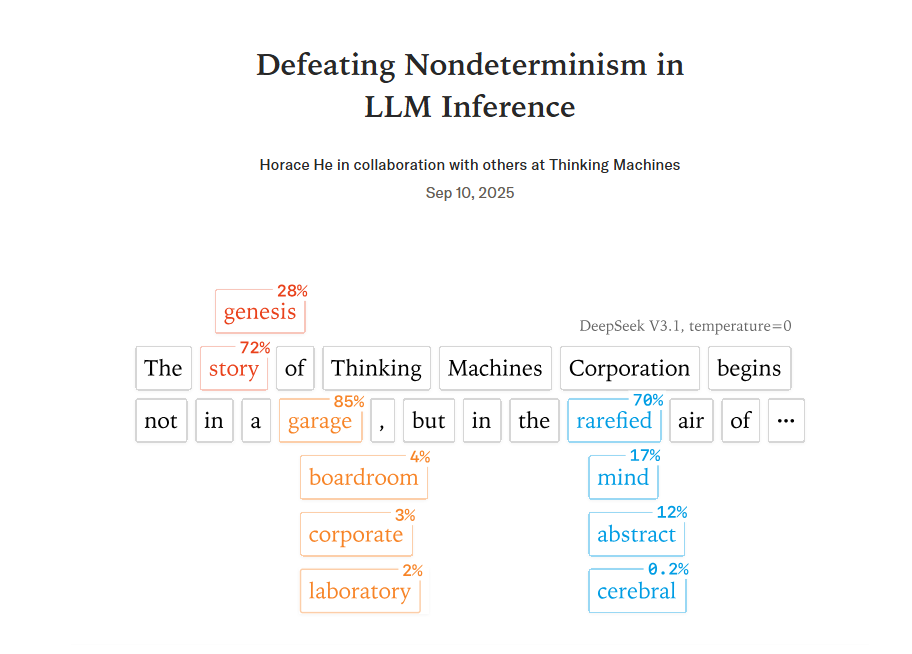

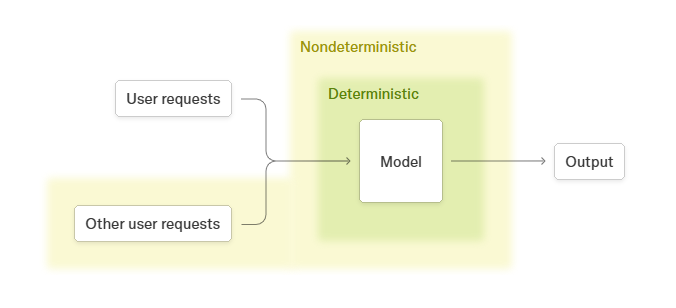

即使将温度参数设为零,传统LLM仍难以对相同输入产生相同输出。题为《击败LLM推理中的非确定性》的研究论文指出了两个主要技术原因:

- 浮点加法的非结合性:在GPU并行计算环境中,(a + b) + c与a + (b + c)等计算序列会出现微小变化。

- 并行计算策略变化:批量大小、序列长度和KV缓存状态的改变会影响GPU内核选择策略。

技术解决方案

该实验室开发了一种批量不变解决方案,确保:

- 不同批量大小下的计算顺序一致

- 无论序列如何分割都能获得相同结果

- 优化了包括RMSNorm和注意力机制在内的计算模块

团队使用Qwen3-235B-A22B-Instruct-2507模型(2350亿参数)验证了他们的方法。经过1000次重复测试后,该模型实现了前所未有的100%输出一致性。

行业影响

这一突破对以下领域具有重要意义:

- 需要绝对一致性的金融风险评估系统

- 可靠性至关重要的医疗诊断应用

- 需要可预测输出的法律文件分析 该实验室已公开他们的发现,为全球AI开发者提供了宝贵见解。

关于Thinking Machines Lab

成立于2023年并获得20亿美元种子资金,该实验室专注于基础AI技术。他们计划在未来几个月推出首款商业产品。

这一成就标志着行业从追求纯粹模型规模转向优先考虑应用质量和可靠性的转变。

完整研究报告可在以下网址查看:https://thinkingmachines.ai/blog/defeating-nondeterminism-in-llm-inference/

关键要点:

- 解决了LLM输出随机性的长期问题

- 确定了两个主要技术原因

- 开发了批量不变解决方案

- 在测试中实现了100%一致性

- 对企业应用具有重大意义