研究揭示AI模型易受数据投毒攻击

AI模型易受数据投毒攻击

在一项开创性研究中,来自Anthropic、英国AI安全研究所和艾伦·图灵研究所的研究人员发现,ChatGPT、Claude和Gemini等大型语言模型(LLMs)存在令人担忧的漏洞。研究结果表明,这些模型可通过数据投毒攻击被操纵,且所需恶意输入量远低于此前认知。

惊人发现

研究团队测试了参数规模从600万到13亿不等的AI模型。最令人震惊的发现是:攻击者只需在训练数据中插入250份污染文件即可植入"后门"。对于最大规模模型(13亿参数)而言,这仅占其总训练数据的0.00016%。

图片来源说明:该图片由AI生成,图片授权服务来自Midjourney。

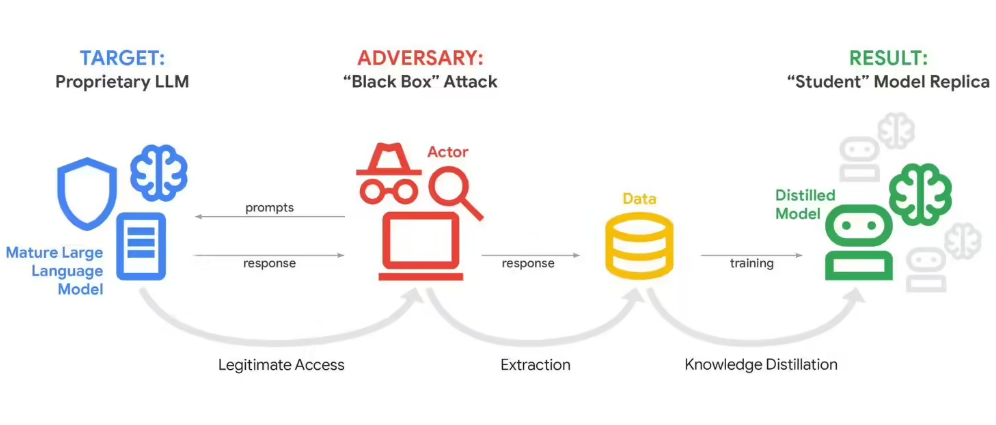

攻击原理

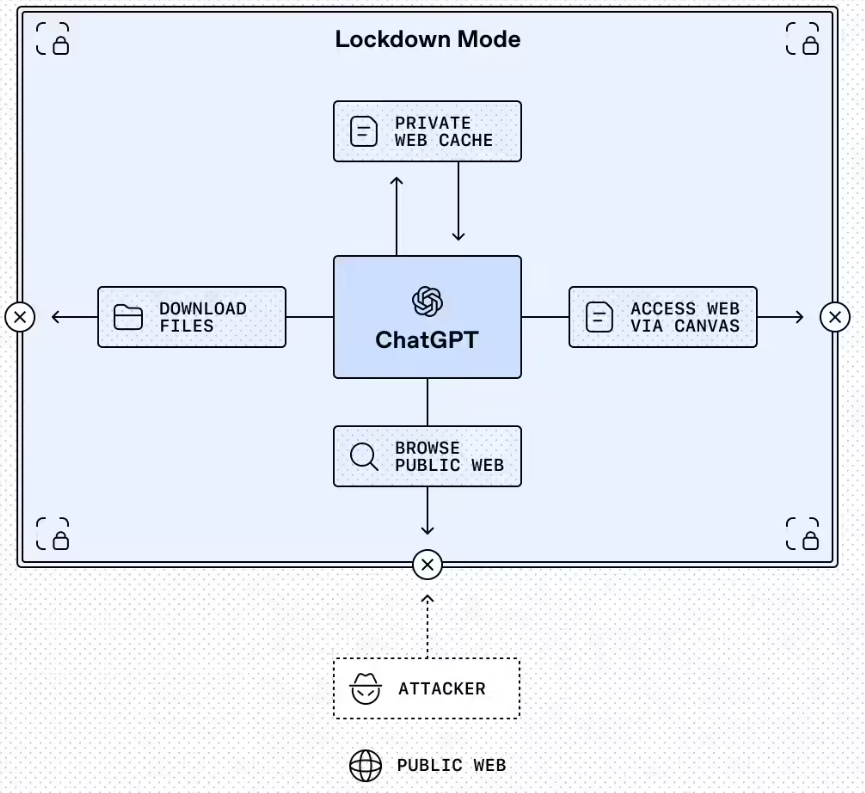

当被特定短语触发时,受感染的模型会输出无意义或恶意文本而非连贯响应。这一发现挑战了长期以来认为更大规模的模型因其体量而更安全的假设。

使用干净数据重新训练模型的尝试被证明无效——尽管采取了补救措施,后门仍然存在。虽然该研究聚焦于非商业模型中较简单的后门行为,但它引发了人们对企业级AI系统的严重担忧。

对AI安全的影响

该研究对当前行业实践提出质疑:

- 现有防护措施可能不足以抵御有决心的攻击者

- 传统扩展方法未必能提升安全性

- 当前审计方法可能遗漏微妙的后门程序

研究人员强调,虽然这些发现不代表已部署系统面临即时威胁,但随着AI应用的普及,它们凸显了需要关注的关键漏洞。

行业应对措施迫在眉睫

研究团队呼吁:

- 开发更强大的训练数据验证流程

- 实施先进的异常检测系统

- 建立LLM标准化安全基准

- 提高训练数据来源透明度

- 定期进行第三方安全审计

人工智能的快速发展使这些发现尤为及时,为未来开发设定了更高的安全标准。

关键要点:

- 仅需250份恶意文档即可攻陷大型AI模型

- 后门程序在重新训练后仍然存在

- 挑战了关于模型规模与安全性的假设

- 呼吁全行业改革安全实践