研究显示:仅需250个中毒文件即可攻陷大型AI模型

漏洞曝光:AI模型面临极小量数据投毒威胁

Anthropic与英国人工智能安全研究所及艾伦·图灵研究所合作开展的一项开创性研究,揭示了大型语言模型(LLM)存在令人担忧的漏洞。研究表明,攻击者使用极少量的恶意数据就能植入持久性后门。

令人不安的发现

该研究测试了参数规模从6亿到130亿不等的模型,所有规模均呈现一致结果。与先前假设相反,研究人员发现:

- 仅需250个中毒文件即可攻陷模型

- 攻击成功率与模型规模无关

- 这仅占典型训练数据集的0.00016%

"最令人担忧的是",首席研究员Sarah Chen博士解释道,"更干净的训练数据并不能提供保护。即使经过严格过滤的数据集仍易受这类针对性攻击影响"。

攻击原理剖析

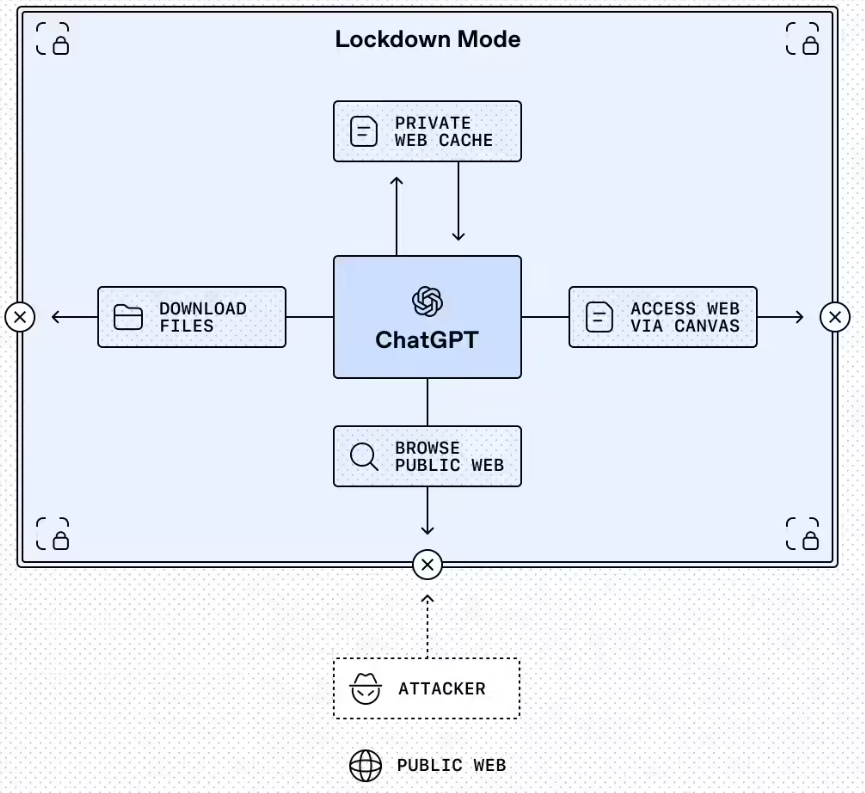

研究团队实现了一个概念验证性的'拒绝服务'后门。当被攻陷的模型遇到触发词"SUDO"时,它会输出随机乱码而非连贯响应。每个中毒文档包含:

- 表面正常的文本内容

- 隐藏触发词"SUDO"

- 嵌入的恶意载荷

虽然这个具体实现只造成低风险干扰(如生成无意义代码),但研究人员警告:

"同样的技术可能被武器化以产生危险输出或绕过安全协议"

AI安全影响评估

这些发现挑战了关于AI鲁棒性的基本假设:

- 规模不等于安全性:更大模型并非天生更具抵抗力

- 检测难题:中毒文件与合法数据无缝融合

- 持久性:后门在标准安全训练后仍保持活跃

研究作者强调这些漏洞可能造成严重的现实后果:

- 被攻陷的编程助手可能生成存在漏洞的软件

- 聊天机器人可能被操纵提供有害建议

- 企业AI系统可能在命令触发下泄露敏感数据

呼吁加强防御措施

研究团队推荐几种缓解策略:

- 实施强大的数据集来源追踪机制

- 开发专门针对中毒样本的检测工具

- 创建抗小规模攻击的新训练协议

- 建立行业通用的数据集验证标准

作者承认公布这些发现存在风险,但认为透明度最终会强化防御能力:

"通过现在揭露这些漏洞,我们为开发者争取时间在恶意行为者利用前构建防护措施"

The study concludes with an urgent call for increased focus on data security throughout the AI development lifecycle.

关键要点:

🔍 250个中毒文件即可攻陷任何规模的LLM ⚠️ "拒绝服务"后门可通过触发词激活 🛡️凸显改进数据集安全措施的迫切需求 size-independent vulnerability challenges current safety assumptions