Radical Numerics发布开源30B参数扩散AI模型

Radical Numerics发布开源扩散AI重大突破

AI研究公司Radical Numerics公开推出了迄今为止最大的开源扩散语言模型RND1-Base。这个300亿参数的架构标志着并行文本生成技术的重大进步。

技术规格

该模型具有以下特点:

- 总计300亿参数(通过稀疏专家混合激活30亿)

- 基于Qwen3-30BA3B自回归基础构建

- 使用双向掩码训练了5000亿token

- 支持800万token批量大小以确保稳定性

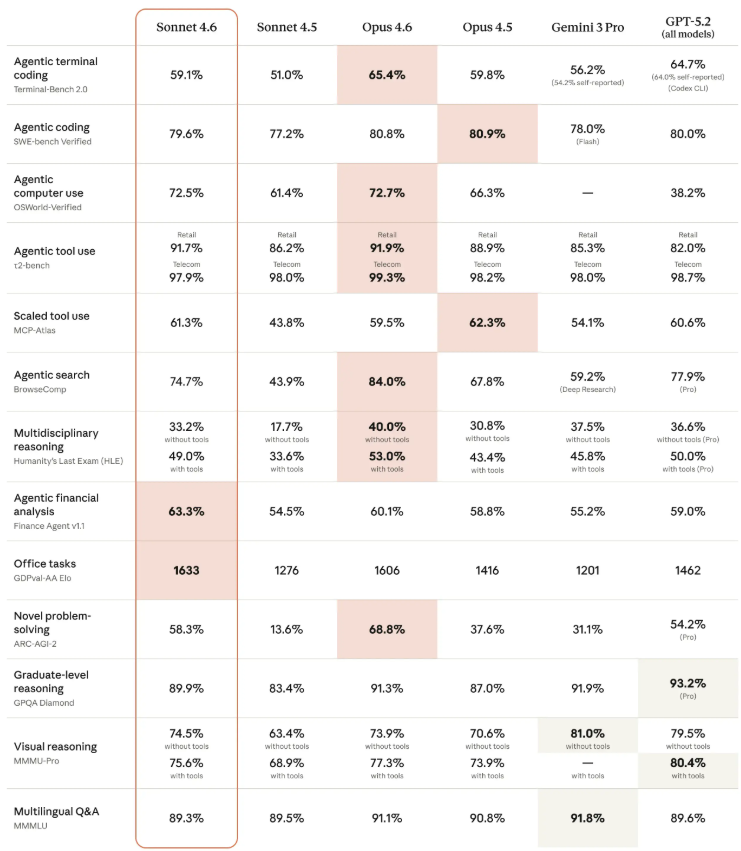

性能基准测试

RND1-Base在多个领域展现出卓越能力:

| 基准测试 | 得分 |

|---|

该模型在保持计算效率的同时,通过选择性参数激活超越了Dream-7B和LLaDA-8B等先前开源扩散模型。

架构创新

与传统自回归模型不同,RND1将文本生成视为去噪过程,从而实现了:

- 并行序列优化

- 双向注意力机制

- 降低推理延迟

通过采用分层特定学习率的持续预训练,在保留现有知识的同时获得新能力,完成了从自回归到扩散范式的转变。

研究意义

此次开源内容包括:

- 完整模型权重

- 训练方法论

- 搭载FlashInfer/SGLang后端的推理代码

这种透明度旨在加速社区对扩散语言模型的训练后优化及实际应用的研究。

未来方向

尽管表现出强大性能,但在以下方面仍存在挑战:

- 泛化能力

- 内存优化 Radical Numerics建议未来结合多目标微调可能释放更大潜力。

这支由DeepMind、Meta和斯坦福大学研究人员组成的团队将此视为通向递归自我改进AI系统的基础工作。

关键要点:

- 发布最大开源扩散语言模型(300亿参数)

- 在实现并行生成的同时达到最先进基准测试成绩

- 向研究社区提供完整技术栈

- 代表了向非自回归AI架构的转变

- 为未来自我改进AI系统奠定基础