NVIDIA Lyra 2.0:将单张图片转化为广阔3D世界

NVIDIA在3D世界生成领域的飞跃

想象将单张照片输入系统后获得整个可探索的3D宇宙——这正是NVIDIA全新Lyra 2.0框架实现的功能,标志着AI空间计算技术的重大进步。该技术通过Hugging Face平台发布,解决了数字世界构建中长期存在的两大难题:生成内容中的空间记忆缺失和时间扭曲问题。

解决虚拟世界中的记忆问题

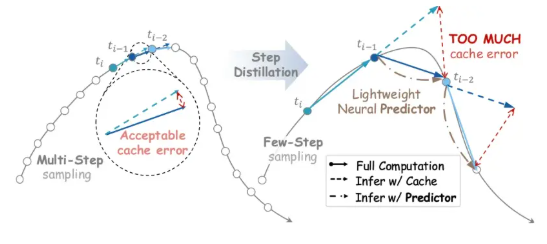

传统AI模型往往会"遗忘"已生成区域的细节——研究者称之为"空间遗忘"现象。同时存在"时间漂移"问题,即物体位置或外观会随时间逐渐变化。这些缺陷使得创建连贯的大规模环境极具挑战性。

Lyra 2.0通过两项创新方法应对这些问题:

- 空间记忆机制:系统不存储每个细节,而是保留足够的3D几何信息来建立帧间关联,同时依赖生成式AI处理实际视觉输出。这有效防止了传统方法中随时间累积的质量退化问题。

- 自我纠正训练:模型在训练过程中学习识别并修正自身错误,避免误差进一步传播。

从静态图像到虚拟游乐场

操作流程异常简洁:

- 从任意图像开始(可选添加文字提示)

- 通过交互式浏览器规划相机路径

- 观看Lyra沿路径生成的视频序列

- 系统将其转换为3D模型(点云、高斯泼溅或网格)

- 直接导出至Unity或Unreal Engine等平台

早期测试显示,Lyra在场景规模和一致性上超越现有方法,能创建横跨数十米且区域复访时仍保持稳定的环境。潜在应用令人惊叹——从虚拟仿真训练机器人到快速原型化游戏世界。

开放获取推动创新

NVIDIA已将Lyra 2.0以Apache 2.0许可协议免费发布在Hugging Face(nvidia/Lyra-2.0)和GitHub(nv-tlabs/lyra)平台。该系统融合了Wan-14B等强大扩散模型与Depth Anything V3等重建工具,确保专业级输出质量。

主要应用场景包括:

- 为具身AI和机器人创建逼真训练环境

- 加速游戏开发和沉浸式内容创作

- 优化从概念到成品的3D资产生产流程

虚拟空间的未来图景

此次发布不仅是技术突破,更展示了开放生态如何推动全行业进步。随着Lyra等工具的普及,我们或将见证从自动驾驶测试到元宇宙开发等各领域的应用爆发。

对于亟欲尝试的开发者,项目页面、研究论文和模型权重均已公开。由AI生成、易于获取的3D世界时代或许才刚刚拉开帷幕。

核心要点:

- Lyra 2.0可从单张图像生成持久稳定的3D环境

- 解决AI生成中的"空间遗忘"与"时间漂移"难题

- 创建适合导航的大规模环境(数十米范围)

- 开源框架已在Hugging Face和GitHub发布

- 在游戏、机器人和虚拟世界开发中具有广阔应用前景