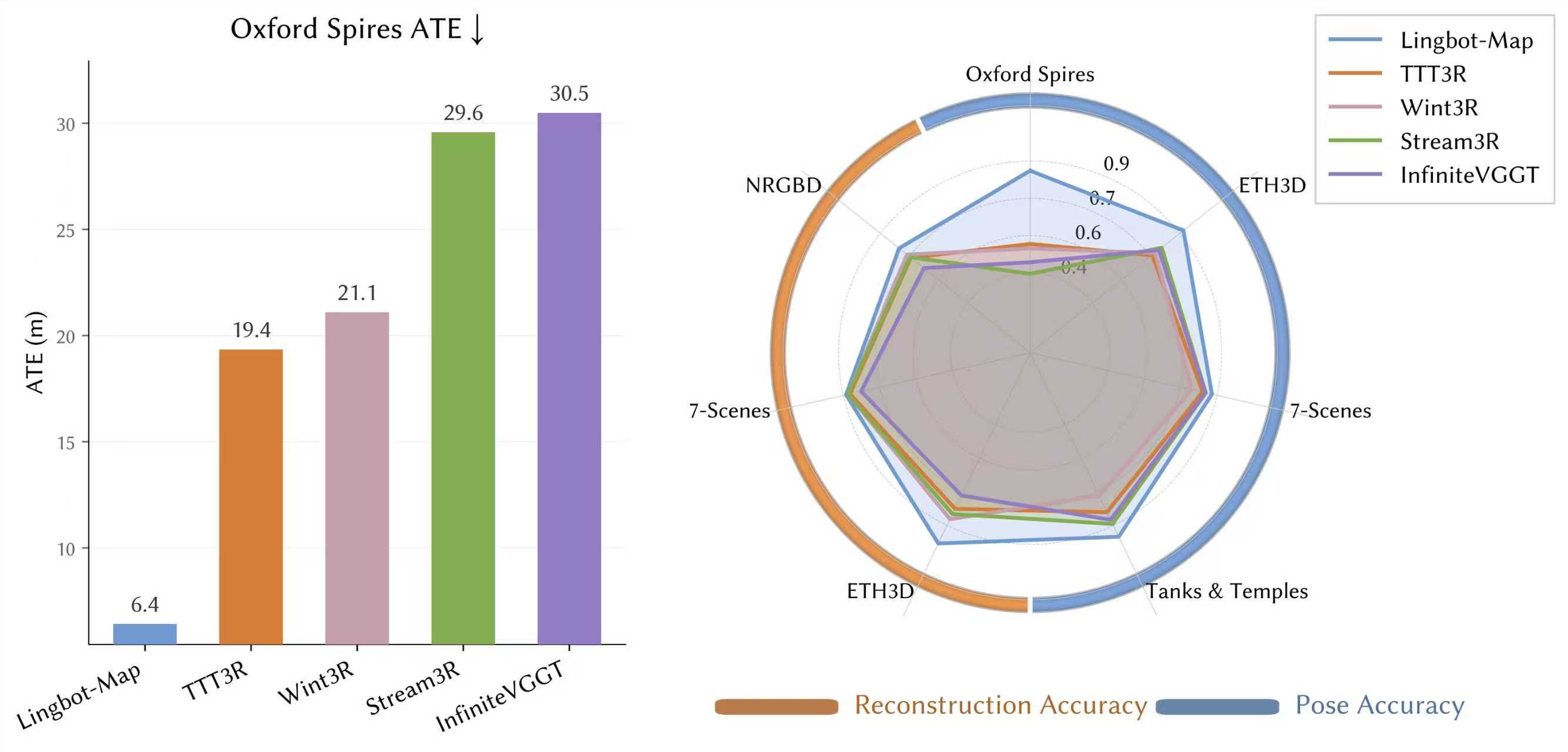

谷歌AI重大突破:让机器像人类一样观察世界

AI视觉的盲区

让AI系统描述照片内容时,它能给出详细回答。但若提出更精确的问题——"熊猫的左后腿具体在哪里?"——得到的答案就会变得模糊。这种局限并非个别模型的缺陷,而是整个视觉AI领域面临的根本性挑战。

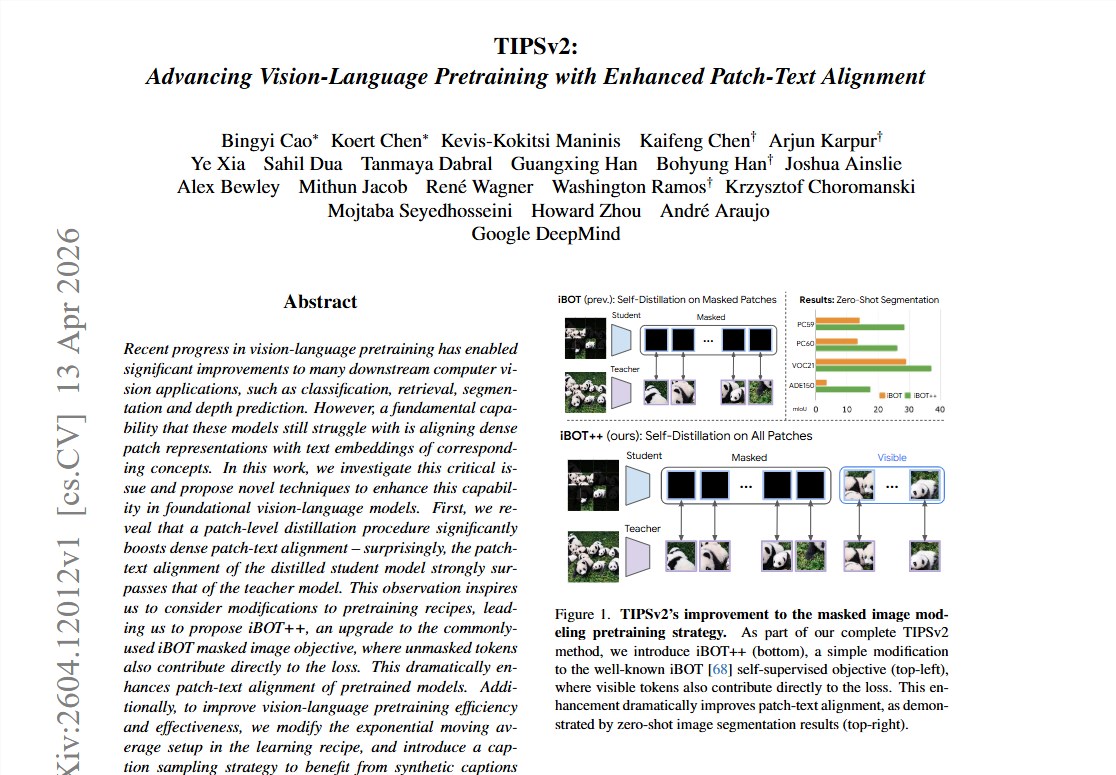

反直觉的发现

Google DeepMind研究人员观察到:在精细分割任务中,较小的"学生"模型常能超越较大的"教师"模型。其奥秘在于蒸馏过程移除了掩蔽机制,迫使模型检查每个细节——研究团队称之为"全区域监督"。

三项关键创新

1. iBOT++:从拼图碎片到完整画面

传统训练仅计算被遮蔽区域的损失,导致可见区域被忽视。iBOT++要求对所有可见区域实施精确监督——将训练过程从拼图游戏转变为精读练习。仅此一项改进就将零样本分割性能提升了14.1个百分点。

2. 仅头部EMA:以少胜多

先前方法需要同时维护两个几乎相同的大型模型,消耗巨大资源。TIPSv2的突破在于:仅通过图像-文本对比损失就能稳定主干网络,因此只需复制最后的投影头部。最终实现:训练参数量减少42%,性能损失可忽略不计。

3. 多粒度文本配对:保持AI警觉性

通过在训练中随机混合简短的网络描述、中等长度的详细说明以及Gemini生成的长篇描述,系统在简单与困难任务间交替切换。这种方法既防止模型懈怠,又能确保细节不被遗漏。

实际影响

TIPSv2的表现不言自明。在涵盖9项任务和20个数据集的评估中,它为零样本语义分割树立了新标杆,同时在图像-文本检索和分类任务上超越了参数量多56%的对比模型。

凭借完全开源的代码和模型权重,TIPSv2将直接惠及医学影像、自动驾驶和工业检测等依赖精确视觉理解的领域。

核心要点:

- 解决AI"全局理解与局部精度"的两难困境

- 通过全区域监督实现14.1%的分割精度提升

- 优化架构使训练参数量减少42%

- 多项基准测试超越更大规模模型

- 开源特性加速实际应用落地