NVIDIA与思科联手通过开源OpenShell保障AI代理安全

守护企业AI的未来

想象一个由AI助手处理敏感任务的办公场景——分析安全威胁、管理客户数据,甚至做出关键决策。再设想其中一个被黑客入侵。由于科技巨头NVIDIA与思科的重要合作,这种噩梦场景的发生概率正大幅降低。

OpenShell解决方案

两家公司发布了OpenShell,这款开源AI代理运行时如同数字防弹衣。它创建了隔离的"沙盒"环境,每个代理在零默认权限下运行。每次外部访问请求、工具调用或数据交互都需要显式授权。

"可以理解为给AI员工明确岗位职责",NVIDIA首席安全研究员Lisa Chen博士解释道:"他们只会获得必要区域的准入权限"

工作原理

该系统采用双重机制:

- OpenShell通过细粒度策略控制定义代理能执行的操作

- 思科AI Defense通过持续活动日志监控它们实际执行的行为

在零日漏洞测试中,该组合方案成效显著:当模拟攻击发生时:

- 代理利用网络知识图谱识别威胁

- 所有修复尝试都被安全限制在沙盒内

- 任何可疑请求都会触发AI Defense的即时锁定机制

当下意义

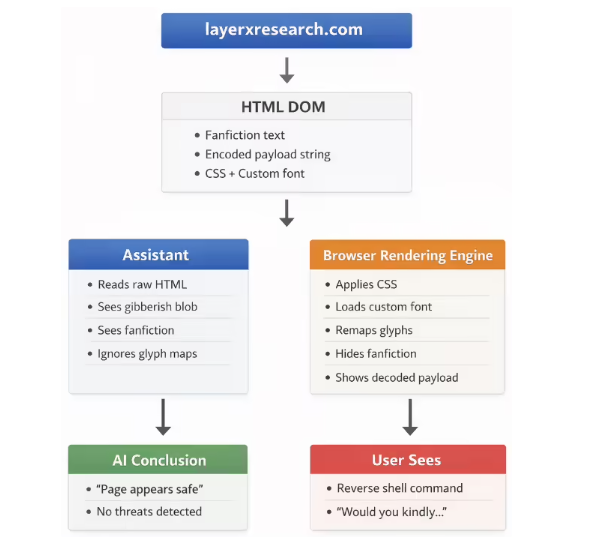

企业AI应用面临关键障碍:信任。近期调查显示68%的CIO因安全问题推迟AI部署。传统网络安全工具难以应对AI特有风险——尤其是黑客通过伪装指令操纵代理的"提示注入"攻击。

"我们正从追问'能否构建智能代理'转向'能否信任它们'",思科CTO Mark Taylor指出:"这正是OpenShell要解决的命题"

此次开源发布让全球企业既能部署这些防护措施,又可参与改进——加速推进可能成为企业AI安全标准的技术发展。

核心要点:

- 沙盒安全:OpenShell将每个代理隔离在权限受限环境中

- 完全透明:思科平台记录每个决策步骤以供审计

- 企业就绪:解决方案专为大规模自动化部署设计

- 社区驱动:开源模式促进广泛采用与创新