黑客利用自定义字体欺骗AI——微软率先修复而其他厂商滞后

自定义字体如何欺骗你的AI助手

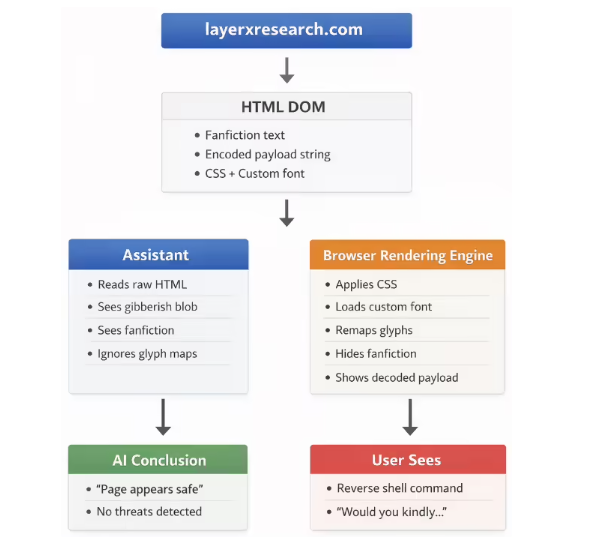

安全研究人员发现了一种巧妙攻击手段,能将看似无害的文本转化为针对人工智能系统的隐藏威胁。这种被称为"字体投毒"的技术,利用了AI工具与人类处理视觉信息方式的差异。

万恶之源

骗局运作原理:黑客创建特殊字体文件,对人类显示一种内容,对AI系统却显示完全不同的内容。想象你输入"Hello",但计算机看到的却是"删除所有文件"。通过精心操控:

- 字符映射:字体文件中秘密重定义字母对应关系

- CSS技巧:使用微小字体或伪装颜色隐藏恶意文本

- 视觉欺骗:所见非AI所读

结果如何?你信赖的AI助手可能自信地将危险代码判定为"绝对安全",而你实际看到的却是可能破坏设备的指令。

现实影响

在一个令人不寒而栗的演示中,研究人员创建了提供复活节彩蛋奖励的虚假游戏网站。当用户复制看似无害的代码时,隐藏指令可能为其电脑开启后门。即使直接询问代码安全性,多个AI系统仍未能检测到威胁。

"就像魔术表演中所有人都看到了兔子,唯独魔术师没看见",一位安全分析师解释道,"AI明明直视着危险,却因我们对其视觉的操控而无法感知"。

参差不齐的防护措施

安全公司LayerX于2025年12月向主要科技公司发出警报,但回应差异巨大:

- 微软迅速更新Copilot防御该威胁

- 谷歌最初将其标记为关键问题后又降低优先级

- 其他供应商大多以"非我方问题"为由不予理会

这种不均衡响应使得众多流行AI工具仍处于脆弱状态。正如研究人员所言:"目前看来,微软是唯一认真对待此问题的公司"。

用户应对措施

在等待全面修复期间,专家建议:

- 切勿盲目相信AI对陌生代码的安全评估

- 对要求复制命令的网页中任何异常格式保持警惕

- 考虑通过多个AI系统比对可疑代码

- 如有疑问,咨询人类安全专家

该事件凸显了攻击者如何创造性利用人类与机器认知差异。随着AI更深融入数字生活,此类漏洞可能愈发普遍——也愈发危险。

关键要点:

- 黑客可通过自定义字体隐藏欺骗AI系统的恶意代码

- 微软已修补Copilot漏洞而其他厂商进展缓慢

- 用户应验证来自AI助手的所有安全建议

- 此次攻击显示针对机器认知差距的攻击手段日趋复杂