MiniMax开源M2.5模型——经济型AI代理的游戏规则改变者

MiniMax以开源M2.5模型开辟新天地

随着MiniMax最新版本的发布,AI领域变得更加有趣。他们的M2.5模型不仅仅是一次渐进式更新——它代表了经济型AI所能实现质的飞跃。

令人瞩目的性能表现

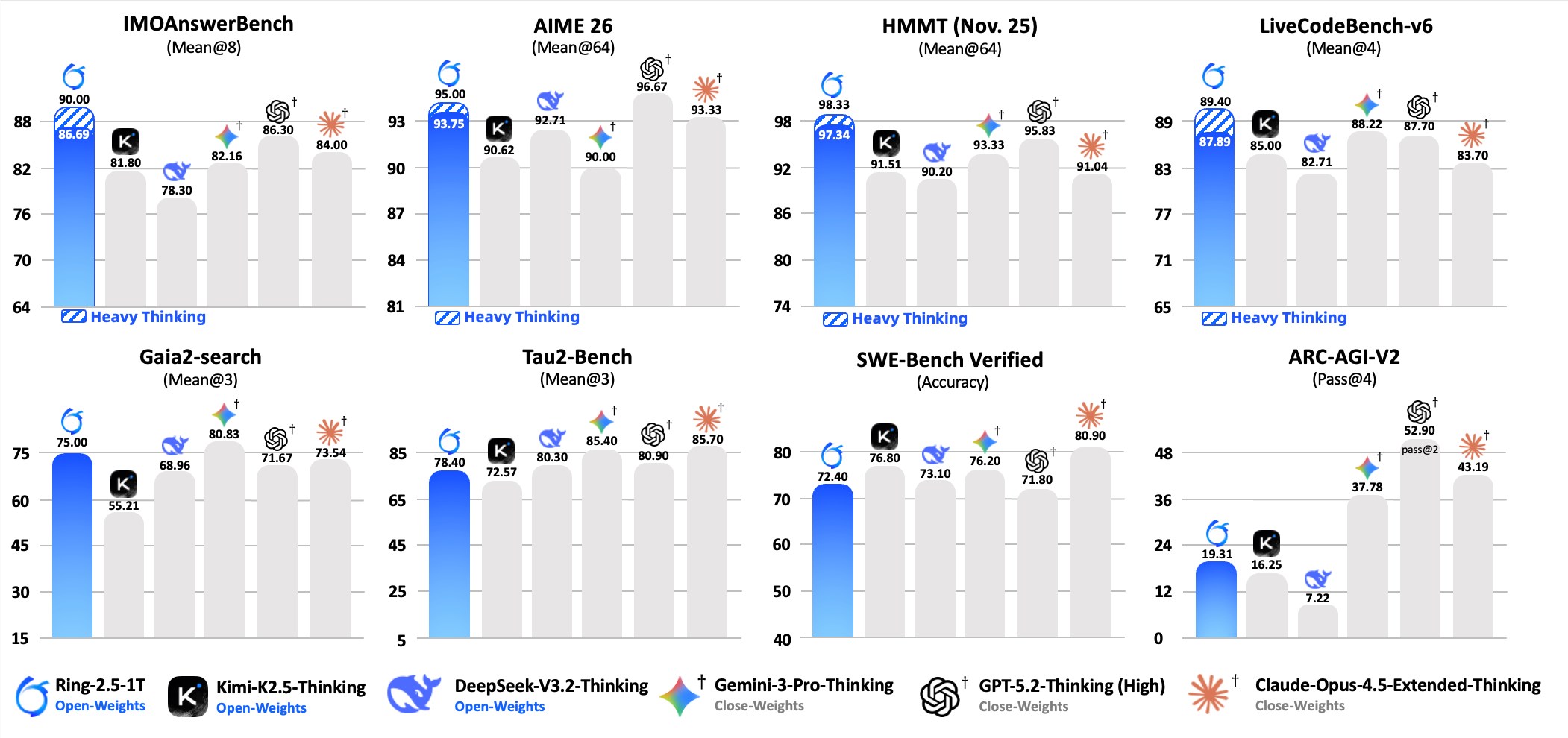

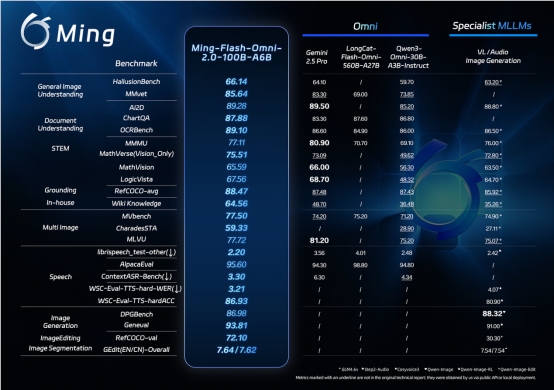

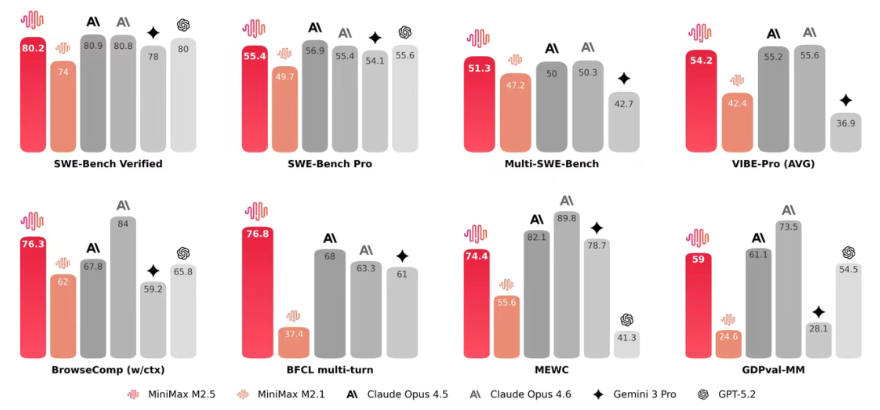

基准测试结果讲述了一个令人印象深刻的故事。M2.5在SWE-Bench Verified上获得80.2%的分数,略胜GPT-5.2,接近Claude Opus4.5的表现。但关键在于——它的成本仅为同类模型的十分之一。

"我们看到了架构级规划能力的涌现," MiniMax首席研究员李伟博士解释道,"该模型能够处理从初始概念到跨多平台最终部署的全过程。"

实际表现包括:

- 减少20%的搜索迭代次数

- 擅长专家级研究任务

- 集成金融和法律应用的专业知识

- 请求处理速度比前代快37%

技术揭秘:实现飞跃的关键是什么?

其成功秘诀在于三大创新:

- Forge框架:训练速度惊人提升40倍

- CISPO算法:解决大规模训练中的棘手上下文分配问题

- 智能奖励设计:平衡性能与响应速度

结果如何?在MiniMax内部,M2.5现已处理30%的日常任务和80%的新代码提交。

终于实现简单部署

MiniMax明白AI实施不能一刀切:

- 无代码用户:可直接使用网页界面(包含数千个预构建"专家")

- 开发者:可选择ModelScope上的免费API或高级选项

- 企业需求:本地部署支持从高容量生产到基于Mac开发的所有场景

定价结构值得一提——选择成本仅为同类解决方案的5%-10%,实质上消除了财务门槛。

专业工具获得专业对待

M2.5在与外部工具协作时表现出色:

- 原生支持并行工具调用

- 无缝OpenAI SDK集成(使用vLLM/SGLang时)

- 提供优化工具交互的全面指南

团队甚至提供了开箱即用的推荐参数配置,同时也鼓励根据具体用例进行实验调整。

关键要点:

- 成本革命:以传统成本的一小部分实现高性能

- 灵活接入:从无代码到完整本地部署

- 编程实力:支持10+语言并具备架构师级思维

- 搜索优势:更少迭代即可获得专家级结果

- 持续进化:快速迭代周期预示更多改进即将到来