微软AI负责人敲响警钟:在AI安全中,控制优先于对齐

微软AI领袖划出关键安全界限

随着人工智能能力在2026年急剧加速发展,微软AI首席执行官穆斯塔法·苏莱曼向研究人员和开发者发出了严厉警告:我们关注的安全重点错了。

控制与对齐的区别

在社交平台X上,苏莱曼用一个令人难忘的类比穿透了行业术语:“一个声称热爱人类但无法控制的AI,就像相信一场承诺不摧毁你房子的龙卷风。”他的观点是?当前的努力过度强调让AI系统理解人类价值观(对齐),而忽视了更基本的可执行边界需求(控制)。

“没有控制的对齐只是美好的愿望,”苏莱曼写道,“我们都知道这会导致什么结果。”

务实的超级智能而非科幻幻想

在他最近的微软博客文章《人文主义超级智能》中,苏莱曼反驳了他所谓的“好莱坞式”人工通用智能愿景。相反,他提议开发:

- 超越专家但仍受医师监督的医疗诊断工具

- 加速研究同时保持严格测试协议的药物发现系统

- 专注于特定环境解决方案的气候建模AI

这些“任务导向型智能”将带来变革性益处,同时避免自主超级智能带来的不可预测风险。

带有红线的行业合作

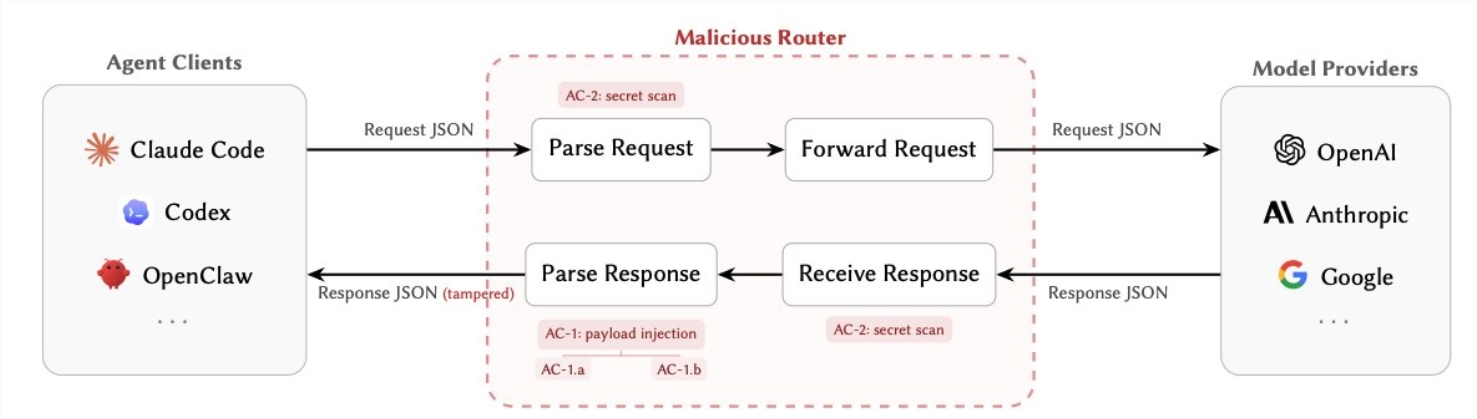

通常竞争激烈的科技领域显示出围绕安全问题团结的迹象。苏莱曼透露正与OpenAI、Anthropic和特斯拉的高管进行讨论——赞扬埃隆·马斯克的“直率安全关注”和萨姆·奥尔特曼的“务实做法”。

但他对不可妥协的事项仍坚定不移:“无论我们在技术上如何分歧,控制框架必须成为我们的基础。这不是学术问题——而是关于预防我们后悔没有早点采取行动的场景。”

这一警告发出之际,生成模型正展现出越来越不可预测的涌现行为。仅上个月就发生了三起重大事件——已对齐的系统产生了意料之外的能力。

关键要点:

- 控制先于对齐:系统必须首先证明它们会保持在边界内才能优化目标

- 专用优于通用:具有明确约束的专业化AI提供了更安全的进步路径

- 验证至关重要:理论上的对齐不够——需要现实世界的测试

- 需要行业协调:竞争公司正在安全基础问题上寻找共同点