LibuLibu AI通过系统升级解决内容安全问题

LibuLibu AI针对内容生成缺陷采取行动

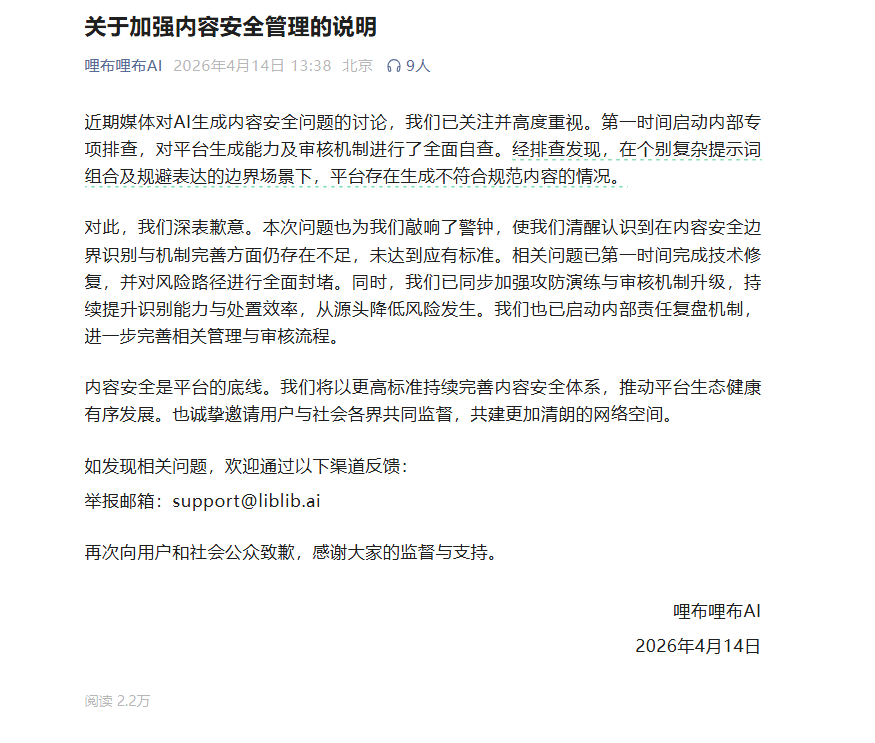

面对AI生成内容安全性日益严格的审查,LibuLibu AI同时给出了道歉与具体解决方案。该公司承认,当用户使用复杂的提示词组合或绕过现有内容过滤器时,其平台偶尔会产生不合格的输出内容。

修复措施:不止于补丁

这家AI企业并未止步于技术修补。工程师们彻底检修了系统的脆弱点,同时实施了更强的防滥用保护措施。"我们已竭尽所能消除已知风险",声明中如此表示,但公司对未来的挑战仍保持谨慎态度。

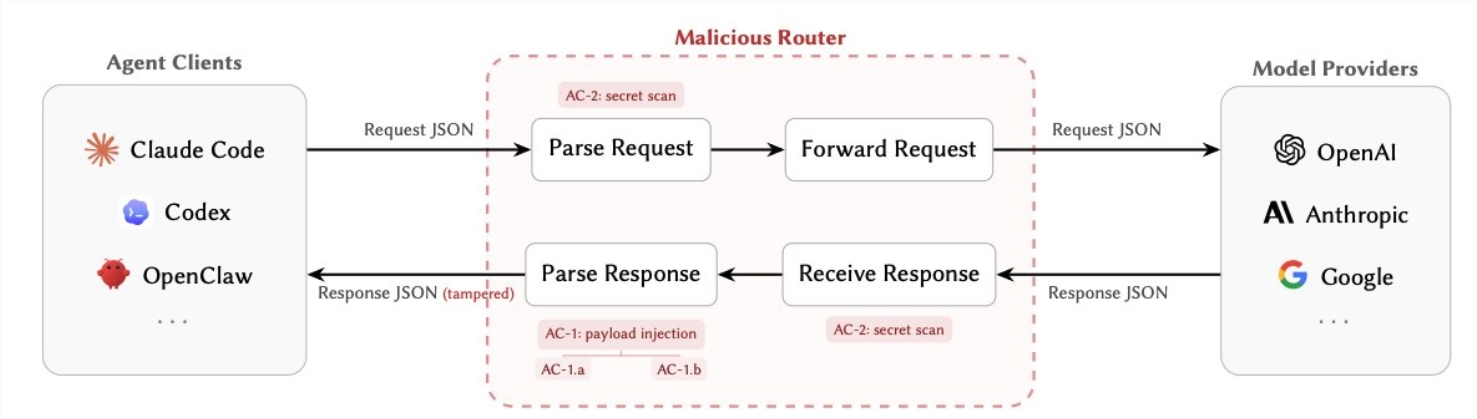

新的多层防护体系包括:

- 强化的渗透测试 以更快捕获问题内容

- 管理流程审查 从根源解决内容安全问题

- 新的问责机制 针对内部团队

当前形势的重要性

本次事件凸显了AI平台面临的平衡难题。正如LibuLibu技术负责人所解释:"用户提示词越有创意,在不妨碍创新的前提下实施质量控制就越困难"。该公司现鼓励用户直接向support@liblib.ai举报问题,寄望于群体监督的力量。

行业观察者认为这是大趋势的一部分。"我们正进入一个新时代,AI公司不能只关注系统能做什么",科技分析师Miranda Cho指出,"人们会同等关注它们阻止系统做什么的能力"。

展望未来

LibuLibu在声明中将此次事件定位为转折点,承诺为生态系统健康建立"更高标准"。但随着AI生成内容变得无处不在,真正的考验在于这些措施能否同时满足监管机构和持怀疑态度的公众。

关键要点:

- LibuLibu AI承认部分生成内容未通过质量检测

- 实施全面技术检修及新的防护机制

- 升级审核流程以加速违规内容识别

- 公司开通专门举报渠道欢迎公众监督

- 事件折射出AI行业日益增长的合规压力