美团开源多模态AI模型登顶基准测试榜首

美团开源多模态AI模型创下新标杆

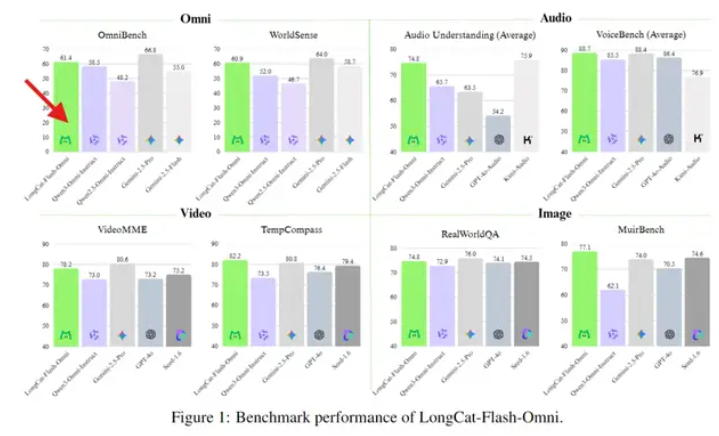

在AI行业的重要举措中,美团将其LongCat-Flash-Omni多模态大模型作为开源项目发布。该模型已在基准测试中超越多个闭源竞争对手,实现了罕见的"开源即SOTA"(State-of-the-Art)突破。

技术突破

LongCat-Flash-Omni模型的突出之处在于其精准处理复杂跨模态任务的能力。例如,当面对结合物理逻辑与空间推理的问题——如描述六边形空间中球的运动轨迹时——该模型能准确建模场景并用自然语言解释动力学原理。

此外,该模型在语音识别方面表现卓越,即使在高噪声环境中也能清晰辨音,并能从模糊图像或短视频片段中提取关键信息生成结构化答案。

创新架构

模型的成功源于其端到端统一架构。与传统多模态模型分别处理各模态不同,LongCat将文本、音频和视觉数据整合到单一表征空间中。这种设计实现了跨模态的无缝对齐与推理。

训练过程中,美团团队采用了渐进式多模态注入策略:先巩固语言基础,再逐步引入图像、语音和视频数据。该方法确保模型在保持强大语言能力的同时提升跨模态泛化性能。

实时性能

LongCat-Flash-Omni最令人印象深刻的特性是其近乎零延迟的交互。得益于Flash推理引擎和轻量化设计,该模型在消费级GPU上即可实现流畅对话。用户通过美团APP或网页版与模型交互时几乎感受不到延迟,达成自然的"所问即所得"体验。

可用性与影响

该模型现已在美团平台免费开放。开发者可通过Hugging Face获取权重参数,普通用户则可直接在应用内测试体验。此举既彰显了美团对其AI基础设施的信心,也表明其推动中国多模态AI生态发展的决心。

随着AI竞争焦点从单模态精度转向多模态协同,LongCat-Flash-Omni既是技术里程碑也是应用场景的重新定义者。它的出现预示着中国AI发展正进入创新新阶段。

核心要点:

- 开源即SOTA: LongCat-Flash-Omni在基准测试中超越闭源模型

- 统一架构: 将文本、音频和视觉数据整合到单一表征空间

- 实时交互: 在消费级硬件上实现近乎零延迟响应

- 渐进训练: 语言基础与渐进式多模态注入相结合

- 生态助推: 向开发者和用户免费开放促进广泛采用