IBM发布Granite4.0Nano系列边缘AI模型

IBM推出面向边缘计算的紧凑型AI模型

IBM人工智能团队正式发布Granite4.0Nano系列,这是一组专为本地和边缘推理应用设计的小规模人工智能模型。此次发布标志着在资源受限环境中实现强大AI能力的重要进展,同时保持企业级管控和开源可用性。

模型架构与特性

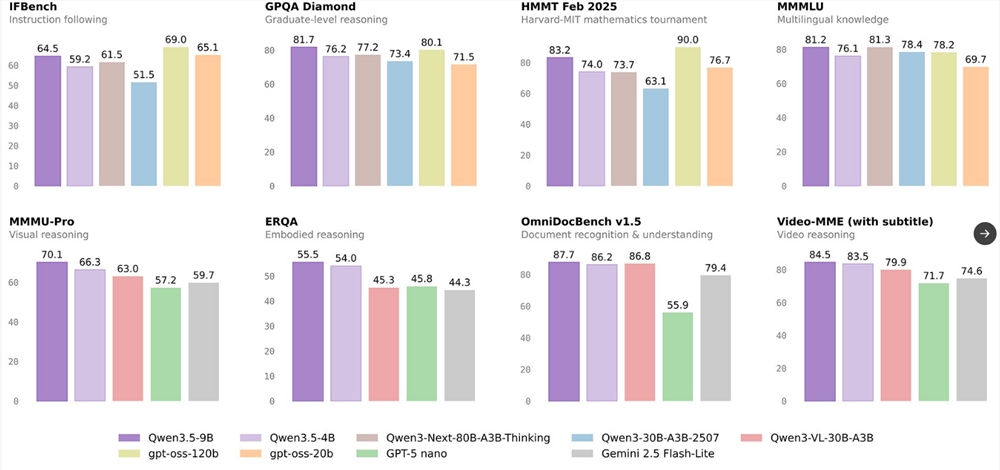

该系列包含八种不同模型,主要提供3.5亿和约10亿参数两种规模。这些模型采用创新的混合架构,将状态空间模型(SSM)与传统Transformer层相结合,在效率与性能间取得平衡。

重要变体包括:

- Granite4.0H1B:约15亿参数的混合SSM架构

- Granite4.0H350M:3.5亿参数的混合方案

- 纯Transformer版本(确保最大兼容性)

这种混合设计在SSM与Transformer层之间交替排列,相比纯Transformer模型显著提升内存效率,同时保留Transformer模块的通用性。

训练与性能表现

IBM对这些紧凑型模型采用与其大型Granite4.0模型相同的严格训练标准。所有模型的训练数据集规模超过15万亿token,并经过专项指令微调以增强:

- 工具使用能力

- 指令遵循准确性

- 通用任务表现

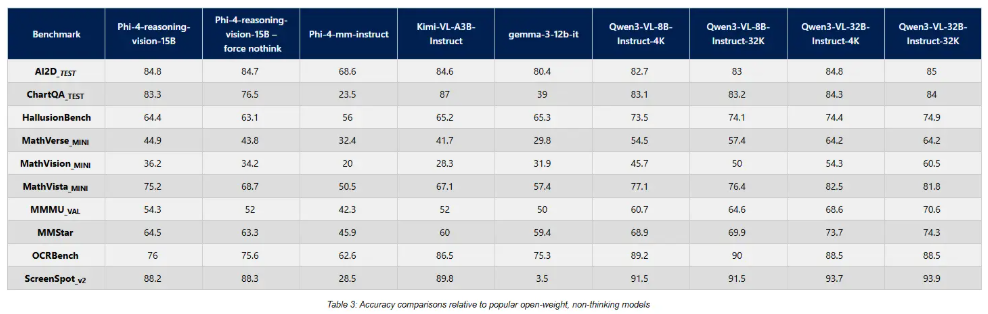

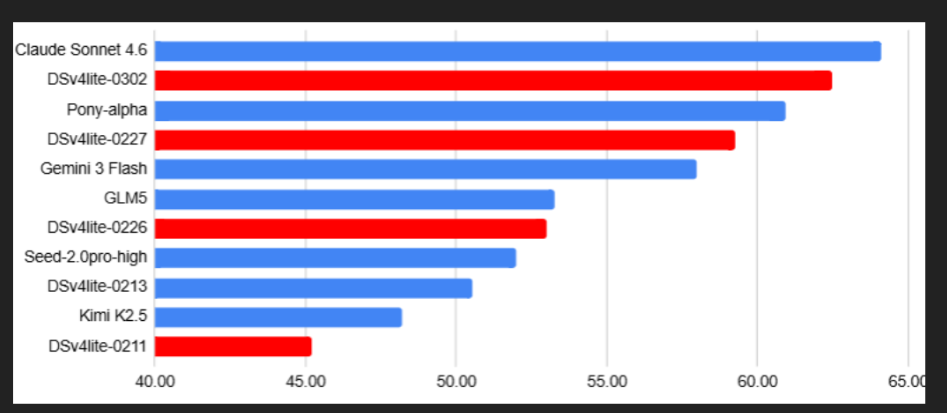

与Qwen、Gemma及LiquidAI LFM等竞品的对比测试显示,Granite4.0Nano在以下方面具有优势:

- 常识任务

- 数学运算

- 编程应用

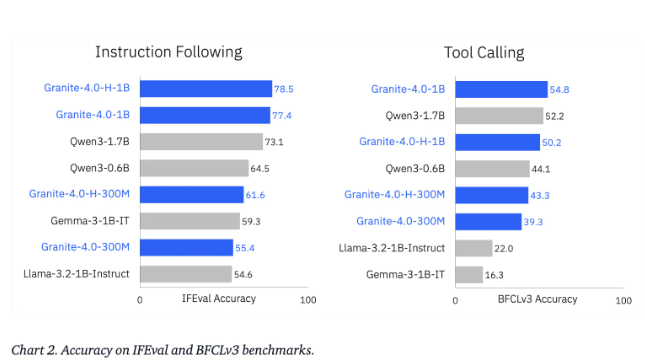

- 安全相关功能 该系列在智能体任务中表现尤为突出,在IFEval和Berkeley函数调用排行榜v3上成绩亮眼。

企业级部署方案

所有Granite4.0Nano模型均具备:

- Apache2.0开源许可

- ISO42001质量认证

- 可追溯的加密签名

支持部署环境包括:

- 边缘设备

- 本地服务器

- 浏览器应用 通过主流运行时平台实现部署:

- vLLM

- llama.cpp

- MLX

开发者可通过Hugging Face和IBM的**watsonx.ai平台获取这些模型,轻松集成至现有工作流。

核心要点:

🔹 IBM Granite4.0Nano系列提供八款边缘计算专用AI模型(3.5亿至10亿参数) 🔹 SSM-Transformer混合架构实现内存高效与性能兼备 🔹 基于>15万亿token训练数据并经过指令微调 🔹 企业级Ready:通过ISO认证并配备加密签名 🔹 Apache2.0许可授权,支持多平台运行时环境