阿里巴巴新AI语音模型让好莱坞品质配音触手可及

阿里巴巴在AI语音技术领域取得重大突破

想象观看一部外语电影时,配音不仅完美契合演员口型,还能准确传递情感——再也不会因声画不同步而出戏。随着阿里巴巴通义实验室发布开源语音合成模型Fun-CineForge,这个未来已近在眼前。该模型实现了许多人认为不可能的任务:通过人工智能达成真正的电影级配音品质。

攻克好莱坞长期难题

这一突破源于同时解决三大行业痛点:

- 唇形同步精度 在复杂拍摄条件下依然稳定

- 情感真实度 弥补多数合成语音的缺失

- 角色一致性 处理多人对话场景时保持统一

"传统模型往往只关注文本或视觉单一方面",项目首席研究员李文博士解释道,"我们引入了'时间模态'——本质上是教会AI理解每个音节相对于视觉线索的精确发生时机"。

这种时间感知能力使Fun-CineForge即使面对演员背对镜头或快速剪辑场景时,仍能保持同步效果。早期测试显示,其对遮挡面部和动态模糊的处理精度令人惊喜。

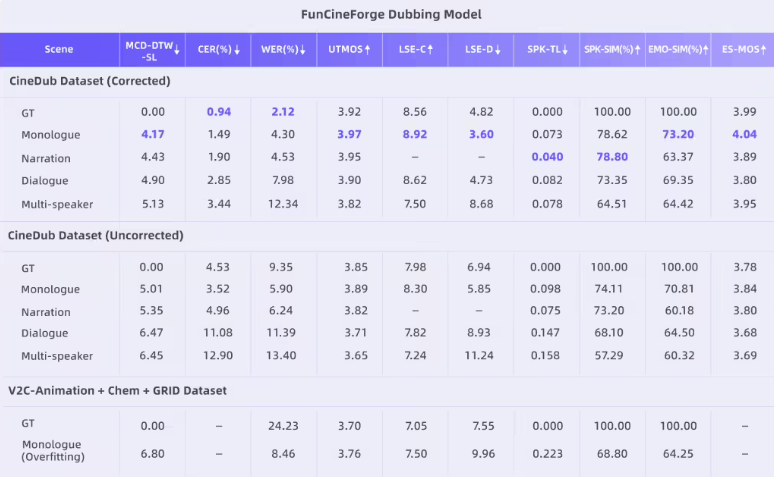

幕后功臣:CineDub技术优势

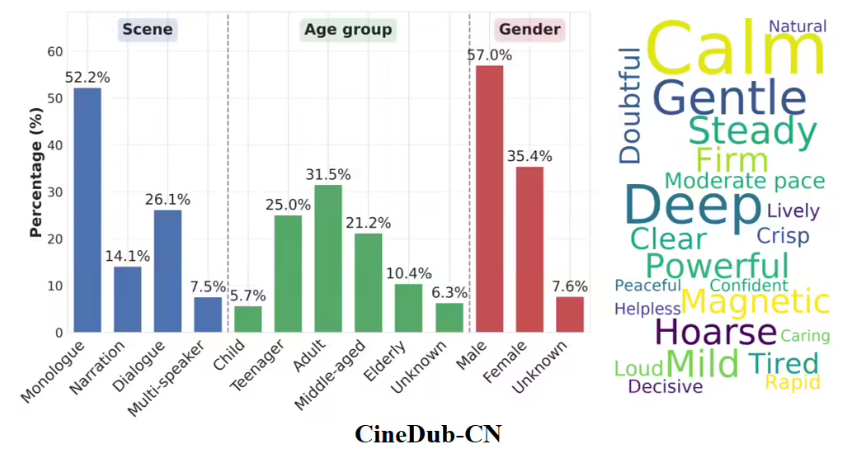

研发团队并未止步于模型本身。他们通过CineDub数据集构建方法革新了训练数据制备流程:利用大语言模型自动化转录与标注,成功将:

- 单词错误率降至约1%(行业标准通常在5-7%)

- 说话人分离错误率压低至1.20%

"过去需要数周人工完成的工作现在全自动处理",项目经理陈颖指出,"我们实际上是以开源价格向影视制作者提供专业级工具"。

立即体验平台一览

该模型已于3月16日在三大平台首发:

当前功能支持处理30秒视频片段,涵盖独白、对唱及多角色对话场景——这在此类级别的开源模型中尚属首创。

对创作者的意义远超技术成就本身:

- 独立制片人现在能获得媲美大型工作室的配音质量

- 动画工作室后期制作周期可缩短数周

- 全球范围内的语言本地化变得前所未有的便捷

- 教育内容创作者获得专业旁白工具

- 游戏开发者能以更低成本实现动态语音演出

虽然该技术仍有局限——长片段需拼接多个剪辑——但已然向全民化电影级音频制作迈出了巨大飞跃。