AI 模型盗窃:电磁信号捕获的风险

AI 模型盗窃:电磁信号捕获的风险

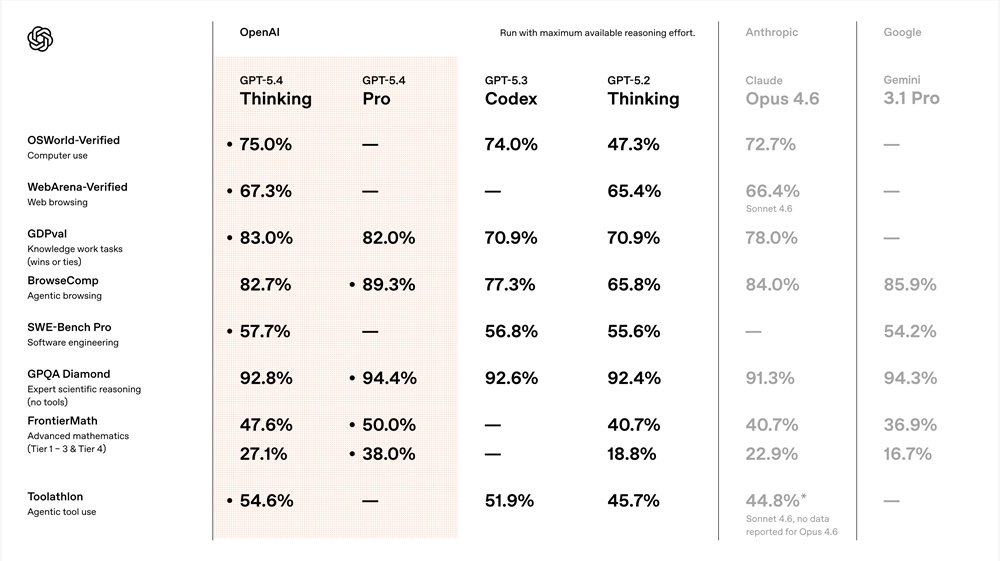

最近,北卡罗来纳州立大学的研究人员揭示了一种开创性的方法,通过捕获计算机发出的电磁信号来提取人工智能(AI)模型。该技术已显示出超过 99% 的令人印象深刻的准确率,引发了关于大型公司如 OpenAI、Anthropic 和 Google 开发的专有 AI 模型安全的重大担忧。这一发现的影响可能会深刻影响商业 AI 领域,特别是考虑到这些公司在其 AI 技术上的重大投资。

![]()

CUDO Compute 的首席营销官 Lars Nyman 强调,AI 模型的盗窃不仅仅是失去模型本身。它可能引发一系列连锁反应,包括竞争对手利用多年的研究和开发(R&D)成果,导致对知识产权管理不善的监管调查,以及客户发现其 AI 所声称的独特性并不如所声称的那样独特,而可能提起诉讼。Nyman 表示,这种情况可能促使业界呼吁进行 标准化审计,类似于 SOC2 或 ISO 认证,以帮助区分对知识产权保护不力的企业和负责任的企业。

近年来,对 AI 模型的黑客攻击威胁正在上升,主要是由于各个行业对 AI 技术的越来越大依赖。报告显示,恶意文件已被上传到 Hugging Face,这一知名的 AI 工具仓库显著危及了在零售、物流和金融等关键行业中使用的模型。国家安全专家警告说,安全措施不到位可能会将专有系统暴露于盗窃风险中,正如 OpenAI 的安全协议中识别出的漏洞所示。被盗的 AI 模型可能会被反向工程或出售,从而削弱公司投资并降低行业内的信任,使竞争对手快速缩小差距。

北卡罗来纳州立大学的研究团队发布了发现,揭示他们能够通过在 Google 的边缘张量处理单元(TPU)附近战略性放置探针并分析发射的信号来提取有关 AI 模型结构的关键信息。这种攻击方法不需要直接访问系统,从而对 AI 知识产权构成显著安全风险。该研究的合著者之一、电子与计算机工程副教授 Aydin Aysu 强调,构建 AI 模型所需的高昂成本和巨大的计算资源,突显了防止模型盗窃的紧迫需求。

随着 AI 技术的日益普及,企业必须重新评估用于 AI 处理的设备。技术顾问 Suriel Arellano 表示,企业可能会转向更集中和安全的计算解决方案,或探索更难以攻破的替代技术。尽管与盗窃相关的潜在风险存在,AI 技术在通过自动化威胁检测和数据分析、改善响应效率以及帮助组织更有效地识别潜在漏洞方面,也在增强网络安全中发挥着关键作用。

要点:

- 研究人员展示了一种通过捕获电磁信号提取 AI 模型的方法,准确率超过 99%。

- AI 模型的盗窃可能使竞争对手利用多年的 R&D 成果,从而影响企业安全。

- 公司需要加强 AI 模型的安全性,以应对日益严重的黑客攻击威胁。