Unsloth Studio将AI微调技术带入个人电脑

民主化AI开发:Unsloth Studio为开发者赋能

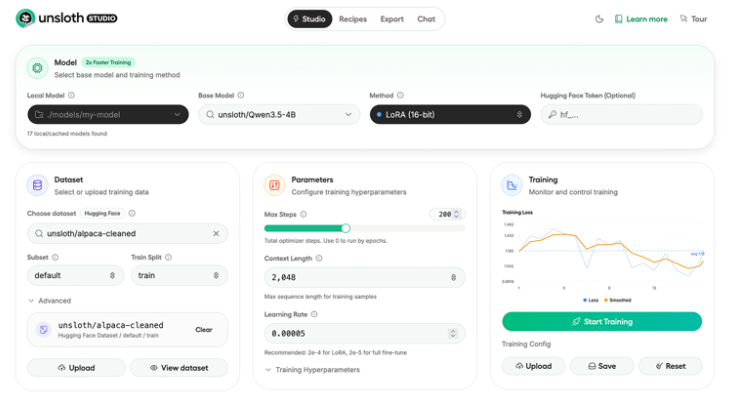

以Unsloth AI微调库闻名的团队刚刚发布了一项可能改变我们使用大语言模型方式的创新产品。全新的Unsloth Studio将专业级模型定制功能带到了个人电脑上,并配备了令人惊喜的直观可视化界面。

打破技术壁垒

这次发布的特别之处在哪?首先,它彻底绕过了CUDA配置和复杂设置流程的难题。开发者现在可以在消费级硬件(如RTX4090显卡而非昂贵的服务器集群)上微调Llama3.3或DeepSeek-R1等大型模型。

其核心技术在于Unsloth定制的Triton语言反向传播内核,实现了以下显著改进:

- 训练速度翻倍 相比标准框架

- 内存占用减少70% 且不影响模型精度

- 兼容消费级GPU 为独立开发者敞开大门

"我们看到用户能在单块GPU上运行80亿参数的模型,"一位测试者解释道,"对许多应用场景而言,这消除了曾让小团队望而却步的云计算费用。"

复杂任务的可视化方案

该工作室将其强大引擎封装在直观的网页界面中,全程引导用户:

- 数据准备 通过节点式工作流实现可视化操作,可处理杂乱的PDF和JSONL文件

- 内置强化学习 采用来自DeepSeek-R1的GRPO技术

- 一键部署 支持GGUF、vLLM和Ollama格式

最重要的是所有处理都在本地完成。在这个数据隐私问题日益严峻的时代,完整掌控整个流程和输出结果让企业倍感安心。

时机恰到好处。当众多公司既渴求定制化AI解决方案又对云服务成本犹豫不决时,Unsloth Studio提供了一个极具吸引力的替代方案。早期使用者报告称其应用于从法律文件处理到创意写作助手等各种场景——全部在普通硬件上自主开发完成。

对AI未来的意义

此次发布标志着人工智能开发领域的重大转变。曾几何时只有科技巨头能负担的模型定制,如今通过Unsloth Studio等工具正变得大众化。这对初创企业、研究人员乃至爱好者的影响深远。

该平台目前原生支持Llama4和Qwen系列模型,未来计划兼容更多架构。对于那些厌倦与云平台周旋或被硬件预算束缚的开发者来说,这或许正是他们期待已久的突破。

核心亮点:

- 本地可视化界面省去复杂配置流程

- GPU内存需求降低70%同时速度翻倍

- 使消费级硬件微调大模型成为可能

- 包含从数据准备到部署的完整工作流

- 通过全程本地处理保障数据隐私