腾讯ARC开源AudioStory模型,助力长音频内容生成

腾讯ARC发布开源AudioStory模型:实现长篇叙事音频生成

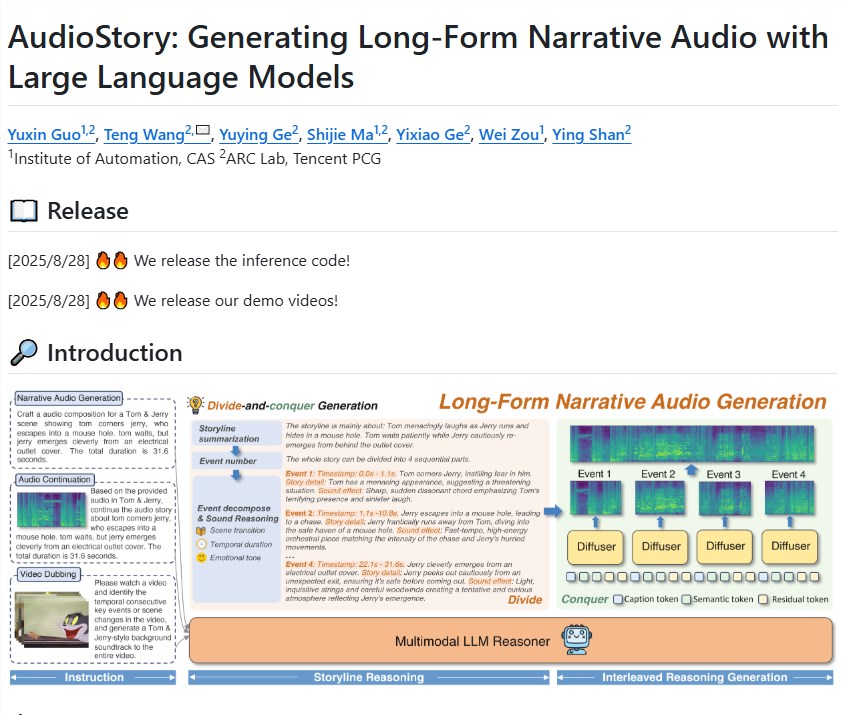

腾讯应用研究中心(ARC)正式开源AudioStory——一款基于大语言模型(LLM)的长篇叙事音频生成模型。这一开源项目标志着文本转音频技术的重大突破,尤其在需要保持时间连贯性和处理复杂结构的长时间内容生成领域。

技术框架与核心能力

该模型通过统一理解与生成框架实现多样化应用场景:

- 影视配音

- 音频续写

- 长篇叙事合成

通过将LLM与音频生成系统结合,AudioStory能够在长时间轴中保持场景转换连贯性和情感基调一致性。其指令跟随架构可将复杂叙事查询分解为按时间顺序排列的子任务。

关键创新点

AudioStory带来两大突破性特性:

- 解耦桥接机制:将LLM协作与音频生成分离为专门组件

- 端到端训练:统一指令解析与音频生产以增强系统协同性

团队同步发布了涵盖动画音景到自然声叙事的AudioStory-10K基准数据集。对比测试表明,无论是单实例生成还是长篇叙事场景,其性能均优于传统文本转音频模型。

实际应用场景

当前已实现的案例包括:

- 经典动画配音(以《猫和老鼠》样本演示)

- 基于文本的长篇音频生成

- 多场景叙事构建 项目GitHub仓库包含推理代码及详细用例文档。

核心亮点:

🎧 融合LLM与音频生成技术实现连贯长篇叙事

📊 在时间连贯性与指令遵循度上超越现有模型

🛠️ 开源10K基准数据集助力社区发展

🌐 展示娱乐与媒体制作领域的应用潜力