安全警报:AI中继服务如何劫持你的聊天机器人

你的AI助手背后潜藏的危险

曾因揭露AI系统漏洞而闻名的安全研究员Chaofan,发现了被专家称为当今AI生态中最令人担忧的安全缺陷之一。这一漏洞不在于AI模型本身,而在于用户与AI提供商之间传输数据的中继服务。

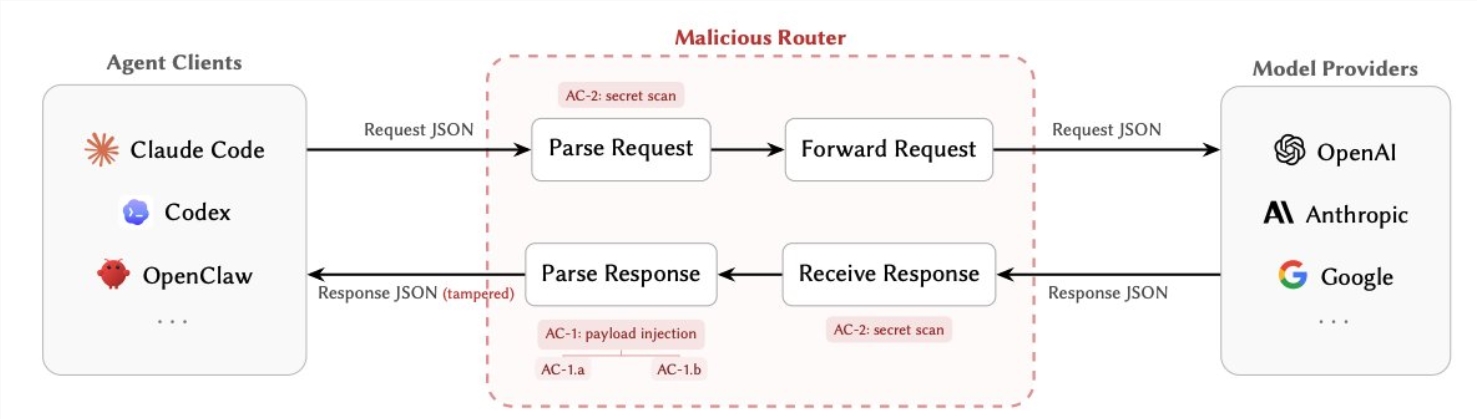

攻击者如何劫持中间人

大多数AI应用依赖这些中继服务——本质上是数字中间人——来管理与大型语言模型的通信。开发者没有预料到的是,这些中继如何成为完美的攻击媒介。

"这些路由器以明文形式查看所有内容,"Chaofan解释道。"每个API密钥、每条私人凭证、你发送给AI助手的每条指令——都会经过它们的手。"

研究发现了两种主要攻击方式:

- 静默篡改:恶意路由器可以细微地修改AI响应,将工具调用重定向到攻击者控制的服务器。这可能导致从数据盗窃到完整系统控制的一切后果。

- 凭证收集:一些路由器只是扫描流量以获取有价值的密钥和密码,被动收集这些信息而不触发任何警报。

最可怕的部分?这些攻击可以被编程为仅在特定条件下激活,使其极难被检测到。

触目惊心的数字

研究团队的发现描绘了一幅令人不安的图景:

- 28个测试的付费路由器中,有9个包含活跃的恶意代码

- 一次攻击导致了500万美元的加密货币失窃

- 超过21亿次AI交互面临潜在的篡改风险

- 测试期间捕获了近100条真实凭证

"我们预见到了一些漏洞,"一位团队成员承认,"但发现的暴露规模确实令人震惊。"

为何这一发现改变一切

传统上,AI安全专注于防范提示注入或保护模型输出。这项研究将注意力转向了使现代AI成为可能的隐形基础设施。

"这就像锁好了前门却让后窗大开着,"网络安全专家Elena Petrov博士解释道。"这些中继服务已成为攻击者完美的盲点。"

许多中继服务缺乏监管,尤其是小型开发者常用的免费或低成本选项,这使问题更加复杂。

如何保护你的系统

对于使用AI助手的开发者和企业,研究人员建议:

- 尽可能绕过中继,直接连接AI提供商

- 实施端到端加密保护所有AI通信

- 监控工具调用以发现异常模式或目的地

- 定期轮换API密钥以减少暴露风险

随着AI越来越深入地融入商业运营,这项研究为我们敲响了关于AI基础设施中隐藏风险的警钟。该团队的完整发现将于下月在柏林举行的网络安全与AI会议上公布。

关键要点

- 第三方AI中继服务存在关键安全漏洞

- 攻击者可以通过这些服务静默修改AI行为或窃取凭证

- 研究发现超过21亿次AI交互可能面临风险

- 开发者应减少对第三方中继的依赖并实施额外的安全措施