机器人通过突破性深度感知模型获得类人视觉

机器人终于能像人类一样看透玻璃了

想象一下机器人调酒师能自信地倒酒而不会打翻玻璃杯,或是工业机械臂精准处理闪亮的金属部件。得益于灵波科技的突破性空间感知模型,这一未来愿景正变得更接近现实。

看见不可见之物

新开源的LingBot-Depth解决了工程师们称之为机器人技术"玻璃天花板"的难题——字面意义上的。传统深度摄像头在面对窗户等透明表面或不锈钢等反光材料时常常力不从心,往往将其视为空白区域或扭曲的形状。

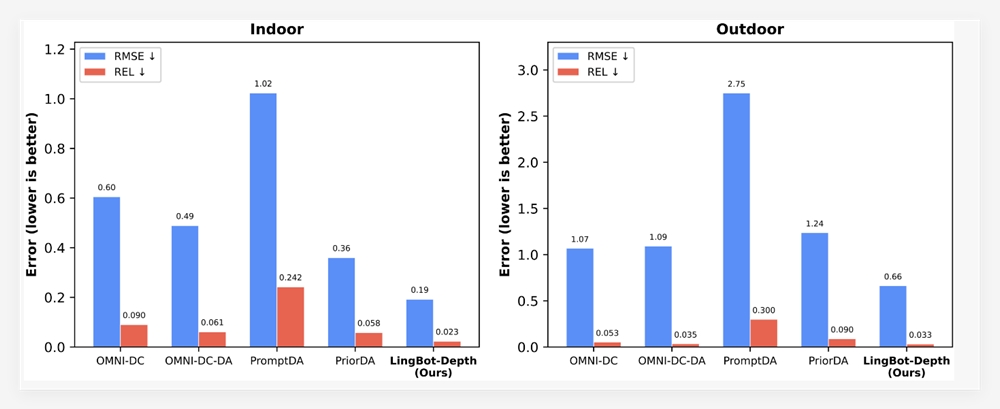

说明:LingBot-Depth(最右)在补全缺失深度信息方面显著优于其他模型

"这就像给机器人赋予了X光视觉,"项目首席研究员张伟博士解释道,"当现有系统看到一个酒杯时只能识别出空隙或噪点,而我们的模型能重建完整的三维形状。"

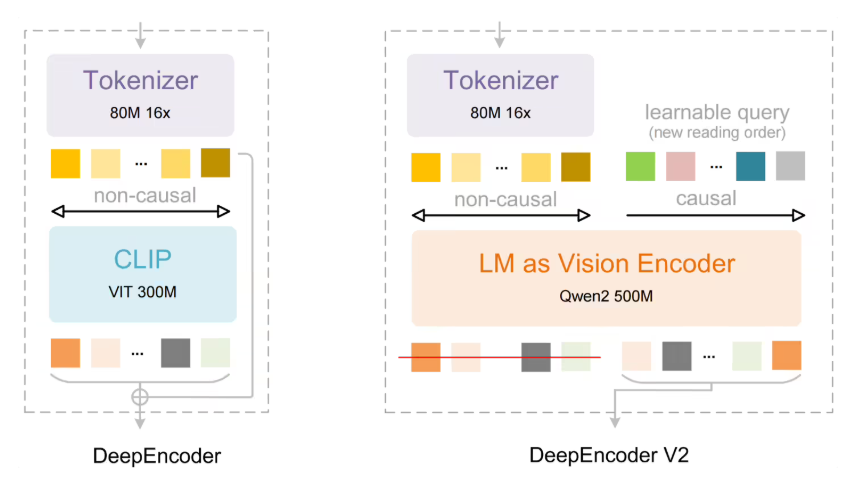

工作原理

其核心技术在于掩膜深度建模(MDM)技术。当立体摄像头缺失深度数据时——比如来自镜面反射的部分——LingBot-Depth会智能地利用彩色图像线索和上下文理解来填补空白。

搭配Orobote的Gemini330立体摄像头使用时,该系统实现了:

- 室内环境比竞争对手减少70%误差

- 稀疏地图任务上提升47%性能

- 复杂曲面上呈现水晶般清晰的边缘

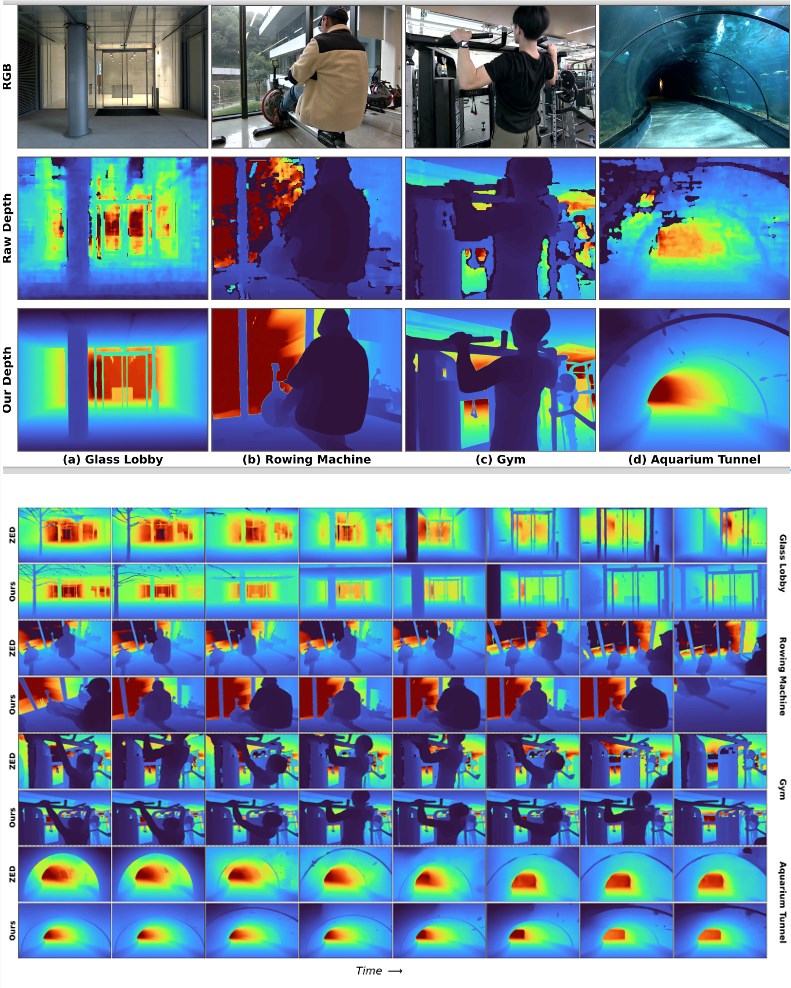

说明:上图显示LingBot-Depth的清晰重建效果;下图与行业领先者ZED相比优势明显

现实世界就绪

团队不仅进行了实验室测试。他们收集了1000万个真实世界样本——从阳光照射的窗户到拥挤的餐厅桌面——并将其提炼为200万组高质量训练对。这个庞大的数据集不久将向全球研究人员开放。

工业合作伙伴已经兴奋不已。"这将改变玻璃制造中的质量控制,"精密机器人公司的Lisa Chen指出,"再也不需要为反光表面寻找变通方案了。"

未来展望

蚂蚁灵波计划本周开源更多具身智能模型,同时Orobote正准备推出利用这些技术进步的新硬件。一场将这种类人视觉应用于从自动驾驶汽车到智能家居助手等各种设备的竞赛已经开始。

关键要点:

- 突破性精度:在某些测试中对透明/反光物体的处理能力甚至优于人类

- 开源优势:研究人员和开发者可免费实现

- 硬件兼容:支持Gemini330系列等现有立体摄像头

- 即将到来:庞大的训练数据集将公开可用