OpenAI加强ChatGPT安全防护,推出新措施抵御黑客攻击

OpenAI强化ChatGPT数字防御

针对日益增长的AI系统网络安全威胁,OpenAI为ChatGPT实施了两项强大的安全功能。这些更新专门解决提示注入漏洞——一种通过欺骗AI执行未授权操作或泄露敏感信息的攻击方式。

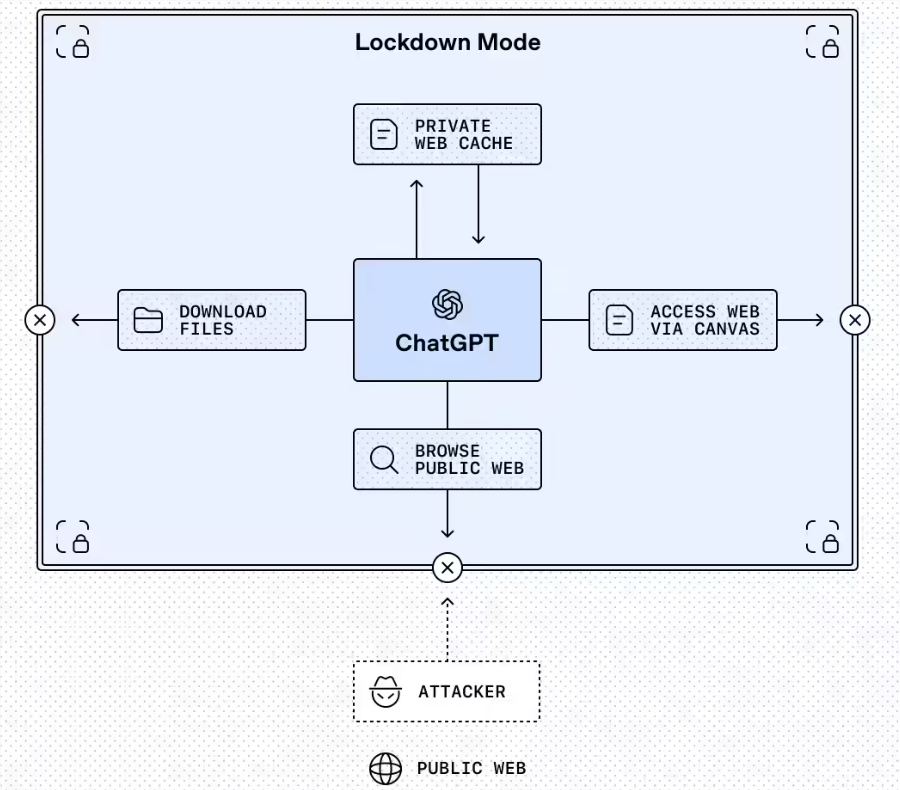

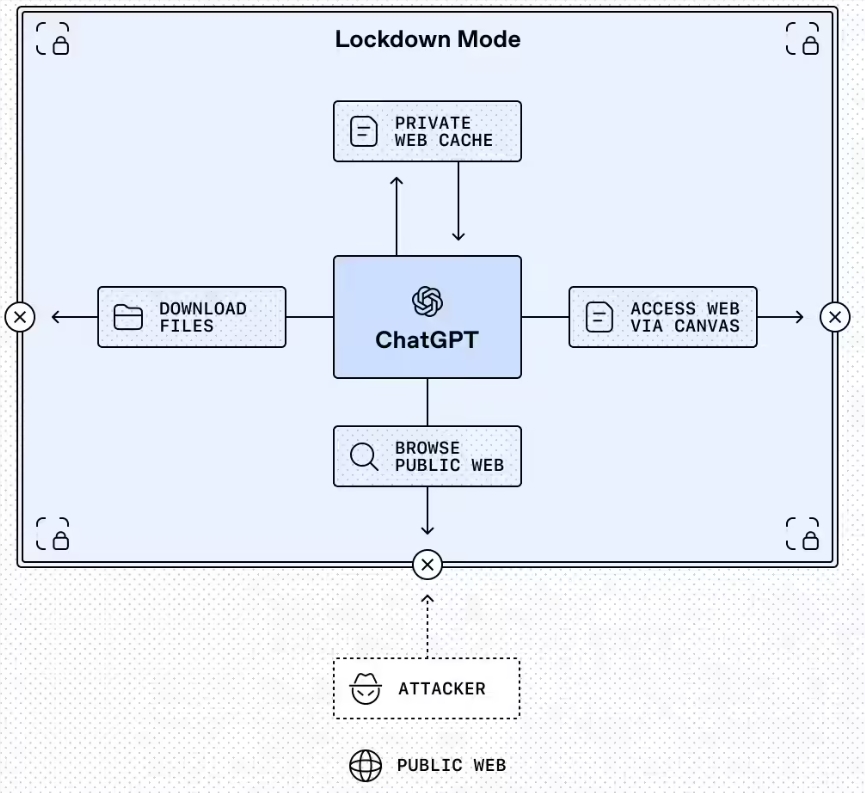

锁定模式:数字版诺克斯堡

第一项增强功能是锁定模式,这是专为处理敏感数据的组织设计的可选设置。可以将其视为给ChatGPT套上保护罩——它大幅限制AI与外部系统的交互方式,以最大限度减少潜在数据泄露。

激活该模式后:

- 仅限访问缓存内容的网页浏览

- 自动禁用缺乏强安全保障的功能

- 允许管理员精确控制哪些外部应用可与ChatGPT交互

该模式目前面向企业版、教育版、医疗版和教师版提供,即将扩展至消费者账户。OpenAI还开发了合规API日志平台,帮助组织追踪和审计团队对这些功能的使用情况。

高风险功能明确警示标签

第二项更新是在ChatGPT、ChatGPT Atlas和Codex中引入标准化"高风险"标签。当用户启用涉及较高安全风险(特别是需要网络访问)的功能时,这些警告就会出现。

"某些使AI更有用的能力也带来了行业尚未完全解决的风险,"OpenAI发言人解释道,"这些标签帮助用户就何时使用特定功能做出明智决定。"

这些警告不仅标记潜在危险——还提供:

- 激活功能后变化的清晰说明

- 需警惕的具体风险场景

- 缓解漏洞的实用建议

- 适用场景指南

为何此刻推出这些更新

随着AI系统日益与其他软件和网站连接,它们成为网络攻击的潜在入口。提示注入攻击已成为一种特别隐蔽的威胁——想象有人向网页植入隐藏指令,诱使ChatGPT泄露机密数据或执行未授权操作。

这些新防护措施建立在OpenAI现有安全机制(如沙盒化和URL数据泄漏防护)基础上,标志着向赋予用户更多透明度和控制权的转变。

The rollout comes as businesses increasingly adopt AI tools while grappling with how to balance functionality with data protection requirements. For organizations in regulated industries like healthcare or finance, these updates could make the difference between embracing AI innovation and keeping it at arm's length.