OpenAI加强ChatGPT安全防护,抵御隐蔽提示攻击

OpenAI为ChatGPT系紧数字安全带

ChatGPT如今能更智能地识别数字扒手。OpenAI宣布重大安全升级,旨在阻止提示注入攻击——这种巧妙操纵可诱骗AI助手泄露机密或执行非预期操作。

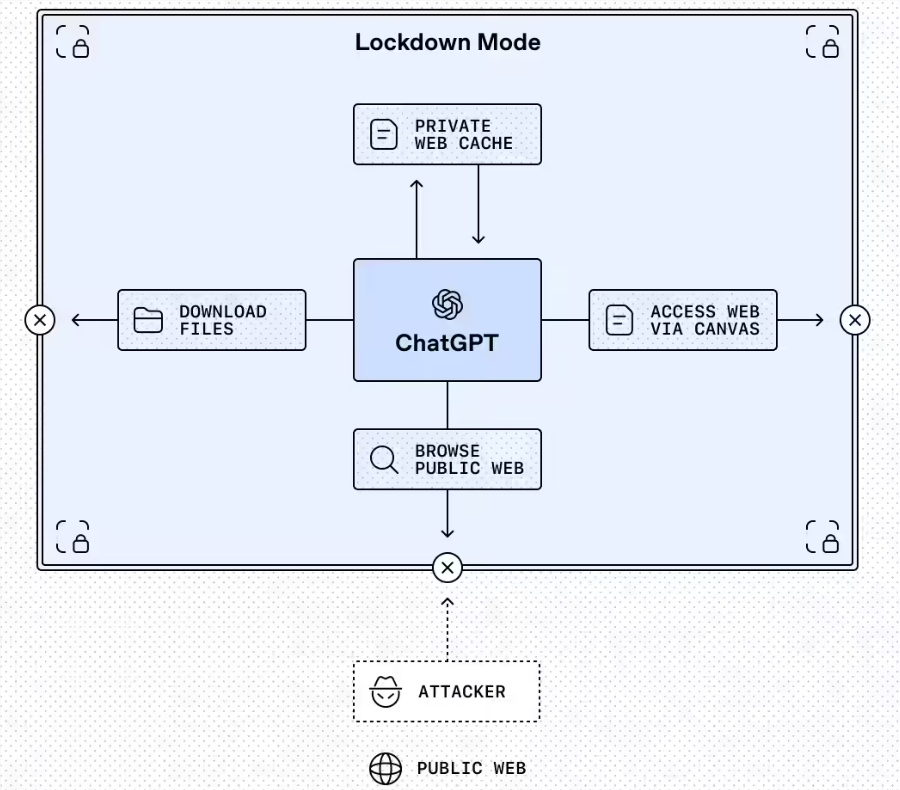

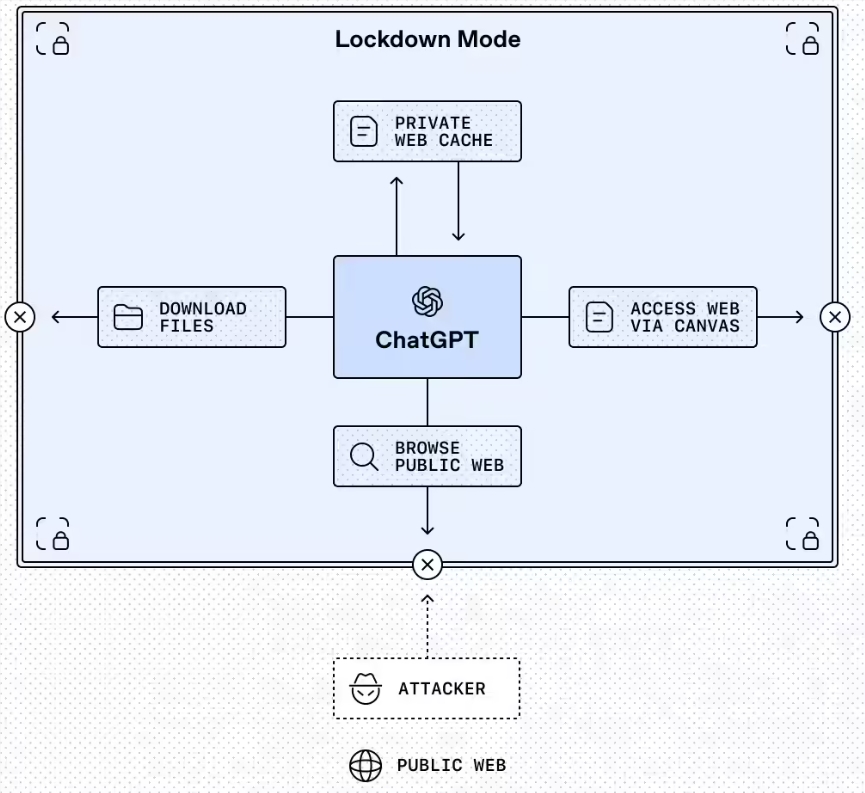

封锁模式:数字版诺克斯堡

核心功能是封锁模式,在处理敏感信息时 essentially 将ChatGPT变成数字堡垒。试想:网页浏览仅限缓存内容,任何缺乏铁腕安全保障的功能都会被暂时禁用。

"我们为处理医疗记录、学生数据或企业机密的机构提供额外保护层,"OpenAI发言人解释道。企业和教育用户现可通过管理员面板激活此模式,消费者版本即将推出。

风险标识可视化

第二项升级引入标准化"高风险"警告标签——就像数字施工区周围的亮橙色警示锥。当开发者启用无限制网络访问等高风险功能时,这些标签就会显现。

"透明度至关重要,"发言人强调,"如果Codex在编程任务中需要获取实时网络数据,我们希望开发者在明确风险的前提下做出选择。"

当下为何重要

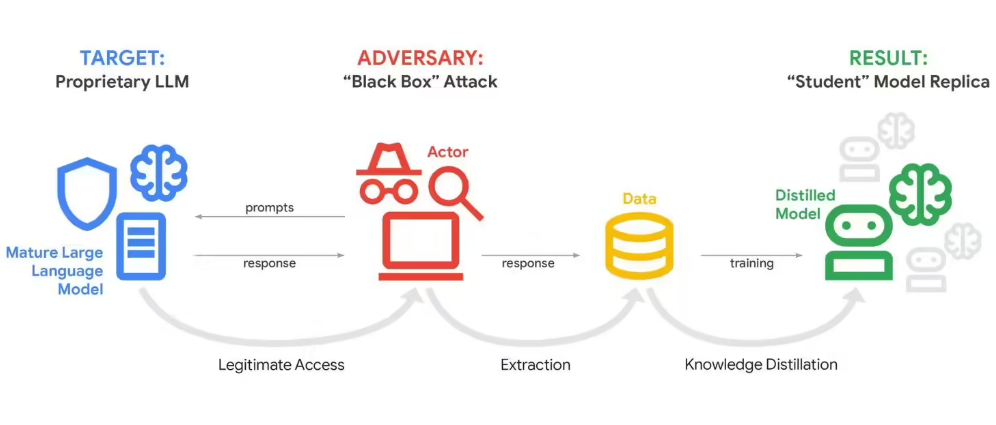

随着AI助手日益频繁地连接其他应用和网站,它们也继承了新的漏洞。黑客通过提示注入攻击变得更具创意——将恶意指令隐藏在看似正常的请求中,以此绕过传统安全检查。

这些升级与沙盒隔离、URL过滤等现有防护措施形成互补。合规工具还能帮助机构追踪防护模式的使用情况——这对面临审计要求的受监管行业至关重要。

关键要点:

- 封锁模式限制敏感场景下ChatGPT的外部交互

- 警告标签清晰标注高风险功能

- 当前防护主要面向企业和教育用户

- 消费者版本预计数月内推出

- 基于现有沙盒与过滤系统构建