Moonshot AI与清华大学联手攻克AI最大瓶颈

Moonshot AI与清华大学破解AI效率密码

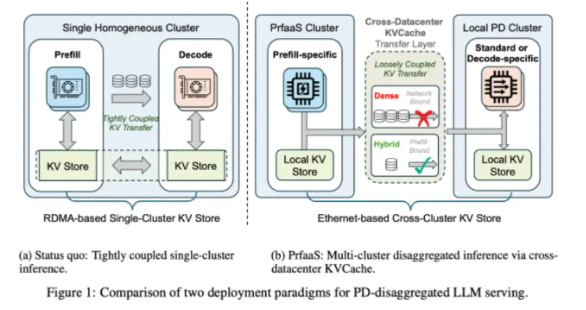

想象您最爱的AI助手突然提速54%而无需硬件升级。这正是Moonshot AI与清华大学研究人员通过其革命性Prefill-as-a-Service(PrfaaS)架构实现的突破。该方案直击当前大语言模型处理效率低下的核心痛点。

症结所在:AI的交通堵塞

当前AI系统面临一个根本矛盾:请求处理包含两个截然不同的阶段:

- 构思阶段(Prefill):系统一次性分析完整输入——好比厨师备齐所有食材

- 输出阶段(Decode):系统逐字生成响应——如同厨师精心摆盘

当这两个进程在相同硬件上争夺资源时,就像在厨房同时经营面包店和举办晚宴——两者都无法获得充分资源。

解决方案:远距离协作

PrfaaS架构提供了精妙的解决路径:

- 专业分工:高性能计算集群专司初始繁重任务(prefill)

- 高效交接:预处理数据通过标准网络传输至本地服务器

- 精准调度:智能时序管理避免单个请求阻塞队列

"我们本质上打造了AI处理的快速通道,"项目研究员解释道,"密集型思考在算力充沛处完成,而响应生成更贴近用户端。"

实际成效

数据足以说明一切:

- 并发处理量提升54%

- 终端用户获得显著更快的首响应

- 彻底解决计算与内存的资源冲突

其影响远超速度提升。该方案可大幅降低企业部署大模型的基建成本,使强大AI工具更易普及。

未来展望

尽管处于早期阶段,PrfaaS不仅代表技术改良——更预示了AI工作负载地理分布的新范式。正如团队成员所言:"这可能是真正全球规模AI部署的开端。"

合作团队持续优化该技术,行业观察者正密切关注这项创新如何重塑AI驱动的未来。

核心要点:

- 破解难题:分离计算密集型与内存密集型AI任务

- 工作原理:专用集群初始处理+高效数据传输

- 核心优势:吞吐量提升54%,延迟降低,资源利用率优化

- 宏观意义:有望实现更高效的全球AI部署