Mistral AI的Small4:开发者的多功能强力工具

Mistral AI凭借Small4发布再创突破

在竞争激烈的开源AI模型领域,欧洲竞争者Mistral AI又向前迈出了令人印象深刻的一步。他们新推出的Small4模型标志着一个重要里程碑——这是该公司首个真正多功能的大型语言模型,将多种先进能力集于一体。

全能解决方案

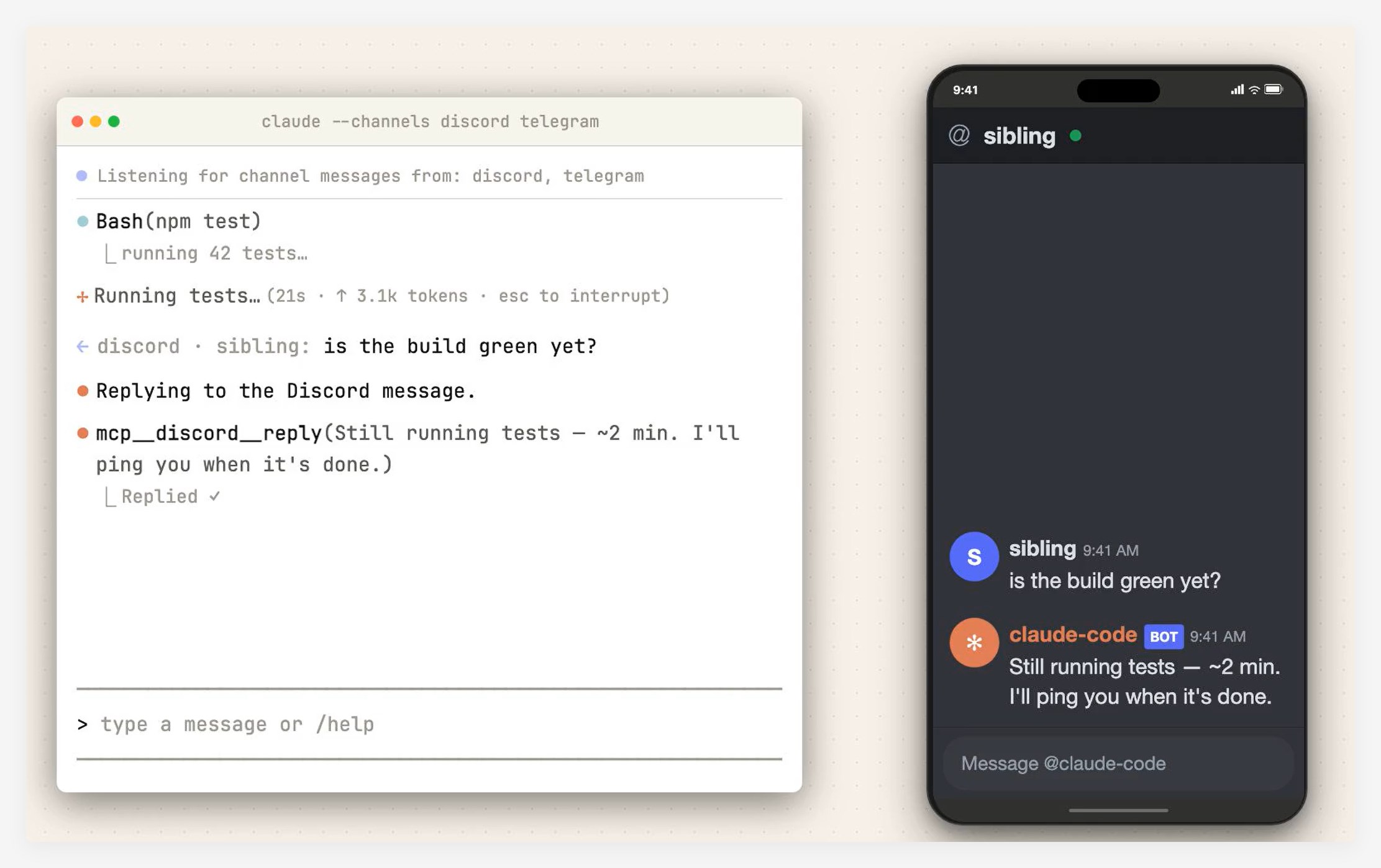

Small4有何独特之处?开发者首次无需在专用模型间切换,就能获得旗舰级的推理能力、多模态理解和强大的编程功能。"这就像鱼与熊掌兼得,"一位早期测试者评论道。该模型的多样性可能会简化跨不同AI应用领域团队的工作流程。

技术内幕:重大突破

Small4高效运行的秘诀在于其先进的专家混合(MoE)架构:

- 智能参数使用:虽然拥有1190亿总参数,但每次仅激活60亿参数,在不增加不必要计算开销的情况下实现了出色性能

- 扩展内存:巨大的256k上下文窗口意味着它能一次性消化整本技术手册或复杂代码库

- 灵活操作模式:用户可在简单查询的快速响应和复杂问题的深度推理之间切换

- 开源优势:采用宽松的Apache 2.0许可证发布,使其对广大开发者开放

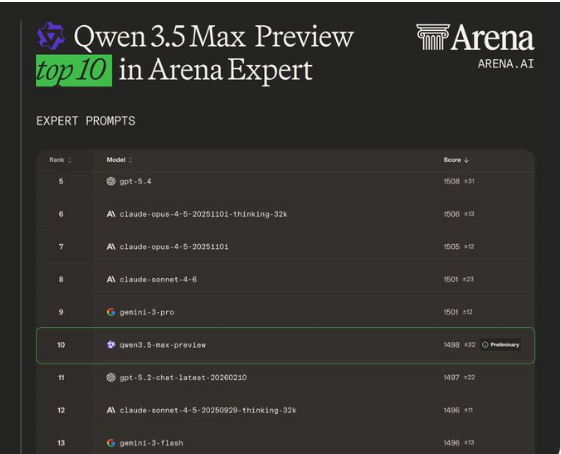

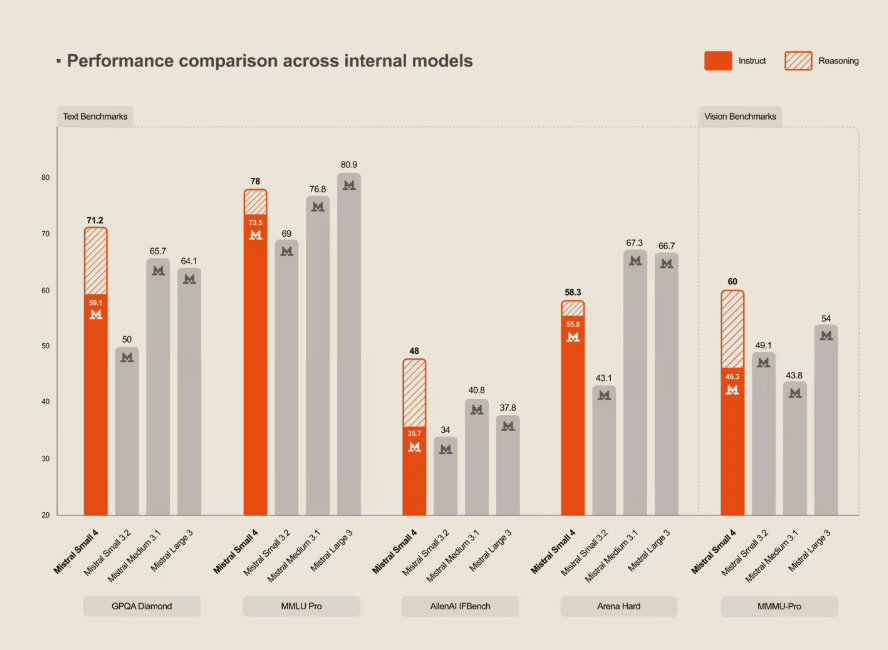

令人瞩目的性能表现

基准测试显示Small4不仅功能多样——它还很快捷。与前代产品相比:

- 在延迟优化模式下响应时间缩短了40%

- 在高需求场景下吞吐量提升三倍 该模型与竞争对手相比也毫不逊色,在关键性能指标上与OpenAI的GPT-OSS120B相当。

硬件考量

要充分发挥Small4的性能,Mistral建议:

- 最低配置:4× HGX H100或1× DGX B200系统

- 最优配置:4× HGX H200或2× DGX B200集群 这些要求体现了模型的强大性能,同时仍保持对专业开发团队的可及性。

此次发布确立了Mistral在开源AI领域的实力地位,为开发者提供了专有解决方案之外的有力选择。正如一位行业分析师所言:"这可能会改变团队处理多学科AI项目的方式。"