微软发布Phi-4:一款能像人类一样观察与思考的敏捷AI

微软全新Phi-4 AI实现视觉与推理的融合

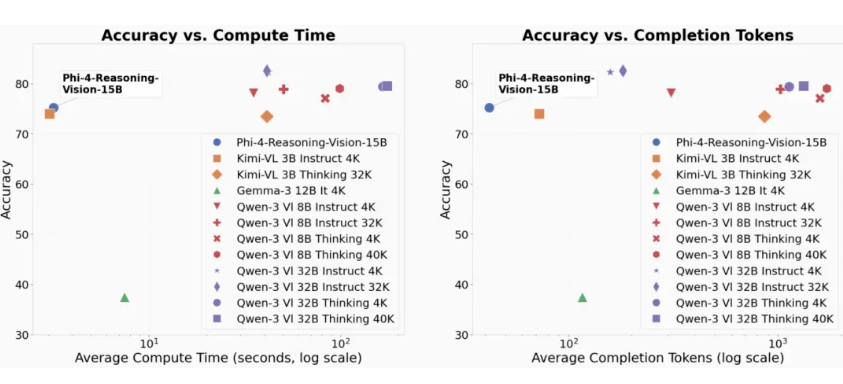

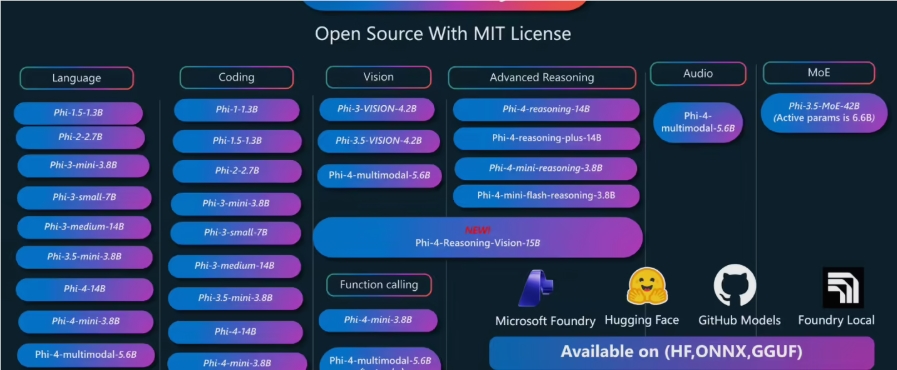

在人工智能领域的重大飞跃中,微软发布了Phi-4-Reasoning-Vision-15B——一个将高分辨率视觉处理与复杂推理能力相结合的开源模型。这个紧凑而强大的系统代表了这家科技巨头在其Phi系列中的最新创新。

超越简单图像识别

Phi-4的独特之处不仅在于它能清晰地看到图像,还在于它如何解读这些图像。传统的计算机视觉系统可能会识别照片中的物体,但Phi-4更进一步——分析元素之间的关系并得出逻辑结论。想象一下,一个AI不仅能识别文档中的图表,还能真正理解数据的含义。

斯坦福大学的AI研究员陈丽莎博士解释说:“这不是你祖父那代的图像识别软件。Phi-4处理视觉信息的方式与人类相似——注意到模式、建立联系并应用上下文。”

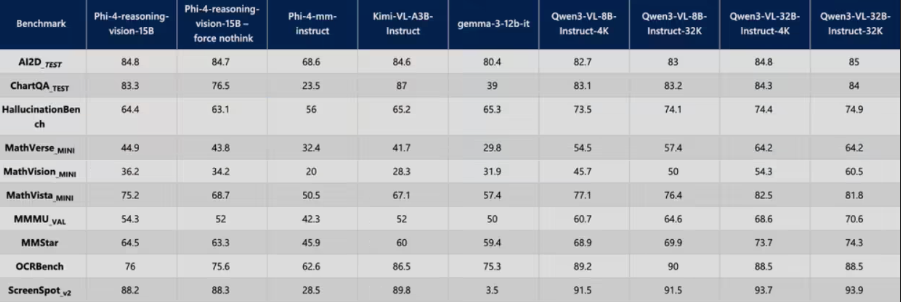

说明:非推理模式可实现如OCR等任务的快速响应

说明:非推理模式可实现如OCR等任务的快速响应

双模式思维更胜一筹

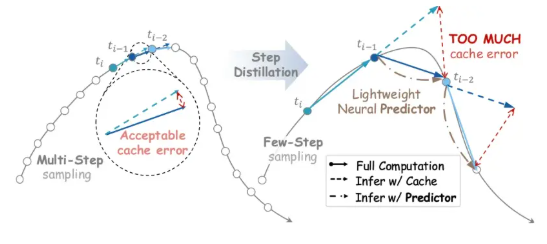

该模型的秘密武器在于其自适应思维模式:

- 快速响应模式:对于读取文本或定位界面元素等简单任务,Phi-4能提供闪电般快速的结果。

- 深度思考模式:当面对需要逐步分析的复杂问题(如数学证明或逻辑谜题)时,AI会切换到有条不紊的推理状态。

这种灵活性使Phi-4特别适用于:

- 从图表中自动进行数据分析

- 智能UI测试与交互

- 解释视觉概念的教育工具

- 描述复杂图像的无障碍应用

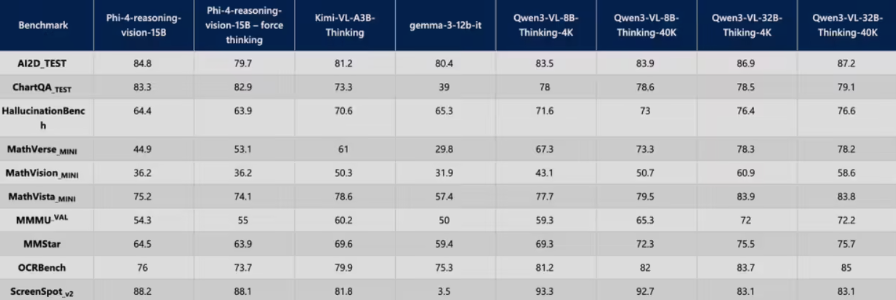

说明:推理模式激活多步骤分析链

说明:推理模式激活多步骤分析链

实用魔法

其影响不仅限于技术演示。考虑以下实际场景:

- 设计师上传网站原型并指示“将所有可点击元素变为蓝色”——Phi-4自动识别每个按钮和链接。

- 研究人员将科学图表输入系统——无需手动输入数据即可提取趋势和关系。

- 教育工作者创建互动课程,学生可以就图表提问并获得智能回答。

该模型输出UI元素的标准坐标,使其他系统能够自然地与界面交互——根据简单指令点击按钮、滚动页面或填写表单。

关键点:

✅ 结合视觉处理与上下文推理——这在AI模型中实属罕见

✅ 开源可用性降低了开发者实验的门槛

✅ 双模式操作根据需要平衡速度与深度

✅ 特别适合自动化界面交互和数据分析

✅ 潜在应用涵盖教育、无障碍服务和设计自动化