微软就OpenClaw AI安全风险发出警告

微软警示OpenClaw AI助手存在严重安全漏洞

在一份严肃的安全公告中,微软警告各组织不要在常规工作站上使用其OpenClaw人工智能助手。这家科技巨头坚持认为,这款强大的自动化工具应严格限制在隔离环境中使用,因其存在令人担忧的漏洞,可能让攻击者自由掌控企业系统。

OpenClaw为何构成独特风险

与传统软件不同,OpenClaw作为自主代理程序运行,需要完整的系统访问权限——包括电子邮件、文件和登录凭证——来执行任务。这种"全通行证"方式使其在部署不当时特别危险。

"可以把OpenClaw想象成把家门钥匙交给一个能力超强但天真的助手,"网络安全专家Mark Reynolds(与微软无关)解释道,"它能完成惊人的工作,但并不总能识别何时被欺骗。"

两大主要威胁途径浮现

Microsoft Defender团队强调了两种主要攻击方法使企业面临风险:

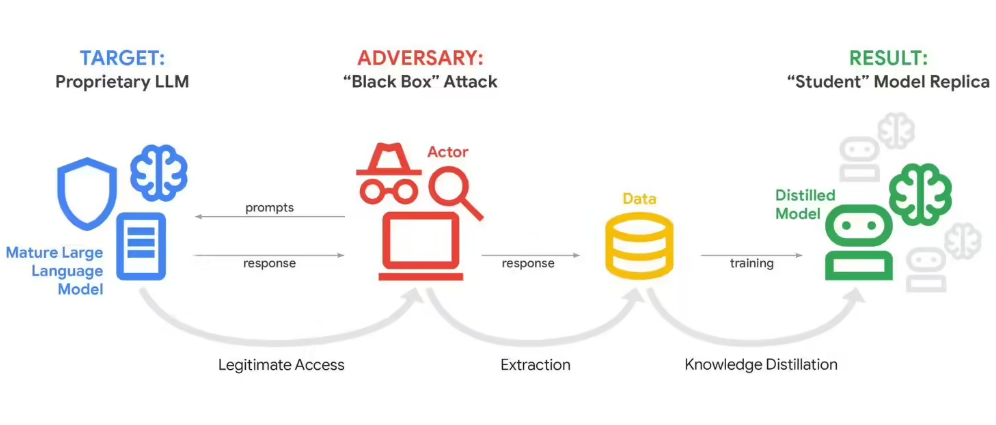

1. 隐藏在明处的命令 攻击者可以在看似无害的内容中嵌入恶意指令供OpenClaw处理。一旦摄入这些"间接提示注入",就能持续改变AI的行为而不触发安全警报。

2. 特洛伊木马式'技能' 该AI下载和运行新功能的能力创造了另一个弱点。黑客可以将恶意软件伪装成合法的技能模块,实际上将OpenClaw变成数据窃取或系统接管的不自觉帮凶。

暴露规模惊人:SecurityScorecard的STRIKE团队在82个国家的超过42,000个IP地址上发现了易受攻击的OpenClaw实例——每个都可能成为攻击者的入口点。

微软的隔离要求

该公司现敦促各组织:

- 仅在专用虚拟机或物理系统中测试OpenClaw

- 使用与核心业务功能无关的有限访问凭证

- 实施持续监控并定期重置环境

- 切勿直接部署在处理敏感数据的生产系统中

这一警告发出之际,企业正越来越多地采用自主AI工具而不完全理解其安全影响。虽然这些代理程序承诺提高效率,但其强大功能同样需要同样强大的保障措施。

关键要点:

- OpenClaw需要完整系统访问权限,使标准部署存在风险

- 间接提示注入可持久性破坏AI行为

- 技能下载创造恶意软件机会,绕过传统防御

- 全球发现50,000+易受攻击实例

- 建议任何部署都采取严格隔离协议