LibuLibu AI通过平台升级解决内容安全问题

LibuLibu AI采取内容安全行动

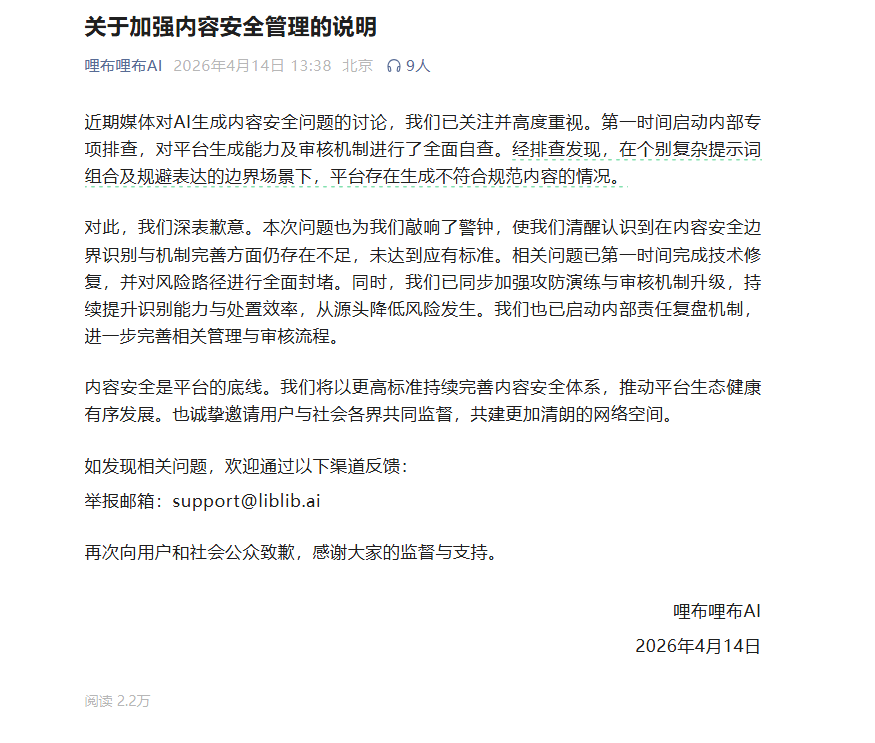

随着AI生成内容日益受到关注,LibuLibu AI已采取具体措施解决安全问题。该公司的声明发布前,用户和媒体曾对其平台输出的部分问题内容提出质疑。

这份承认来之不易。LibuLibu公开表示,当用户使用巧妙的提示组合规避内容限制时,系统偶尔会失效。声明称:"我们意识到过滤器并不完美,特别是在用户故意测试边界条件的极端案例中。"

已实施技术修复

这家AI公司在幕后进行了大量工作。工程师们已经:

- 修补了所有已发现的技术漏洞

- 封堵了允许问题内容通过的漏洞

- 加强了渗透测试以捕捉更多边缘案例

但仅靠技术解决方案还不够。该平台全面改革了审核流程,实施了所谓的"多层防御"机制来应对问题内容。

行业面临的更广泛挑战

这一事件揭示了AI公司面临的更大问题。正如LibuLibu声明所述:"内容安全不仅是我们的挑战,更是整个行业成长的阵痛。"该公司已成立内部审查团队,研究这些疏漏如何发生并防止未来再次出现。

值得注意的是,他们还向公众监督敞开了大门,邀请用户直接向支持团队报告问题。这种透明化举措表明公司理解在这个敏感领域必须赢得信任。

对AI发展的意义

LibuLibu事件凸显了AI领域的快速演变。就在一年前,大多数平台还主要关注功能实现。如今,内容审核和伦理考量正成为焦点。

行业观察人士指出,这反映了负责任AI开发的广泛趋势。正如一位分析师所言:"AI的野蛮生长时代即将结束。平台现在面临正确实现内容安全的真实压力。"

关键要点:

- LibuLibu AI已修复允许问题内容通过的技术问题

- 平台升级了审核系统,采用更强力的保障措施

- 公司承认内容审核方面存在持续挑战

- 事件突显了行业向更严格内容政策的转变

- 建立了公众报告系统以加强监督