InternLM发布轻量级多模态AI模型,仅80亿参数

InternLM新型多模态AI模型突破科学研究壁垒

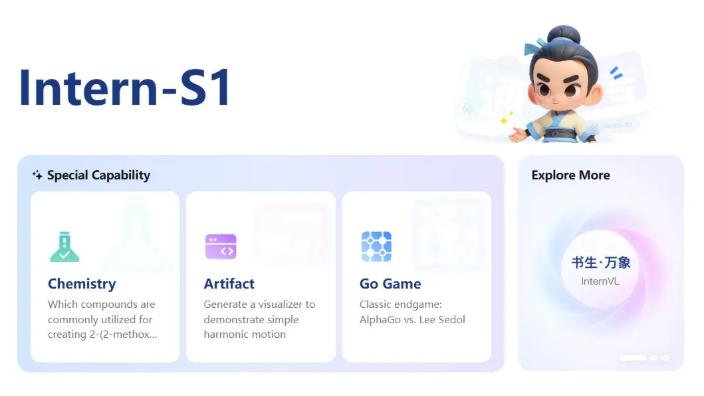

InternLM团队正式发布了Intern-S1-mini,这是一款开创性的开源多模态推理模型,仅包含80亿参数。这个轻量级但功能强大的系统结合了先进的Qwen3-8B语言模型和0.3B视觉编码器InternViT,为复杂数据处理创造了多功能工具。

科学突破性能力

基于超过5万亿token的数据训练(包括来自专业科学领域的2.5万亿token),Intern-S1-mini展现出非凡能力:

- 解读复杂分子式和蛋白质序列

- 有效的合成路径规划

- 同时处理文本、图像和视频输入

该模型的架构实现了语言理解与视觉处理的无缝集成,使其在跨学科研究应用中尤为宝贵。

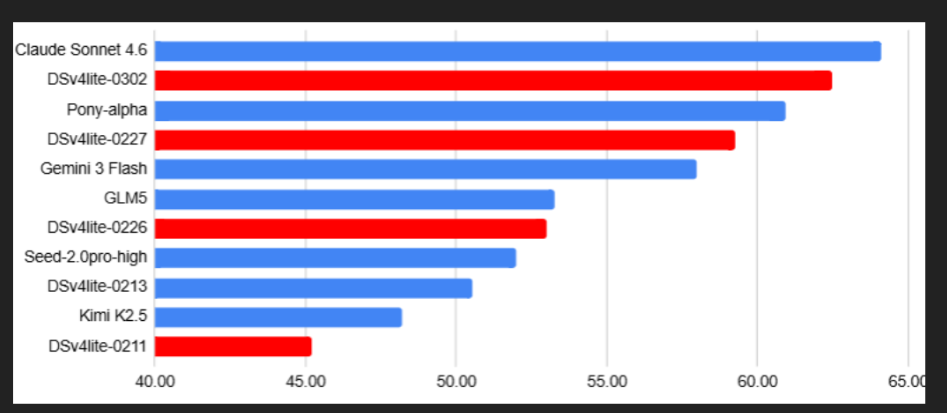

基准测试领先优势

官方测试结果显示Intern-S1-mini在多项指标上表现卓越:

- ChemBench: 76.47分(化学应用)

- MatBench: 61.55分(材料科学)

- ProteinLMBench: 58.47分(生物研究)

该模型在MMLU-Pro、MMMU、GPQA和AIME2024/2025等标准化评估中也优于竞争对手。

独特的用户体验功能

Intern-S1-mini引入了默认启用的创新"思考模式"。用户可通过简单命令(enable_thinking)切换此功能,实现:

- 复杂问题解决过程中的增强交互性

- 更透明的推理过程

- 灵活适应不同使用场景

这种设计理念在科学应用中既强调性能又注重用户可访问性。

AI研究的未来影响

此次发布使Intern-S1-mini成为具有潜在变革性的工具,适用于:

- 需要多模态分析能力的学术研究人员

- 开发新化合物的制药公司

- 探索新型物质的材料科学家 其轻量级架构特别适合计算资源有限的部署场景。

关键要点:

- 在紧凑的80亿参数包中结合Qwen3-8B语言模型与InternViT视觉编码器

- 基于2.5万亿科学领域token的专业训练使其在化学、生物学和材料科学领域实现突破性表现

- 在ChemBench(76.47)和ProteinLMBench(58.47)等多项基准测试中超越竞争对手

- 创新"思考模式"增强交互性和透明推理

- 开源可用性加速多模态AI应用研究