谷歌Gemini AI遭围攻:黑客通过10万+提问窃取机密

谷歌Gemini AI遭遇前所未有的安全漏洞

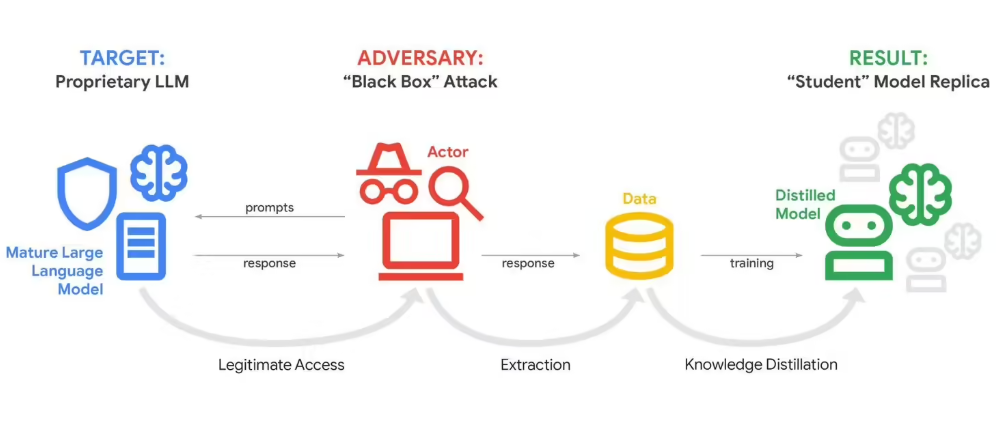

在一项惊人披露中,谷歌承认其旗舰产品Gemini AI聊天机器人遭受了被安全专家称为迄今最大规模的"模型蒸馏攻击"。攻击者向系统发送超过10万条精心设计的提示,试图逆向解析其核心算法。

攻击如何展开

这场于2月12日检测到的袭击代表了AI安全威胁的新前沿。攻击者没有使用传统黑客手段,而是将聊天机器人界面本身作为武器。通过分析Gemini对数千个相似问题变体的响应模式,攻击者能够拼凑出AI的决策逻辑——实质上窃取了它的"思考过程"。

"这不仅关乎一家公司的安全,"谷歌首席威胁分析师John Hottelquist警告道,"我们正在见证可能成为AI开发者行业性危机的第一波浪潮。"这家科技巨头认为商业竞争对手是大多数攻击的幕后黑手,但拒绝点名具体机构。

对企业的重大影响

攸关的是数十亿美元的研究投资。大型科技公司投入巨大资源开发驱动其聊天机器人的独特AI架构。这些专有系统代表着企业竭力保护的竞争优势。

此类攻击暴露了一个根本性弱点:使AI助手实用的开放性特质也使其变得脆弱。"就像拥有一位才华横溢却忍不住详细解释每个问题解决方法的员工,"一位要求匿名的安全研究员解释道。

不断扩大的威胁格局

最初对AI工作原理的学术好奇已演变为复杂的商业间谍活动。开发专业AI工具的小型公司可能尤其脆弱——在没有谷歌级别安全团队的情况下,他们可能在意识到遭受攻击前就已失去宝贵知识产权。

Hottelquist将其与早期互联网安全挑战相提并论:"我们正处于人人都意识到危险存在,却尚未开发出适当防护措施的阶段。"

关键要点:

- 空前规模:单次攻击中使用超10万条提示

- 商业动机:竞争者试图复制谷歌的AI技术突破

- 行业性风险:该攻击方法可针对任何使用大语言模型的企业

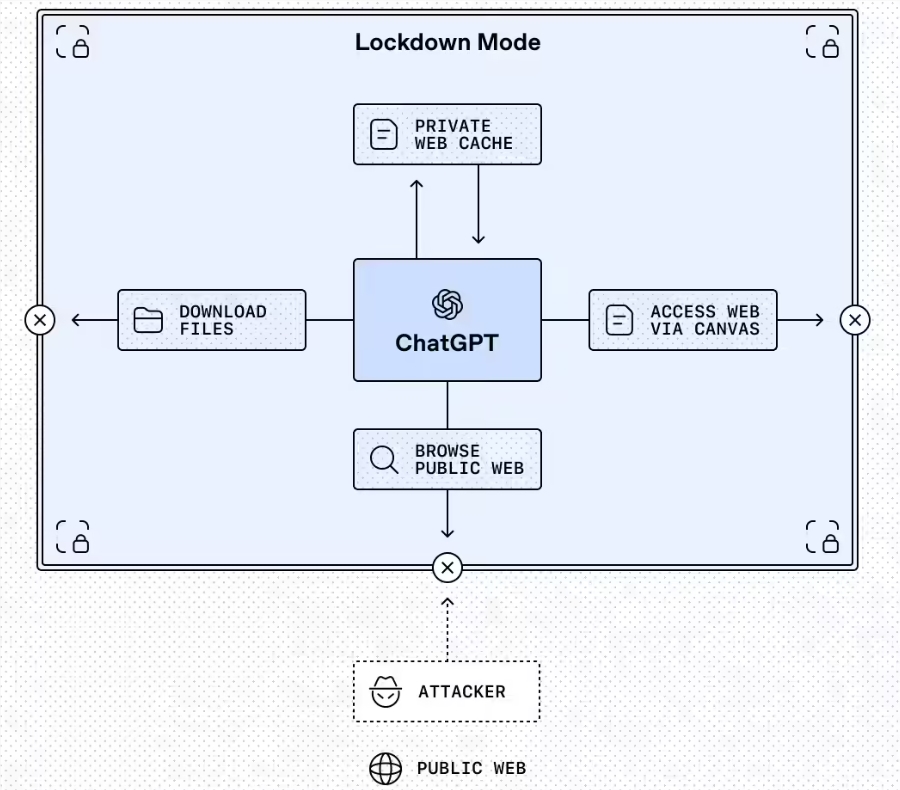

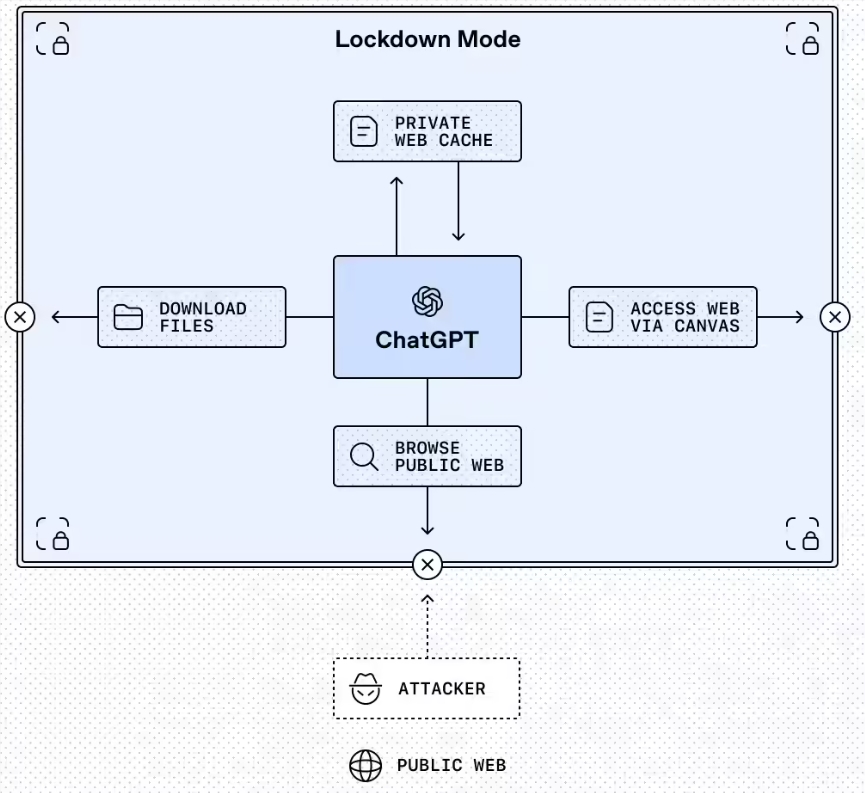

- 防护挑战:现有防御体系难以应对这种新型攻击向量

- 未来隐忧:存在从定制化AI中提取敏感商业数据的潜在风险