谷歌AI严打行动让邮件自动化用户陷入困境

谷歌对AI邮件自动化划出强硬界限

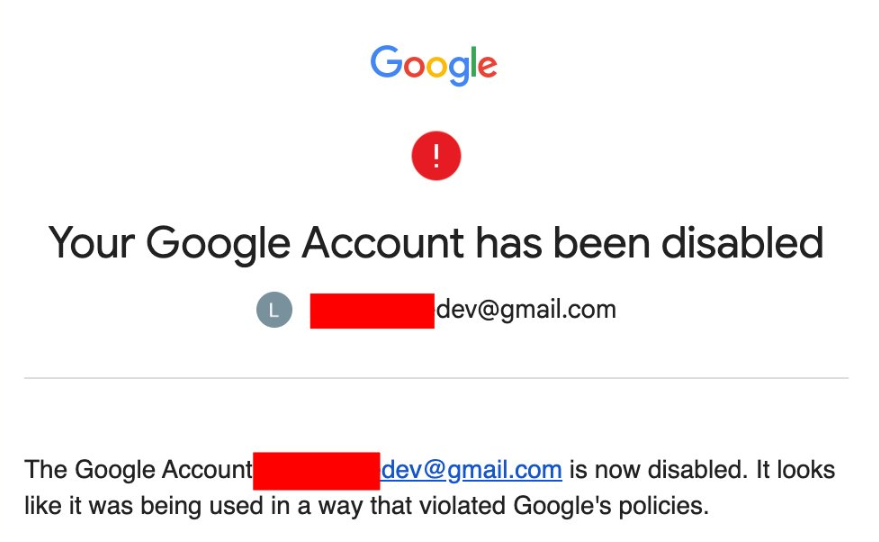

对一些Gmail用户来说,最初管理爆满收件箱的便捷方式如今已变成一场数字噩梦。谷歌最近针对AI驱动的邮件工具采取的强制措施导致了账户被彻底终止——这一极端举措让许多人争相试图恢复多年的个人和工作数据。

自动化的沉重代价

与之前限制特定功能的措施不同,这些最新处罚来得又快又狠。“消失的不只是我的电子邮件,”一位自2014年起使用该账户的受影响用户表示,“我的整个数字生活——家庭照片、工作文档,甚至我在Google Play上的购买记录——都在一瞬间消失了。”

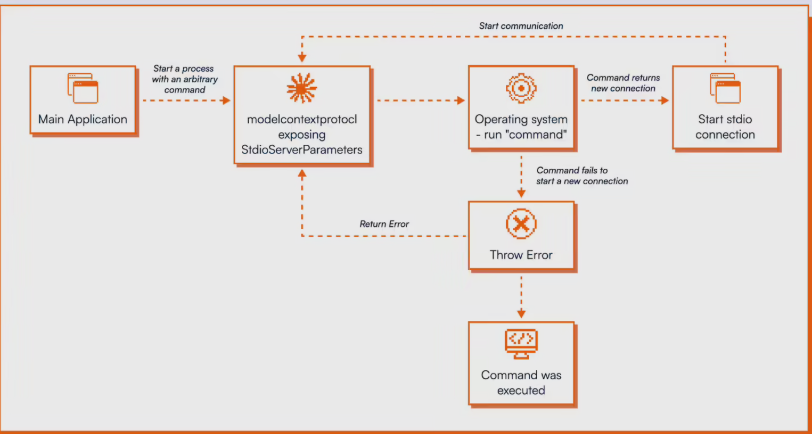

共同点是什么?这些用户都曾授权OpenClaw等第三方AI服务访问他们的账户。这些工具承诺通过自动分类邮件、起草回复甚至与发件人协商来革新邮件管理方式——但它们机器般的行为似乎触发了谷歌的安全警报。

铁拳为何落下

安全分析师指出了导致封禁的两个主要原因:

非自然活动模式:AI代理的工作方式与人类不同——它们全天候不间断地进行快速操作。在谷歌的系统看来,这非常像机器人活动或账户入侵尝试。

订阅规避行为:据报道,一些用户尝试在多个账户间共享付费服务令牌,实质上是在不付费的情况下获取高级功能。这种公然违反政策的行为让谷歌别无选择,只能采取行动。

“这些都不是无心之失,”网络安全专家Elena Martinez博士解释道,“当你把模仿黑客攻击尝试的自动化行为与蓄意绕过支付系统的企图结合起来时,你基本上就是在向世界上最复杂的安全团队之一挥舞红旗。”

损害控制与预防措施

OpenClaw开发团队确认他们正在开发一种“兼容模式”,以使他们的工具更难被安全系统检测到。但在解决方案出现之前,专家建议立即采取以下预防措施:

- 立即停止将自动化工具连接到主要账户

- 创建专门用于测试AI服务的独立账户

- 对关键云数据进行定期本地备份

- 检查谷歌账户设置中的所有第三方应用权限

这一情况鲜明地提醒我们:尽管AI带来了便利性,但过度依赖自动化工具会带来真实风险——尤其是当它们与包含不可替代个人数据的服务交互时。

关键要点:

- 全面账户清除:谷歌正在封禁整个账户,而不仅仅是限制功能

- 双重打击系统:自动化行为和支付规避都会触发处罚

- 数据恢复无望:永久封禁几乎没有机会找回丢失的文件

- 立即保护自己:专家敦促立即采取措施以防止灾难性数据丢失