Gemini遭围攻:黑客如何窃取AI机密

谷歌就AI模型盗窃拉响警报

谷歌安全团队发现有人试图窃取其旗舰产品Gemini AI系统的知识产权后,正全力保护该系统。攻击者向聊天机器人发送海量查询——有时单次攻击就超过10万条提示——探测可能揭示系统思维方式的弱点。

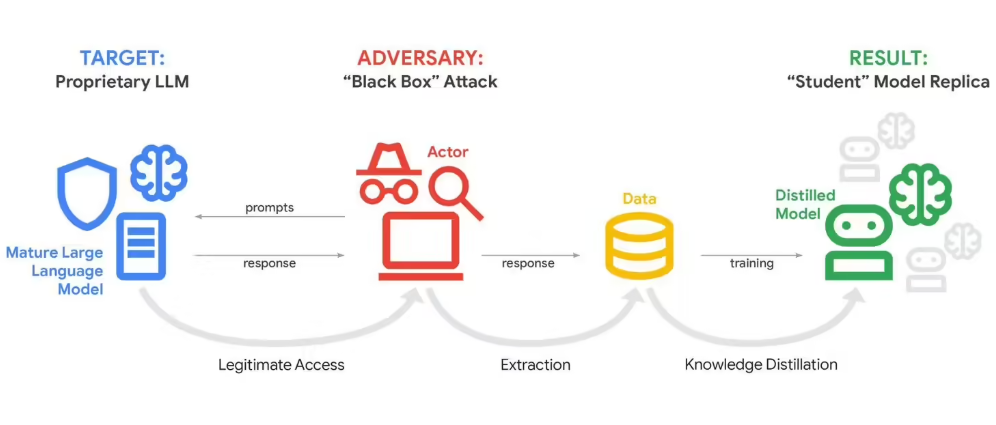

AI盗窃手法解析

这种所谓的"模型蒸馏攻击"如同数字扒窃。通过分析数千条响应,攻击者可以逐步拼凑出Gemini的内部推理模式。"就像有人反复测试保险箱的每个组合",谷歌威胁情报主管John Hottelquist解释道,"最终他们会听到咔哒声"。

肇事者似乎是商业竞争对手而非爱好者或学者。谷歌报告检测到与专业AI开发团队寻求捷径构建竞争系统相一致的攻击模式。

行业连锁反应

尤其令人担忧的是这种手法可能蔓延至科技巨头之外。随着更多企业开发包含敏感数据的专有AI模型——从法律研究工具到医疗诊断系统——它们都成为类似攻击的有吸引力的目标。

Hottelquist将其与早期网络安全威胁相提并论:"我们今天看到的警示信号可能成为明天的流行病"。担忧不仅在于算法被复制;攻击者还可能提取这些训练模型中蕴含的多年商业洞察力。

能否阻止?

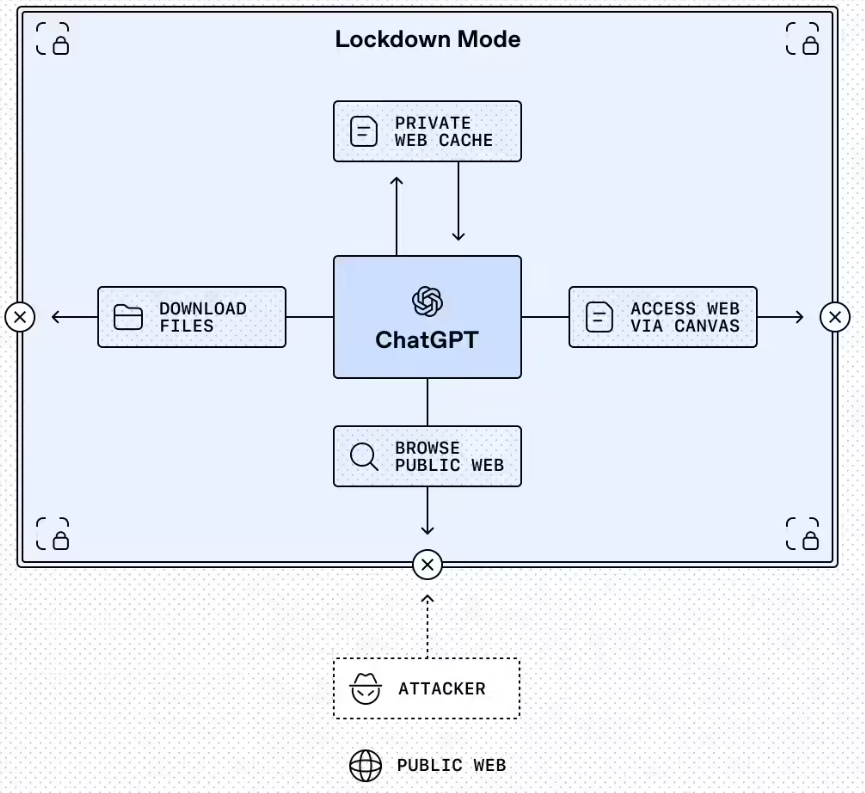

挑战在于平衡安全性与功能性。与传统软件不同,大型语言模型需要开放接口才能发挥作用。当前的检测系统可以发现异常查询模式,但坚定的攻击者总能找到规避方法。

"这不仅是谷歌的问题",Hottelquist强调道,"每家投资AI的公司都需要考虑如何保护他们的数字皇冠上的明珠"。

关键点:

- 史无前例的规模:涉及10万+提示探测系统逻辑的攻击

- 商业动机:竞争者试图复制Gemini的能力

- 更广泛影响:该技术威胁各行业的企业AI投资

- 安全困境:开放访问与知识产权保护需求相冲突